Robots.txt:如何在 WordPress 網站上優化此文件

已發表: 2022-01-21如果我讓你在 WordPress 上定義什麼是robots.txt文件,你能給我一個直接的答案嗎?

不容易,是嗎? 此外,在不知情的情況下,您的網站上可能已經有一個。

問題是,我們並不總是理解這個著名的文件。 這有什麼用途? 你在裡面放什麼? 為什麼它的代碼看起來很難理解?

如果你曾經研究過這個主題,我敢打賭你已經問過自己這些問題。

有點像炸藥,這個文件必須小心處理。

如果您沒有正確設置它,您可能會損壞您網站的 SEO。 所以要小心爆炸!

在這篇文章中,我將向您展示如何避免災難,以及如何優化您的 WordPress robots.txt文件。 您將發現它的用途、工作原理、創建它的兩種方法以及放入其中的內容。

概述

- 什麼是 WordPress robots.txt 文件?

- 如何創建 WordPress robots.txt 文件?

- 如何檢查您的 robots.txt 文件是否正常工作?

- 如何在 WordPress 上優化您的 robots.txt 文件?

- 結論

什麼是 WordPress robots.txt 文件?

推介會

WordPress robots.txt文件是位於您網站根目錄的文本文件,根據 Google 在其網站管理員幫助網站上給出的定義,它“告訴搜索引擎爬蟲爬蟲可以在您的網站上訪問哪些 URL” 。

也稱為“機器人排除標準/協議”,它允許搜索引擎避免索引某些無用和/或私人內容(例如您的登錄頁面、敏感文件夾和文件)。

簡而言之,該協議告訴搜索引擎的機器人他們可以或不能在您的網站上做什麼。

下面是它的工作原理。 當機器人將要抓取您網站的 URL 時(即,它將探索和檢索信息以對其進行索引),它會首先查看您的robots.txt文件。

如果它找到它,它將讀取它,然後按照您給它的指令執行(如果您禁止它,它將無法抓取某個文件)。

如果沒有找到,它將以正常方式抓取您的網站,不排除任何內容。

看看這個 WordPress robots.txt文件的例子,看看它是什麼樣子的:

不一定要停留在它的內容上。 正如您稍後將看到的,沒有可以適應任何站點的標准文件。 無論如何,不建議這樣做。

如果您還必須記住關於我們今天主題的另外 4 件事,請記住這一點:

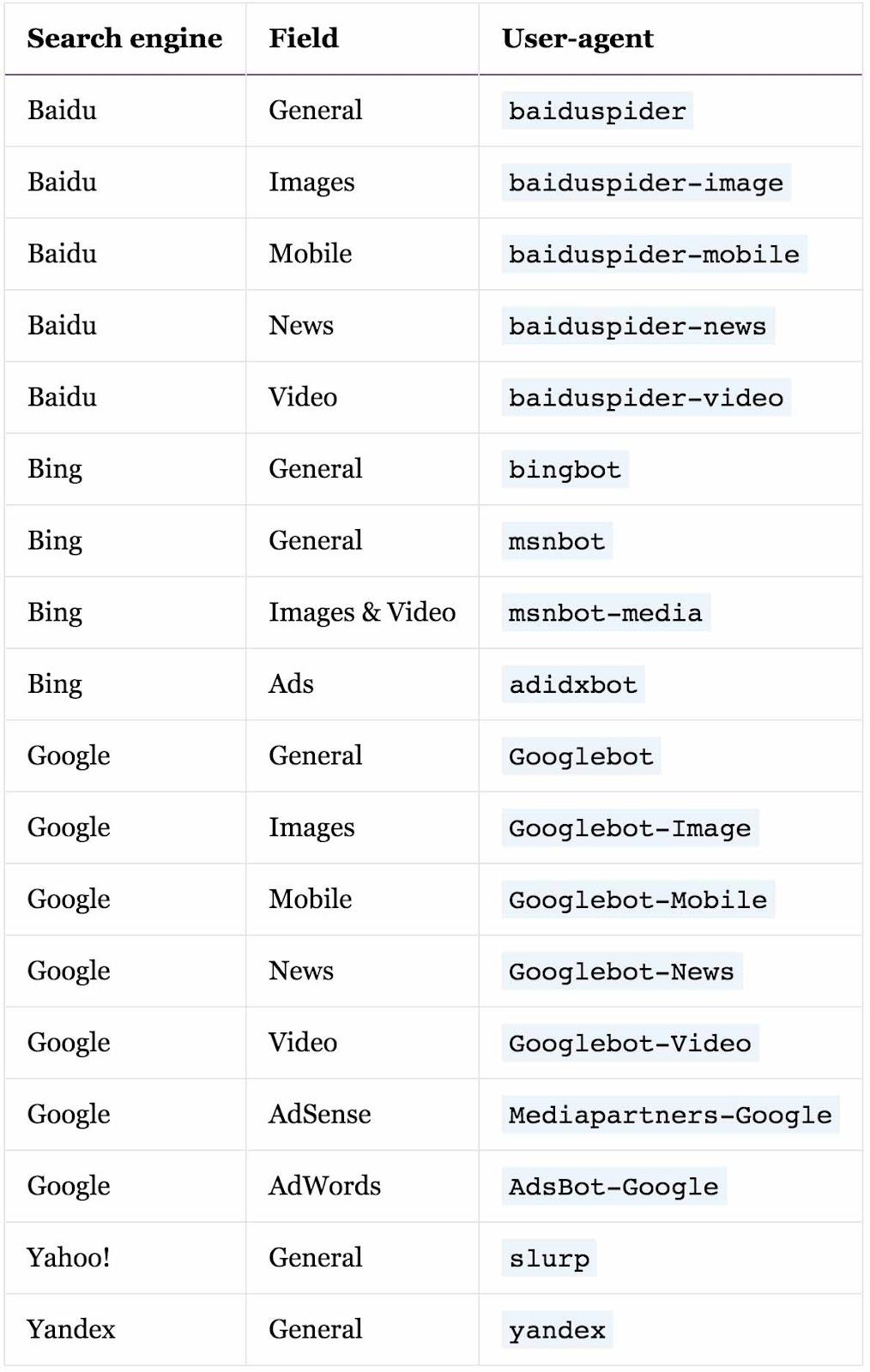

- 正如 Google 所解釋的,您在

robots.txt文件中提供的信息“無法強制抓取工具遵循您網站的規則” 。 如果“嚴重”的爬蟲(谷歌、必應、雅虎、Yandex、百度等)會尊重它們,那麼惡意機器人就不會出現這種情況,它們會試圖破壞您網站的安全性。

此外,並非所有機器人都以相同的方式解釋指令,因此請務必遵守 Google 指示的語法。 -

robots.txt文件是公共文件。 任何人都可以通過鍵入以下模板來訪問它:yoursite.com/robots.txt。 因此,不要用它來隱藏內容,人們會很快找到它隱藏的位置……如果您希望某些內容保持私密,請不要將其放在此文件中,而是使用密碼保護它。 - 如果您不希望某些頁面出現在搜索結果中, “不要使用

robots.txt文件隱藏您的網頁” ,Google 會說。 事實上,如果許多鏈接指向該頁面,Google 可能會將其編入索引並將其顯示在其搜索結果中,而不知道它包含什麼內容,即使您已在robots.txt文件中阻止了它。

為了防止頁面出現在搜索結果中,Google 建議使用所謂的noindex標籤(它可以在 Yoast SEO 中通過取消選中每個帖子下方的“允許搜索引擎在搜索結果中顯示此帖子?”框輕鬆激活/設置選項卡中的頁面)。 -

robots.txt文件有一個名為 human.txt 的表親。

這是一個 TXT 文件,也位於您網站的根目錄,其中包含有關為其設計做出貢獻的不同人員的信息。

例如,開發人員、網頁設計師、編輯等。這不是強制性的,但如果您認為將其集成到您的 WordPress 網站上很有用,則必須將其添加到您網站的根目錄中,在robots.txt文件(例如,查看來自 WPMarmite 的文件)。

你真的需要robots.txt文件嗎?

默認情況下,即使沒有robots.txt文件,搜索引擎也會正常抓取網站並為其編制索引。

因此後者不是強制性的。 正如 WordPress SEO 專家 Daniel Roch 解釋的那樣, “如果您想為所有頁面、內容和媒體編制索引,請不要使用robots.txt文件:它對您沒有任何好處” 。

但是,在剩下的時間裡,這個文件有什麼用呢?

主要的好處是在您的 SEO 方面。 事實上, robots.txt文件可以讓你保存所謂的抓取預算,這篇來自 Yoast SEO 博客的帖子說。

這是相當技術性的,但簡單地說,通過對您網站上對 SEO 不感興趣的頁面取消索引,您將為 Google 留出更多時間和精力來抓取其他頁面。

如果你想更深入地研究這個主題,來自 Backlinko 的 Brian Dean 會在這裡討論它。

現在是時候繼續配置文件了。 這很重要,相信我。 如果它沒有得到適當的優化,你可能會嚴重懲罰你在搜索引擎上的存在。

如何創建 WordPress robots.txt文件?

默認情況下,WordPress 會創建一個虛擬robots.txt文件。 它在您的服務器上無法訪問,但您可以在線查看。

以前牙買加短跑明星 Usain Bolt 的網站為例。

要查看它,您只需在瀏覽器中輸入http://usainbolt.com/robots.txt 。

這是您將得到的:

這個虛擬文件有效。 但是你如何在你的 WordPress 網站上修改這個robots.txt ?

好吧,您將不得不創建自己的文件來替換它。

有兩種方法可以做到這一點:

- 使用插件

- 手動創建

我將向您詳細展示如何操作。

如何使用 Yoast SEO 在 WordPress 上創建robots.txt文件

我敢打賭你知道 Yoast SEO,對吧? 你知道,它是一個 SEO 插件,是有史以來下載次數最多的插件之一。

WPMarmite 使用它,我還將使用它來向您展示它如何幫助您創建 WordPress robots.txt文件。

當然前提是你已經安裝並激活了這個插件。

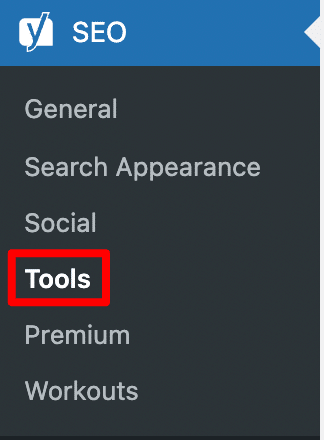

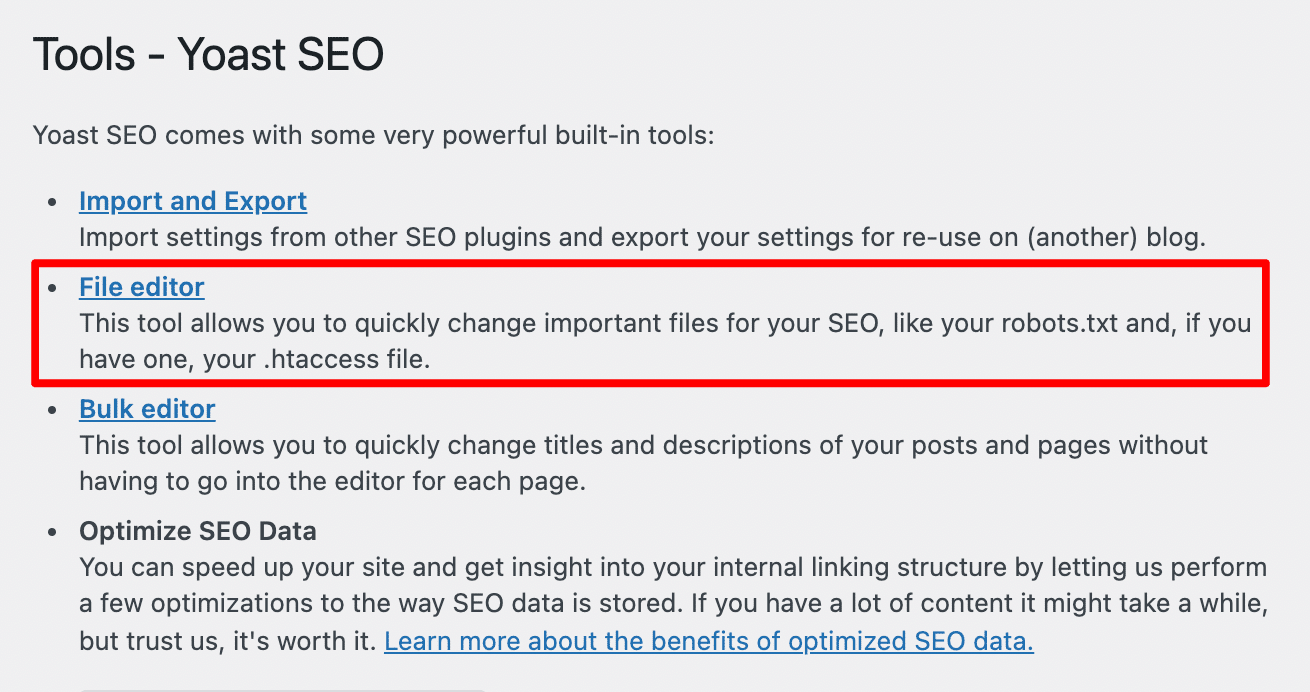

首先轉到您的 WordPress 儀表板,然後選擇Yoast SEO > 工具。

單擊“文件編輯器”繼續。

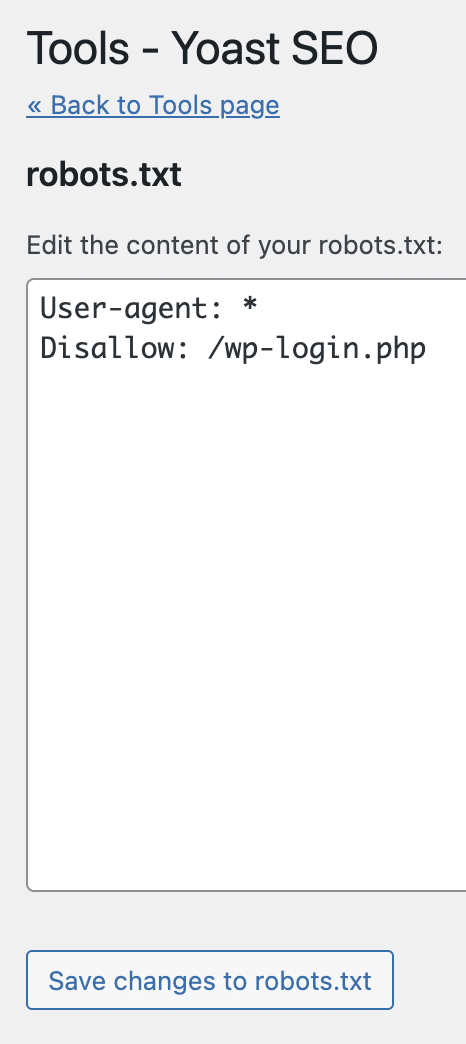

如果您還沒有專用文件,請單擊按鈕創建一個。 我的網站上已經有一個,所以我只能編輯它。 完成後不要忘記保存。

你去吧。

不用擔心,我會在這部分的最後解釋在這個文件中放入什麼信息。

目前,讓我們轉向第二種方法:你將不得不使用你的小手。

手動方法

無論您是否使用專用插件,也可以手動在您的 WordPress 網站上添加robots.txt文件。 這很簡單,你會看到的。

首先,您需要一個文本編輯器。 其中,我可以推薦:

- 括號

- 記事本++

- 崇高的文本

否則,你的舊記事本也會做得很好。

創建一個新文檔,並將其保存在您的計算機上,名稱為robots.txt 。

它的名稱必須始終小寫,並且不要忘記在 robots 一詞中加上一個“s”(不要寫

robot.txt)。

接下來,連接到您的 FTP 客戶端。 這是一個允許您與服務器通信的軟件。

就個人而言,我使用 Filezilla。 但您也可以使用 Cyberduck。 有關如何使用 FTP 的更多信息,請查看我們的帖子:如何使用 FTP 訪問您的 WordPress 文件。

此外,FTP 將在 WordPress 的安裝過程中對您有用。 閱讀我們的指南:如何安裝 WordPress:分步指南。

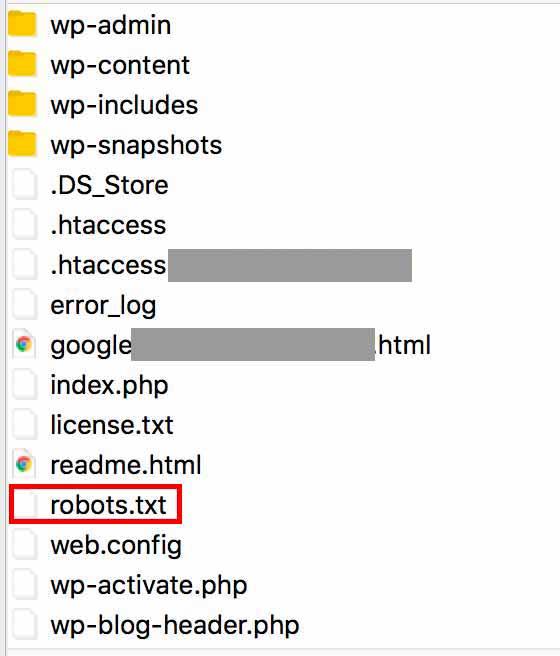

第三步也是最後一步:將文件添加到站點的根目錄。 我重複一遍,在您網站的根目錄中,而不是在子目錄中。 否則,搜索引擎將不會考慮它。

例如,如果您的站點可通過https://www.yoursite.com/訪問,則robots.txt文件應位於https://www.yoursite.com/robots.txt 。

此位置(根)可能因一台主機而異。 在 Bluehost(附屬鏈接),它被稱為

public_html。 在 OVH,您會在www名稱下找到它。

在您的網站上,它的最終實現應該如下所示:

要知道的基本規則

恭喜,您的robots.txt文件現在在您的服務器上。 目前,它是空的,但您可以隨時編輯它。

從邏輯上講,您需要問自己在其中放置什麼樣的指令。

在我們開始之前,有必要了解這個文件的特定語法。

正如穀歌在其 Search Console 幫助中解釋的那樣,“每個規則都會阻止或允許給定爬蟲訪問該網站中的指定文件路徑” 。

兩個主要規則被稱為:

-

User-agent:指規則適用的搜索引擎機器人的名稱。 -

Disallow:指定相對於根域的目錄或頁面,不應由user-agent抓取。 請記住,默認情況下,機器人可以瀏覽未被Disallow規則阻止的頁面或目錄。

讓我們研究一個簡單的例子,以便您理解。

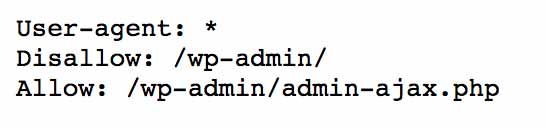

在第一行,星號*就是我們所說的通配符。 它指的是所有搜索引擎機器人( user-agent )。

在第二行,您disallow通過斜杠/訪問這些搜索引擎對您網站的所有目錄和頁面的訪問。

您不需要在斜杠前輸入您的域名(例如mysite.com/ ),因為robots.txt文件使用相對 URL。 簡單地說,它知道斜線是指你的域名的根。

顯然,如果您希望您的網站被抓取和索引,上面的代碼幾乎沒有用處。 但是當您處於站點的創建階段時,它會很有用。

如果您不希望特定類型的機器人抓取您的網站,例如 Yahoo 的(Slurp 是與 Yahoo 的機器人相關聯的名稱),您必須這樣做:

有關機器人名稱的更多信息,請參閱 Yoast SEO 網站的此屏幕截圖。

一些額外的規則

我告訴過你最常用的User-agent和Disallow 。 您應該知道還有其他語法規則,但並非所有機器人都考慮到它們(谷歌的,是的)。 其中,有:

-

Allow:允許探索不允許的目錄中的子目錄或頁面(Disallow)。 -

Sitemap:告訴機器人您的站點地圖所在的位置。 此行是可選的。 我建議您通過專用工具(例如 Google Search Console)將站點地圖提交給搜索引擎。 我在這篇文章中向您解釋瞭如何做到這一點。

為確保您理解,讓我們通過提供 3 個新示例來進一步了解。

如何阻止對目錄的訪問

我要求所有機器人不要探索wp-admin目錄的所有內容。

如何阻止對頁面或文件的訪問

在此示例中,我要求所有機器人不要索引 WordPress 登錄頁面以及照片。

您還可以看到#符號出現。 它介紹了一條評論。 後面的文字將不予考慮。

還要記住,規則是區分大小寫的。

例如, Disallow: /myphoto.jpg匹配http://www.mysite.com/myphoto.jpg ,但不匹配http://www.mysite.com/Myphoto.jpg 。

如何為不同的機器人創建不同的規則

規則總是從上到下處理。 請記住,它們始終以User-agent語句開頭,該語句指示規則適用的機器人。

在第一個中,我要求所有機器人不要索引登錄頁面( wp-login.php )。

在第二個中,我特別要求谷歌的爬蟲(Googlebot),不要爬取我的整個網站。

如何允許訪問被阻止目錄中的文件

我們使用Allow語句。 在此示例中,除了widgets.php文件之外,所有wp-admin目錄都被阻止。

如何檢查您的 robots.txt 文件是否正常工作?

為確保您的文件設置正確,您可以在 Google Search Console 上檢查和驗證它,這是一個免費且必不可少的工具,用於管理您的網站(以及其他)的 SEO。

打開 robots.txt 文件測試工具(您需要先在那裡註冊您的網站)。

在提供的編輯器中輸入您選擇的說明後,您可以測試您的文件。

如果一切順利,您應該在編輯器底部看到以下消息。

如果不是,您的文件包含邏輯錯誤或語法警告。 最後,記得提交文件,點擊“提交”按鈕。

如何在 WordPress 上優化您的 robots.txt 文件?

您應該在robots.txt文件中放入或不放入什麼?

是否有可以適應每個站點的預定義模板?

答案是:是也不是。

事實上,每個網站都是不同的,很難復制和粘貼彼得、保羅或詹姆斯在他們的網站上提出的建議。 他們的問題很可能與您的問題不同。

不過,我們可以為您提供適合大多數網站的基本robots.txt文件:

說實話,即使在 WordPress 社區內,也不可能讓每個人都同意。 意見不一。

有些人,比如 Yoast 的創始人 Joost de Valk,提倡極簡主義。 這實際上是目前的趨勢。

從本質上講,他們認為,由於 Google 能夠完整地解釋您的網站(包括 CSS 和 JavaScript 代碼,而不僅僅是 HTML),它不應該阻止對 CSS 和 JavaScript 文件的訪問,以便它可以看到您的頁面在他們的全部。 否則,它可能會影響您的 SEO。

要驗證 Google 是否有權訪問正確顯示您的頁面所需的所有資源,您可以返回 Google Search Console。 轉到“URL 檢查”選項卡,單擊“查看測試頁面”,然後單擊“屏幕截圖”。

如果您的網站看起來不應該(例如某些樣式未應用),可能是因為您的robots.txt文件中的某些規則需要審查。

但回到Yoast。 查看他們的robots.txt文件:

如您所見,沒有任何東西被阻止!

其他人則主張為您的網站採用更廣泛、“安全”的方法。 他們建議,除其他外:

- 阻止訪問兩個關鍵的 WordPress 目錄,例如

wp-admin文件夾(您網站的管理項目所在的位置)和wp-includes文件夾(其中包含所有 WordPress 文件)。 - 取消索引登錄頁面

(wp-login.php)。 - 或取消索引

readme.html文件,因為它包含您正在使用的 WordPress 版本。

簡而言之,要通過所有這些建議找到自己的方式並不容易!

總結一下,我建議你:

- 如果您不確定自己在做什麼,請堅持最低限度。 否則,對您的搜索引擎優化的後果可能是不幸的。

- 在提交之前檢查您的文件是否在 Search Console 上沒有錯誤。

如何優化您的#WordPress 網站的 robots.txt 文件? 從 WPMarmite 在本教程中回答。

結論

如您所見, robots.txt文件對您的 SEO 來說是一個有趣的工具。 它允許您告訴搜索引擎機器人他們應該和不應該抓取什麼。

但必須小心處理。 錯誤的配置可能會導致您的站點完全取消索引(例如,如果您使用Disallow: / )。 所以,要小心!

為了結束這篇文章,讓我們做一個總結。 在這些行中,我詳細說明了:

-

robots.txt文件是什麼。 - 如何在 WordPress 上安裝它。

- 如何在 WordPress 上針對 SEO 優化您的

robots.txt文件。

現在輪到你了。 告訴我您是否使用這種類型的文件以及如何設置它。

在評論中分享您的想法和反饋。