Robots.txt: как оптимизировать этот файл на веб-сайте WordPress

Опубликовано: 2022-01-21Если я попрошу вас определить, что такое файл robots.txt в WordPress, сможете ли вы дать мне прямой ответ?

Не легко, не так ли? Кроме того, вы, сами того не подозревая, наверняка уже имеете его на своем веб-сайте.

Дело в том, что мы не всегда понимаем этот знаменитый файл. Для чего это используется? Что вы в него кладете? Почему его код выглядит трудным для понимания?

Если вы когда-либо изучали эту тему, держу пари, вы задавали себе эти вопросы.

С этим файлом, немного похожим на динамит, нужно обращаться очень осторожно .

Если вы не настроите его должным образом, вы рискуете повредить SEO вашего сайта. Так что берегитесь взрыва!

В этом посте я покажу вам, как избежать катастрофы и как оптимизировать файл robots.txt WordPress. Вы узнаете, для чего он используется, как он работает, два способа его создания и что положить внутрь.

Обзор

- Что такое файл robots.txt WordPress?

- Как создать файл robots.txt для WordPress?

- Как проверить правильность работы файла robots.txt?

- Как оптимизировать файл robots.txt в WordPress?

- Вывод

Что такое файл robots.txt WordPress?

Презентация

Файл WordPress robots.txt — это текстовый файл, расположенный в корне вашего сайта, который «сообщает сканерам поисковых систем, какие URL-адреса на вашем сайте могут быть доступны сканеру» в соответствии с определением, данным Google на его справочном сайте для веб-мастеров.

Также известный как «Стандарт/протокол исключения роботов», он позволяет поисковым системам избегать индексации определенного бесполезного и/или частного контента (например, вашей страницы входа, конфиденциальных папок и файлов).

Короче говоря, этот протокол сообщает роботам поисковой системы, что они могут или не могут делать на вашем сайте.

Вот как это работает. Когда робот собирается просканировать URL-адрес вашего сайта (т. е. он собирается изучить и получить информацию, чтобы иметь возможность его индексировать), он сначала просматривает ваш файл robots.txt .

Если он его найдет, то прочитает, а затем следует указаниям, которые вы ему дали (он не сможет просканировать такой-то файл, если вы ему запретили).

Если он не найдет его, он будет сканировать ваш сайт в обычном режиме, не исключая какой-либо контент.

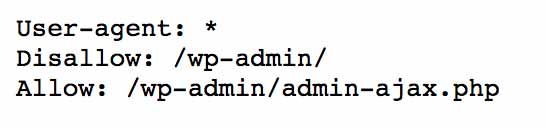

Посмотрите на этот пример robots.txt WordPress, чтобы увидеть, как он выглядит:

Не обязательно останавливаться на его содержании. Как вы увидите позже, не существует стандартного файла, который можно было бы адаптировать к любому сайту. В любом случае не рекомендуется.

Если вам нужно было вспомнить еще 4 вещи по нашей теме дня, запомните это:

- Как объясняет Google, информация, которую вы предоставляете в файле

robots.txt, «не может заставить сканер следовать правилам вашего сайта» . Если «серьезные» поисковые роботы (Google, Bing, Yahoo, Yandex, Baidu и т. д.) будут уважать их, то не в случае со злонамеренными роботами, стремящимися подорвать безопасность вашего сайта.

Более того, не все роботы одинаково интерпретируют инструкции, поэтому обязательно соблюдайте синтаксис, указанный Google. - Файл

robots.txtявляется общедоступным . Любой может получить к нему доступ, введя следующий шаблон:yoursite.com/robots.txt. Поэтому не используйте его для сокрытия контента, вы быстро найдете, где он спрятан… Если вы хотите, чтобы какой-то контент оставался приватным, не помещайте его в этот файл, а защитите, например, паролем. - Если вы не хотите, чтобы определенные страницы отображались в результатах поиска, «не используйте файл

robots.txt, чтобы скрыть свою веб-страницу» , — говорит Google. Действительно, если несколько ссылок указывают на эту страницу, возможно, что Google индексирует и отображает ее в результатах поиска, не зная, что она содержит, даже если вы заблокировали ее в своем файлеrobots.txt.

Чтобы страница не отображалась в результатах поиска, Google рекомендует использовать так называемый тегnoindex(его можно легко активировать в Yoast SEO, сняв флажок «Разрешить поисковым системам показывать этот пост в результатах поиска?», расположенный под каждым постом/ страницу во вкладке настроек). - У

robots.txtесть двоюродный брат, который называетсяhuman.txt .

Это TXT-файл, который также находится в корне вашего сайта и содержит информацию о разных людях, принимавших участие в его разработке.

Например, разработчики, веб-дизайнеры, редакторы и т. д. Это не обязательно, но если вы считаете полезным интегрировать его на свой сайт WordPress, вам придется добавить его в корень вашего сайта, рядом сrobots.txt(посмотрите, например, на WPMarmite).

Вам действительно нужен файл robots.txt ?

По умолчанию веб-сайт будет нормально просканирован и проиндексирован поисковой системой, даже без наличия robots.txt .

Следовательно, последнее не является обязательным. Как объясняет Дэниел Рох, SEO-специалист WordPress, «если вы хотите проиндексировать все свои страницы, контент и мультимедиа, не используйте файл robots.txt : это не принесет вам никакой пользы» .

Но тогда какая польза от этого файла в остальное время?

Основное преимущество должно быть найдено на стороне вашего SEO . На самом деле файл robots.txt позволяет сэкономить то, что называется краулинговым бюджетом, говорится в этом посте из блога Yoast SEO.

Это довольно технический процесс, но, проще говоря, деиндексируя страницы вашего сайта, которые не представляют интереса для SEO, вы оставляете Google больше времени и энергии для сканирования остальных.

Если вы хотите углубиться в тему, Брайан Дин из Backlinko расскажет об этом здесь.

Теперь пришло время перейти к настройке вашего файла. И это важно, поверьте. Если он не оптимизирован должным образом, вы рискуете серьезно оштрафовать свое присутствие в поисковых системах.

Как создать файл robots.txt для WordPress?

По умолчанию WordPress создает виртуальный файл robots.txt . Он недоступен на вашем сервере, но вы можете просмотреть его онлайн.

Возьмите тот, что на сайте Усэйна Болта, бывшей звезды ямайского спринта.

Чтобы увидеть это, вам просто нужно ввести в браузере http://usainbolt.com/robots.txt .

Вот что вы получите:

Этот виртуальный файл работает. Но как изменить этот robots.txt на своем веб-сайте WordPress?

Ну, вам придется создать свой собственный файл, чтобы заменить его.

Есть два способа сделать это:

- Использовать плагин

- Создайте его вручную

Я покажу вам, как это сделать в деталях.

Как создать файл robots.txt на WordPress с помощью Yoast SEO

Готов поспорить, вы знаете Yoast SEO, верно? Знаете, это SEO-плагин, один из самых скачиваемых за все время.

WPMarmite использует его, и я также собираюсь использовать его, чтобы показать вам, как он может помочь вам создать файл robots.txt для WordPress.

Конечно, обязательным условием является то, что вы установили и активировали этот плагин.

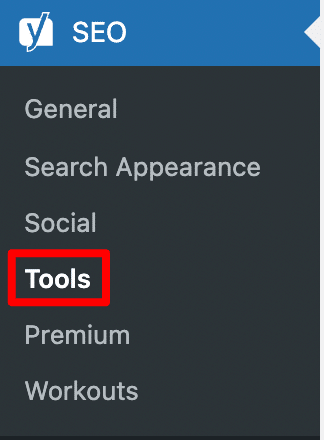

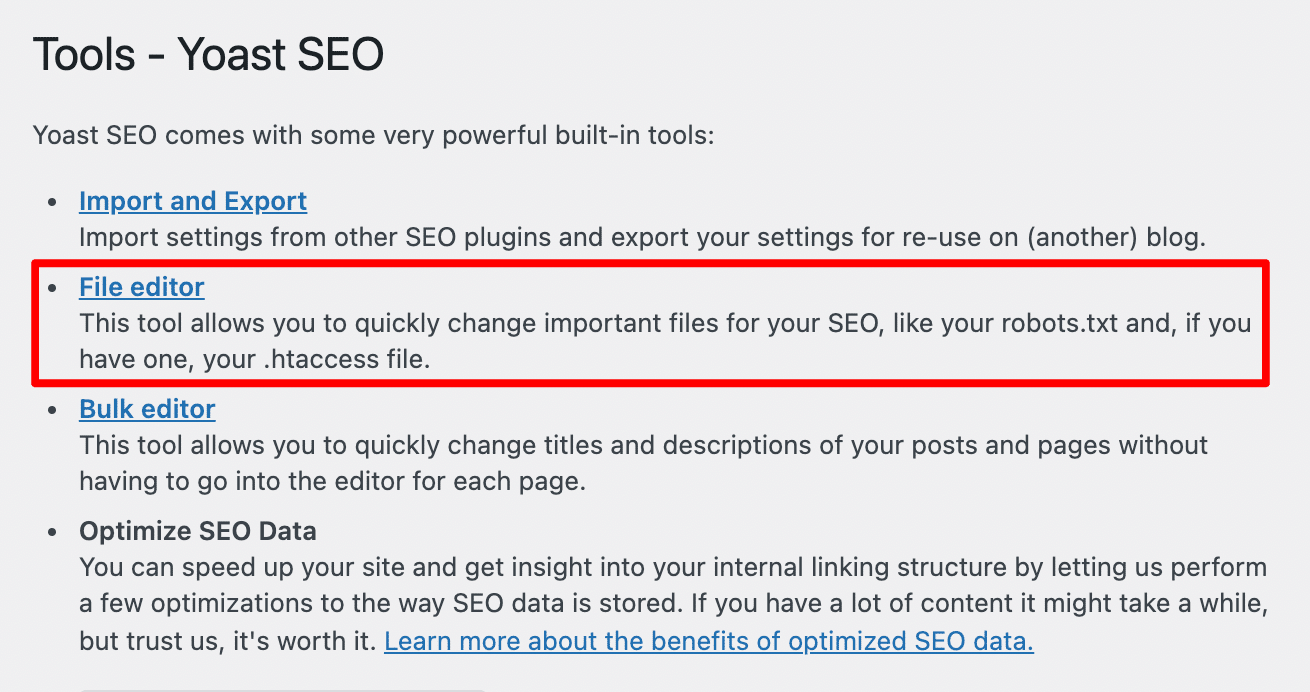

Начните с перехода на панель инструментов WordPress и выберите Yoast SEO > Tools .

Продолжите, нажав «Редактор файлов».

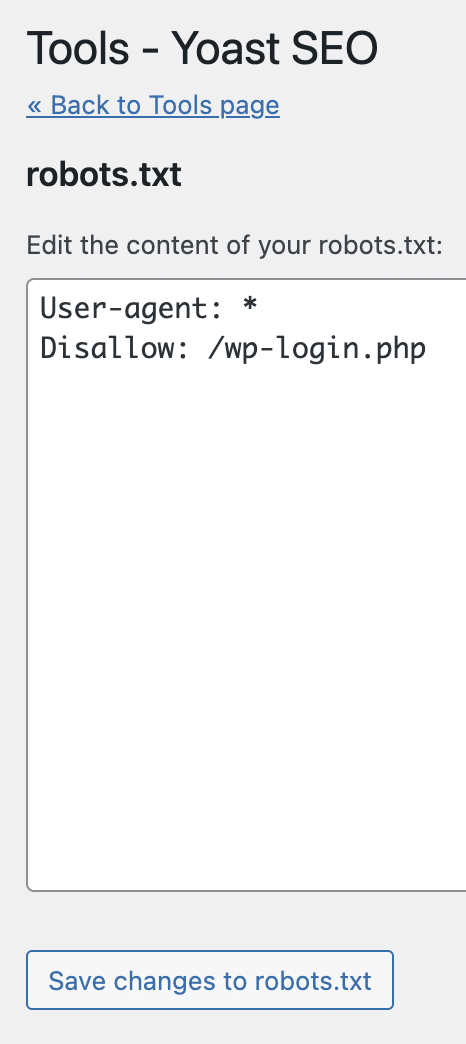

Если у вас еще нет специального файла, нажмите кнопку, чтобы создать его. У меня уже был один на моем сайте, поэтому я мог только редактировать его. И не забудьте сохраниться, когда закончите.

Вот и все.

Не беспокойтесь, в конце этой части я объясню, какую информацию нужно поместить в этот файл.

А пока давайте перейдем ко второму способу: вам придется использовать свои маленькие ручки.

Ручной метод

Независимо от того, используете ли вы специальный плагин или нет, вы также можете добавить файл robots.txt на свой веб-сайт WordPress вручную. Это очень просто, вот увидишь.

Во-первых, вам понадобится текстовый редактор. Среди них могу порекомендовать:

- Скобки

- Блокнот++

- Возвышенный текст

В противном случае ваш старый добрый Блокнот тоже будет работать очень хорошо.

Создайте новый документ и сохраните его на своем компьютере под именем robots.txt .

Его имя всегда должно быть в нижнем регистре, и не забывайте ставить «s» в слове robots (не пишите

robot.txt).

Затем подключитесь к FTP-клиенту. Это программное обеспечение, которое позволяет вам общаться с вашим сервером.

Лично я использую Filezilla. Но вы также можете использовать Cyberduck. Для получения дополнительной информации о том, как использовать FTP, ознакомьтесь с нашей статьей: Как использовать FTP для доступа к вашим файлам WordPress.

Также FTP будет полезен вам в процессе установки WordPress. Прочтите наше руководство об этом: Как установить WordPress: пошаговое руководство.

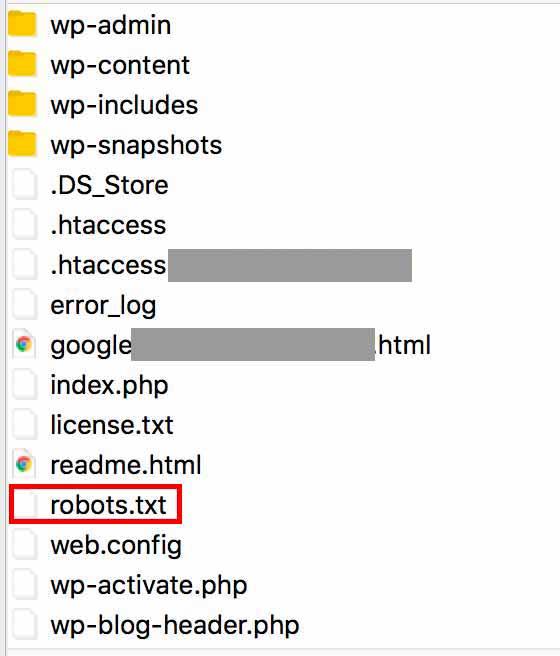

Третий и последний шаг: добавьте ваш файл в корень вашего сайта . Повторюсь, в корне вашего сайта, а не в подкаталоге. В противном случае поисковые системы не примут его во внимание.

Например, если ваш сайт доступен через https://www.yoursite.com/ , файл robots.txt должен находиться по адресу https://www.yoursite.com/robots.txt .

Это расположение (корень) может варьироваться от одного хоста к другому. На Bluehost (партнерская ссылка) он называется

public_html. В OVH вы найдете его под названиемwww.

Его окончательная реализация должна выглядеть так на вашем сайте:

Основные правила, которые нужно знать

Поздравляем, ваш файл robots.txt теперь на вашем сервере. На данный момент он пуст, но вы можете редактировать его, когда захотите.

По логике, вам нужно спросить себя, какие инструкции туда вставить.

Прежде чем мы перейдем к этому, необходимо понять особый синтаксис этого файла.

«Каждое правило блокирует или разрешает доступ для данного поискового робота к указанному пути к файлу на этом веб-сайте» , — объясняет Google в своей справке Search Console.

Два основных правила называются:

-

User-agent: относится к имени робота поисковой системы, к которому применяется правило. -

Disallow: указывает каталог или страницу относительно корневого домена, которые не должны сканироватьсяuser-agent. Помните, что по умолчанию робот может исследовать страницу или каталог, не заблокированный правиломDisallow.

Давайте изучим простой пример, чтобы вы поняли.

В первой строке звездочка * — это то, что мы называем подстановочным знаком. Это относится ко всем роботам поисковых систем ( user-agent ).

Во второй строке вы disallow этим поисковым системам доступ ко всем каталогам и страницам вашего сайта через косую черту / .

Вам не нужно вводить свое доменное имя (например mysite.com/ ) перед косой чертой, поскольку в файле robots.txt используются относительные URL-адреса. Проще говоря, он знает, что косая черта относится к корню вашего доменного имени.

Очевидно, что приведенный выше код бесполезен, если вы хотите, чтобы ваш сайт сканировался и индексировался. Но это может быть полезно, когда вы находитесь на этапе создания своего сайта.

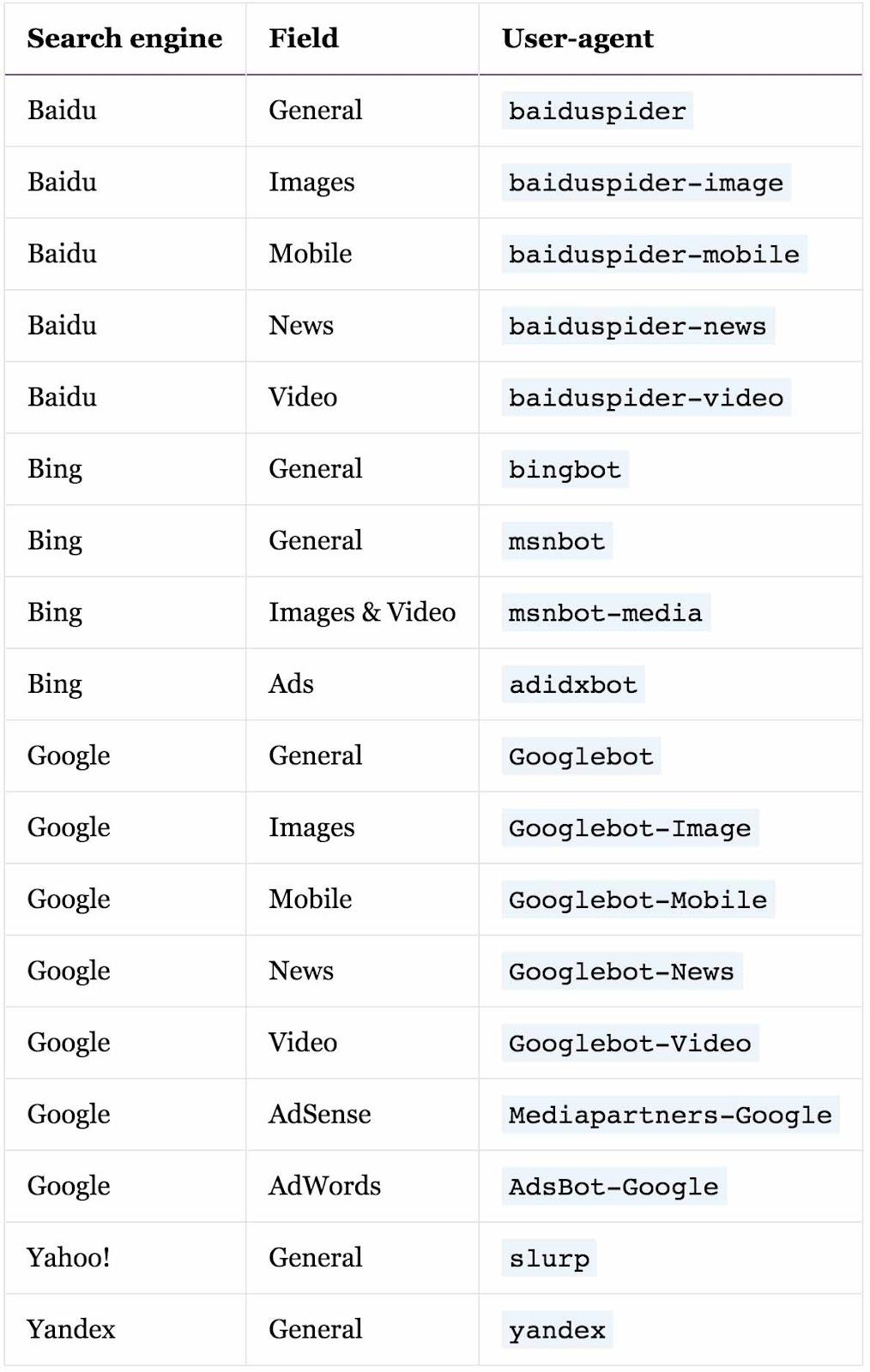

Если вы не хотите, чтобы определенный тип робота сканировал ваш сайт, например робот Yahoo (Slurp — это имя, связанное с роботом Yahoo), вам придется сделать следующее:

Для получения дополнительной информации об именах роботов я отсылаю вас к этому снимку экрана с сайта Yoast SEO.

Некоторые дополнительные правила

Я рассказал вам о User-agent и Disallow , которые используются чаще всего. Вы должны знать, что есть и другие синтаксические правила, но они учитываются не всеми роботами (да, Google). Среди них есть:

-

Allow: Разрешить исследование подкаталога или страницы в каталоге, который не разрешен (Disallow). -

Sitemap: сообщает роботам, где находится ваша карта сайта. Эта строка не является обязательной. Я рекомендую вам отправлять карту сайта в поисковые системы с помощью специального инструмента, такого как Google Search Console. Я объясню вам, как это сделать в этом посте.

Чтобы убедиться, что вы понимаете, давайте пойдем немного дальше, предоставив вам 3 новых примера.

Как заблокировать доступ к каталогу

Прошу всех роботов не исследовать все содержимое каталога wp-admin .

Как заблокировать доступ к странице или файлу

В этом примере я прошу всех роботов не индексировать страницу входа в WordPress, а также фотографию.

Вы также можете увидеть появление символа # . Он вводит комментарий. Текст за ним не будет учитываться.

Также имейте в виду, что правила чувствительны к регистру.

Например, Disallow: /myphoto.jpg соответствует http://www.mysite.com/myphoto.jpg , но не http://www.mysite.com/Myphoto.jpg .

Как создать разные правила для разных роботов

Правила всегда обрабатываются сверху вниз. Помните, что они всегда начинаются с оператора User-agent , который указывает на робота, к которому применяется правило.

В первом я прошу всех роботов не индексировать страницу входа ( wp-login.php ).

Во втором я специально прошу поисковый робот Google (Googlebot) не сканировать весь мой сайт.

Как разрешить доступ к файлу в заблокированном каталоге

Мы используем оператор Allow . В этом примере заблокирован весь каталог wp-admin , кроме файла widgets.php .

Как проверить правильность работы файла robots.txt?

Чтобы убедиться, что ваш файл настроен правильно, вы можете проверить его в Google Search Console — бесплатном и необходимом инструменте для управления SEO вашего сайта (среди прочего).

Откройте инструмент тестирования файла robots.txt (сначала вам нужно зарегистрировать там свой сайт).

После того, как вы ввели инструкции по вашему выбору в предоставленном редакторе, вы можете протестировать свой файл.

Если все хорошо, вы должны увидеть следующее сообщение в нижней части редактора.

В противном случае ваш файл содержит логические ошибки или синтаксические предупреждения. Наконец, не забудьте отправить файл, нажав кнопку «Отправить».

Как оптимизировать файл robots.txt в WordPress?

Что следует или не следует указывать в файле robots.txt ?

Есть ли готовый шаблон, который можно адаптировать для каждого сайта?

Ответ: и да, и нет.

Действительно, каждый сайт уникален, и было бы трудно скопировать и вставить то, что Питер, Пол или Джеймс предлагают на своих сайтах. Их проблемы, скорее всего, будут отличаться от ваших.

Тем не менее, мы можем дать вам базовый файл robots.txt , который подойдет большинству сайтов:

По правде говоря, даже в сообществе WordPress невозможно добиться согласия всех. Мнения расходятся.

Некоторые, как Йост де Валк, основатель Yoast, выступают за минимализм. На самом деле это современная тенденция .

По сути, они считают, что, поскольку Google может полностью интерпретировать ваш сайт (включая код CSS и JavaScript, а не только HTML), он не должен блокировать доступ к файлам CSS и JavaScript, чтобы он мог видеть ваши страницы. в полном объеме. В противном случае это может повлиять на ваше SEO.

Чтобы убедиться, что у Google есть доступ ко всем ресурсам, необходимым для правильного отображения вашей страницы, вы можете вернуться в Google Search Console. Перейдите на вкладку «Проверка URL», нажмите «Просмотреть проверенную страницу», а затем нажмите «Снимок экрана».

Если ваш сайт выглядит не так, как должен (например, некоторые стили не применяются), возможно, это связано с необходимостью пересмотра некоторых правил в файле robots.txt .

Но вернемся к Йоасту. Посмотрите на их файл robots.txt :

Как видите, ничего не заблокировано!

Другие выступают за более широкий, «безопасный» подход к вашему сайту. Среди прочего они советуют:

- Запретите доступ к двум ключевым каталогам WordPress , таким как папка

wp-admin(где расположены административные элементы вашего веб-сайта) и папкаwp-includes(в которой находятся все файлы WordPress). - Деиндексировать страницу входа

(wp-login.php). - Или деиндексировать файл

readme.html, потому что он содержит версию WordPress, которую вы используете.

Одним словом, разобраться во всех этих рекомендациях непросто!

Подводя итог, советую:

- Придерживайтесь минимума, если вы не уверены в том, что делаете . В противном случае последствия для вашего SEO могут быть плачевными.

- Прежде чем отправлять файл, убедитесь, что он не содержит ошибок в Search Console .

Как оптимизировать файл robots.txt вашего сайта #WordPress? Ответ в этом уроке от WPMarmite.

Вывод

Как вы видели, файл robots.txt — интересный инструмент для вашего SEO. Это позволяет указать роботам поисковых систем, что они должны и не должны сканировать.

Но с ним нужно обращаться осторожно. Неправильная конфигурация может привести к полной деиндексации вашего сайта (например, если вы используете Disallow: / ). Так что будьте осторожны!

Чтобы закончить этот пост, давайте подведем итоги. В этих строках я подробно описал:

- Что такое файл

robots.txt. - Как установить на WordPress .

- Как оптимизировать файл

robots.txtна WordPress для SEO.

Теперь твоя очередь. Скажите, используете ли вы этот тип файла и как вы его настраиваете.

Делитесь своими мыслями и отзывами в комментариях.