Robots.txt: So optimieren Sie diese Datei auf einer WordPress-Website

Veröffentlicht: 2022-01-21Wenn ich Sie bitte, zu definieren, was eine robots.txt -Datei in WordPress ist, können Sie mir eine klare Antwort geben?

Nicht einfach, oder? Außerdem haben Sie, ohne es zu wissen, wahrscheinlich bereits einen auf Ihrer Website.

Die Sache ist die, dass wir diese berühmte Datei nicht immer verstehen. Was wird es verwendet? Was stellst du hinein? Warum sieht sein Code schwer zu verstehen aus?

Wenn Sie sich jemals mit dem Thema befasst haben, haben Sie sich bestimmt diese Fragen gestellt.

Ein bisschen wie Dynamit muss diese Datei mit großer Sorgfalt behandelt werden .

Wenn Sie es nicht richtig einrichten, riskieren Sie, die SEO Ihrer Website zu beschädigen. Also Vorsicht vor der Explosion!

In diesem Beitrag zeige ich Ihnen, wie Sie die Katastrophe vermeiden und Ihre WordPress robots.txt -Datei optimieren können. Sie werden entdecken, wofür es verwendet wird, wie es funktioniert, zwei Möglichkeiten, es zu erstellen, und was Sie hineinlegen müssen.

Überblick

- Was ist die WordPress robots.txt-Datei?

- Wie erstelle ich eine WordPress robots.txt-Datei?

- Wie können Sie überprüfen, ob Ihre robots.txt-Datei ordnungsgemäß funktioniert?

- Wie kann man seine robots.txt-Datei auf WordPress optimieren?

- Fazit

Was ist die WordPress robots.txt-Datei?

Präsentation

Eine WordPress robots.txt -Datei ist eine Textdatei, die sich im Stammverzeichnis Ihrer Website befindet und „Suchmaschinen-Crawlern mitteilt, auf welche URLs der Crawler auf Ihrer Website zugreifen kann“ , gemäß der Definition von Google auf seiner Webmaster-Hilfeseite.

Auch als „Robots Exclusion Standard/Protocol“ bezeichnet, ermöglicht es Suchmaschinen, die Indizierung bestimmter nutzloser und/oder privater Inhalte (z. B. Ihre Anmeldeseite, vertrauliche Ordner und Dateien) zu vermeiden.

Kurz gesagt, dieses Protokoll teilt den Robotern einer Suchmaschine mit, was sie auf Ihrer Website tun oder nicht tun können.

So funktioniert es. Wenn ein Robot im Begriff ist, eine URL Ihrer Website zu crawlen (dh er wird Informationen durchsuchen und abrufen, um sie indizieren zu können), wird er zuerst Ihre robots.txt -Datei prüfen.

Wenn es sie findet, wird es sie lesen und dann den Anweisungen folgen, die Sie ihm gegeben haben (es wird nicht in der Lage sein, diese und jene Datei zu crawlen, wenn Sie es verboten haben).

Wenn es ihn nicht findet, wird es Ihre Website auf normale Weise durchsuchen, ohne Inhalte auszuschließen.

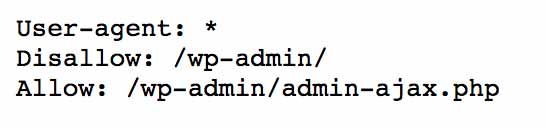

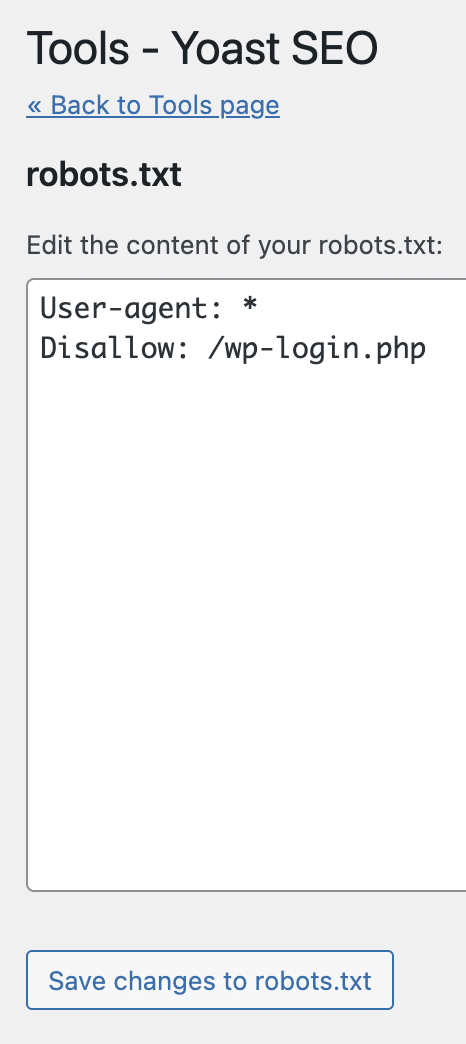

Sehen Sie sich dieses Beispiel einer WordPress robots.txt -Datei an, um zu sehen, wie sie aussieht:

Halten Sie nicht unbedingt beim Inhalt an. Wie Sie später sehen werden, gibt es keine Standarddatei, die an jede Site angepasst werden kann. In jedem Fall ist es nicht zu empfehlen.

Wenn Sie sich noch 4 Dinge zu unserem Tagesthema merken mussten, holen Sie sich diese in Ihren Kopf:

- Wie Google erklärt, können die Informationen, die Sie in Ihrer

robots.txt-Datei bereitstellen, „den Crawler nicht dazu zwingen, die Regeln Ihrer Website zu befolgen“ . Wenn die „seriösen“ Crawler (Google, Bing, Yahoo, Yandex, Baidu usw.) sie respektieren, gilt dies nicht für böswillige Roboter, die versuchen, die Sicherheit Ihrer Website zu untergraben.

Außerdem interpretieren nicht alle Roboter Anweisungen auf die gleiche Weise, achten Sie also darauf, die von Google angegebene Syntax zu respektieren. - Die

robots.txt-Datei ist eine öffentliche Datei . Jeder kann darauf zugreifen, indem er die folgende Vorlage eingibt:yoursite.com/robots.txt. Verwenden Sie es daher nicht, um Inhalte zu verstecken, man findet schnell, wo sie versteckt sind… Wenn Sie möchten, dass einige Inhalte privat bleiben, legen Sie sie nicht in diese Datei, sondern schützen Sie sie beispielsweise mit einem Passwort. - Wenn Sie nicht möchten, dass bestimmte Seiten in den Suchergebnissen erscheinen, „verwenden Sie nicht die

robots.txt-Datei, um Ihre Webseite auszublenden“ , sagt Google. Wenn mehrere Links auf diese Seite verweisen, ist es möglich, dass Google sie indiziert und in ihren Suchergebnissen anzeigt, ohne zu wissen, was sie enthält, selbst wenn Sie sie in Ihrerrobots.txt-Datei blockiert haben.

Um zu verhindern, dass eine Seite in den Suchergebnissen erscheint, empfiehlt Google die Verwendung eines sogenanntennoindex-Tags (es kann einfach in Yoast SEO aktiviert werden, indem das Kontrollkästchen „Suchmaschinen erlauben, diesen Beitrag in Suchergebnissen anzuzeigen?“ unter jedem Beitrag deaktiviert wird/ Seite in der Registerkarte Einstellungen). - Die Datei „

robots.txt“ hat einen Cousin namens „humans.txt“ .

Dies ist eine TXT-Datei, die sich ebenfalls im Stammverzeichnis Ihrer Website befindet und Informationen über die verschiedenen Personen enthält, die zum Design beigetragen haben.

Zum Beispiel Entwickler, Webdesigner, Redakteure usw. Es ist nicht obligatorisch, aber wenn Sie es für nützlich halten, es in Ihre WordPress-Site zu integrieren, müssen Sie es neben denrobots.txt-Datei (sehen Sie sich zum Beispiel die von WPMarmite an).

Benötigen Sie wirklich eine robots.txt -Datei?

Standardmäßig wird eine Website normal von einer Suchmaschine gecrawlt und indexiert, auch ohne das Vorhandensein einer robots.txt -Datei.

Letzteres ist daher nicht zwingend erforderlich. Wie Daniel Roch, ein WordPress-SEO-Spezialist, erklärt: „Wenn Sie alle Ihre Seiten, Inhalte und Medien indizieren möchten, verwenden Sie nicht die robots.txt -Datei: Sie wird Ihnen nichts nützen“ .

Aber welchen Nutzen kann diese Datei für den Rest der Zeit haben?

Der Hauptnutzen ist auf der Seite Ihrer SEO zu finden . Tatsächlich ermöglicht Ihnen eine robots.txt -Datei, das sogenannte Crawl-Budget zu speichern, heißt es in diesem Beitrag aus dem Yoast SEO-Blog.

Es ist ziemlich technisch, aber einfach gesagt, indem Sie die Seiten auf Ihrer Website, die kein SEO-Interesse haben, deindexieren, lassen Sie Google mehr Zeit und Energie, um die anderen zu crawlen.

Wenn Sie tiefer in das Thema einsteigen möchten, spricht Brian Dean von Backlinko hier darüber.

Jetzt ist es an der Zeit, mit der Konfiguration Ihrer Datei fortzufahren. Und das ist wichtig, glauben Sie mir. Wenn es nicht richtig optimiert ist, riskieren Sie, Ihre Präsenz in Suchmaschinen ernsthaft zu benachteiligen.

Wie erstelle ich eine WordPress robots.txt -Datei?

Standardmäßig erstellt WordPress eine virtuelle robots.txt -Datei . Es ist auf Ihrem Server nicht zugänglich, aber Sie können es online anzeigen.

Nehmen Sie die Seite von Usain Bolt, dem ehemaligen jamaikanischen Sprintstar.

Um es zu sehen, müssen Sie nur http://usainbolt.com/robots.txt in Ihren Browser eingeben.

Hier ist, was Sie bekommen:

Diese virtuelle Datei funktioniert. Aber wie ändern Sie diese robots.txt auf Ihrer WordPress-Website?

Nun, Sie müssen Ihre eigene Datei erstellen, um sie zu ersetzen.

Dazu gibt es zwei Möglichkeiten:

- Verwenden Sie ein Plugin

- Erstellen Sie es manuell

Ich zeige dir, wie es im Detail geht.

So erstellen Sie eine robots.txt -Datei auf WordPress mit Yoast SEO

Ich wette, Sie kennen Yoast SEO, oder? Wissen Sie, es ist ein SEO-Plugin, eines der am häufigsten heruntergeladenen aller Zeiten.

WPMarmite verwendet es, und ich werde es auch verwenden, um Ihnen zu zeigen, wie es Ihnen helfen kann, eine WordPress robots.txt -Datei zu erstellen.

Voraussetzung ist natürlich, dass Sie dieses Plugin installiert und aktiviert haben.

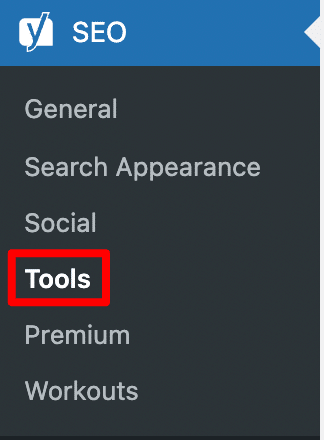

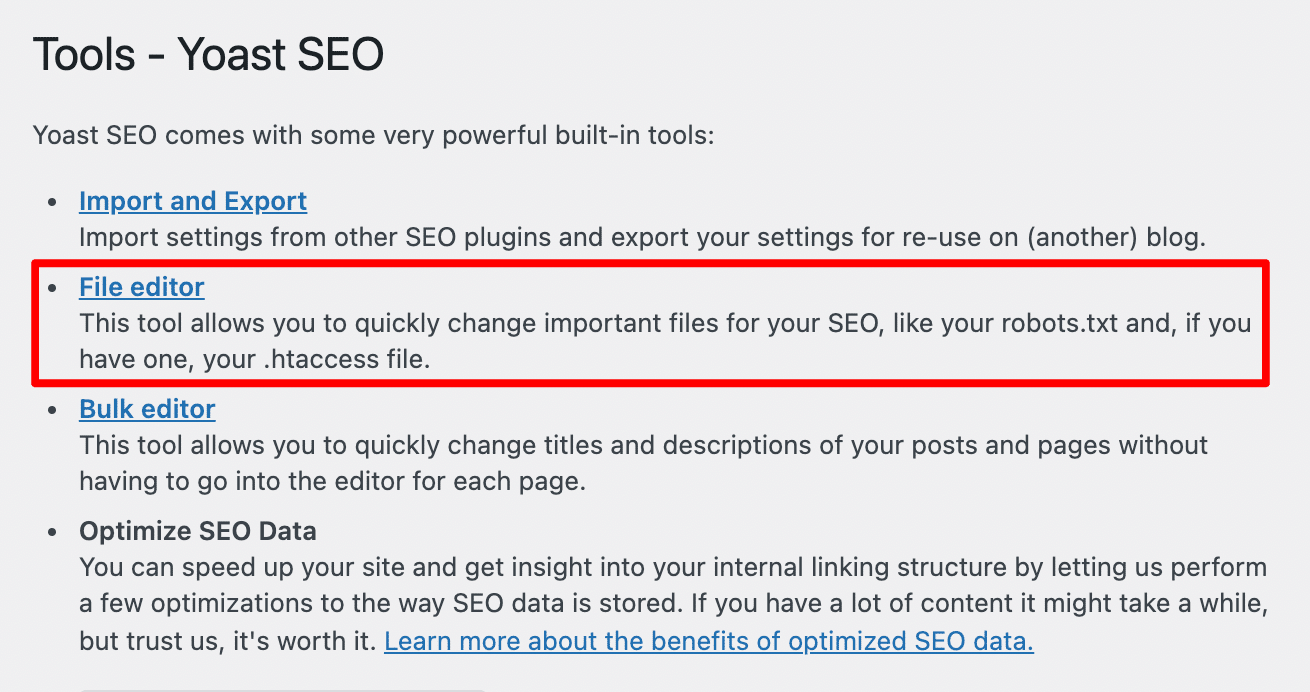

Gehen Sie zunächst zu Ihrem WordPress-Dashboard und wählen Sie Yoast SEO > Tools .

Fahren Sie fort, indem Sie auf „Datei-Editor“ klicken.

Wenn Sie noch keine dedizierte Datei haben, klicken Sie auf die Schaltfläche, um eine zu erstellen. Ich hatte bereits einen auf meiner Website, also konnte ich ihn nur bearbeiten. Und vergessen Sie nicht zu speichern, wenn Sie fertig sind.

Und los geht's.

Keine Sorge, ich werde am Ende dieses Teils erklären, welche Informationen in dieser Datei abgelegt werden müssen.

Kommen wir zunächst zur zweiten Methode: Sie müssen Ihre kleinen Hände benutzen.

Die manuelle Methode

Unabhängig davon, ob Sie ein dediziertes Plugin verwenden oder nicht, ist es auch möglich, manuell eine robots.txt -Datei auf Ihrer WordPress-Website hinzuzufügen . Es ist ganz einfach, du wirst sehen.

Zunächst benötigen Sie einen Texteditor. Darunter kann ich empfehlen:

- Klammern

- Notepad++

- Erhabener Text

Ansonsten macht sich auch Ihr guter alter Notepad sehr gut.

Erstellen Sie ein neues Dokument und speichern Sie es auf Ihrem Computer unter dem Namen robots.txt .

Der Name muss immer in Kleinbuchstaben geschrieben werden, und vergessen Sie nicht, ein „s“ in das Wort robots einzufügen (schreiben Sie nicht

robot.txt).

Verbinden Sie sich als Nächstes mit Ihrem FTP-Client. Dies ist eine Software, mit der Sie mit Ihrem Server kommunizieren können.

Ich persönlich verwende Filezilla. Sie können aber auch Cyberduck verwenden. Weitere Informationen zur Verwendung von FTP finden Sie in unserem Beitrag: So verwenden Sie FTP für den Zugriff auf Ihre WordPress-Dateien.

Außerdem wird das FTP für Sie beim Installationsprozess von WordPress nützlich sein. Lesen Sie unsere Anleitung dazu: So installieren Sie WordPress: eine Schritt-für-Schritt-Anleitung.

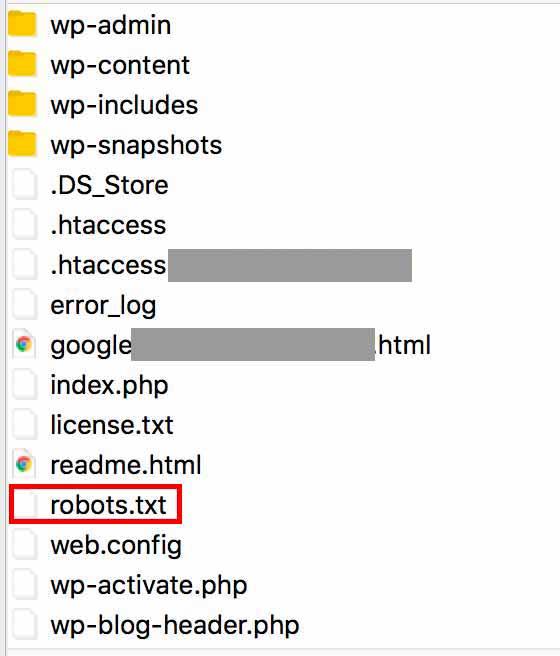

Dritter und letzter Schritt: Fügen Sie Ihre Datei zum Stammverzeichnis Ihrer Website hinzu . Ich wiederhole, im Stammverzeichnis Ihrer Website und nicht in einem Unterverzeichnis. Andernfalls werden Suchmaschinen es nicht berücksichtigen.

Wenn Ihre Website beispielsweise über https://www.yoursite.com/ erreichbar ist, sollte sich die robots.txt -Datei unter https://www.yoursite.com/robots.txt befinden.

Dieser Speicherort (der Stamm) kann von einem Host zum anderen variieren. Bei Bluehost (Affiliate-Link) heißt es

public_html. Bei OVH finden Sie es unter dem Namenwww.

Die endgültige Implementierung sollte auf Ihrer Website wie folgt aussehen:

Die wichtigsten Regeln, die Sie kennen sollten

Herzlichen Glückwunsch, Ihre robots.txt -Datei befindet sich jetzt auf Ihrem Server. Im Moment ist es leer, aber Sie können es jederzeit bearbeiten.

Logischerweise müssen Sie sich fragen, welche Art von Anweisungen Sie dort einfügen müssen.

Bevor wir dazu kommen, ist es notwendig, die besondere Syntax dieser Datei zu verstehen.

„Jede Regel blockiert oder erlaubt einem bestimmten Crawler den Zugriff auf einen bestimmten Dateipfad auf dieser Website“, wie Google in seiner Search Console-Hilfe erklärt.

Die beiden Hauptregeln heißen:

-

User-agent: Bezieht sich auf den Namen eines Suchmaschinen-Roboters, für den die Regel gilt. -

Disallow: Bezeichnet ein Verzeichnis oder eine Seite relativ zur Root-Domain, die nicht vomuser-agentgecrawlt werden soll. Denken Sie daran, dass ein Robot standardmäßig eine Seite oder ein Verzeichnis erkunden kann, das nicht durch eineDisallow-Regel blockiert ist.

Lassen Sie uns ein einfaches Beispiel studieren, damit Sie verstehen.

In der ersten Zeile ist das Sternchen * ein sogenannter Platzhalter. Es bezieht sich auf alle Suchmaschinen-Robots ( user-agent ).

In der zweiten Zeile disallow Sie diesen Suchmaschinen den Zugriff auf alle Verzeichnisse und Seiten Ihrer Website über den Schrägstrich / .

Sie müssen Ihren Domänennamen (z. B. mysite.com/ ) nicht vor dem Schrägstrich eingeben, da die robots.txt -Datei relative URLs verwendet. Einfach ausgedrückt, es weiß, dass sich der Schrägstrich auf den Stamm Ihres Domainnamens bezieht.

Offensichtlich ist der obige Code von geringem Nutzen, wenn Sie möchten, dass Ihre Website gecrawlt und indexiert wird. Aber es kann nützlich sein, wenn Sie sich in der Erstellungsphase Ihrer Website befinden.

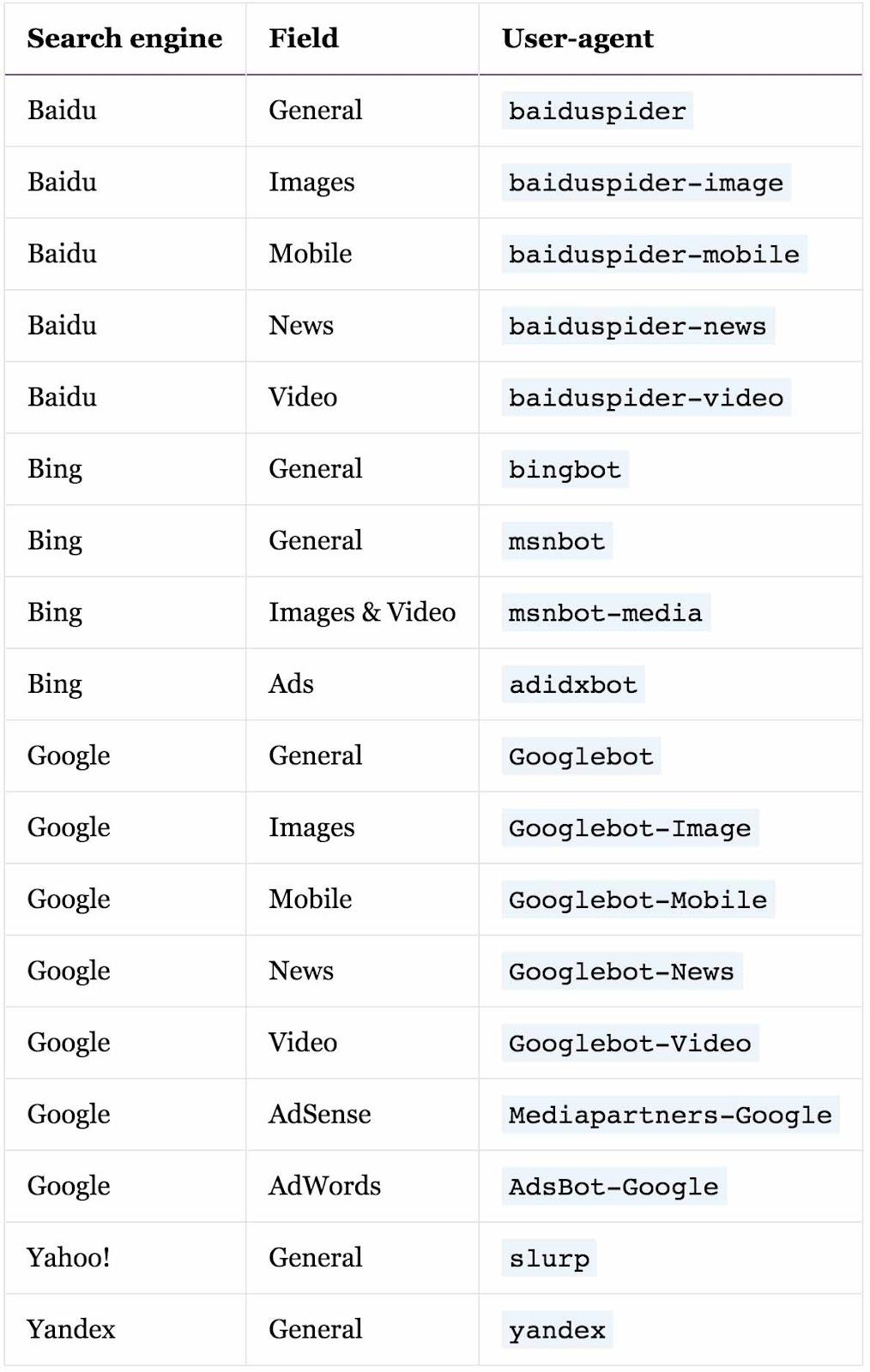

Wenn Sie nicht möchten, dass ein bestimmter Robotertyp Ihre Website crawlt, zum Beispiel der von Yahoo (Slurp ist der Name, der mit dem Roboter von Yahoo verknüpft ist), müssen Sie Folgendes tun:

Für weitere Informationen zu Roboternamen verweise ich Sie auf diesen Screenshot von der Yoast SEO-Website.

Einige zusätzliche Regeln

Ich habe Ihnen von User-agent und Disallow erzählt, die am häufigsten verwendet werden. Sie sollten wissen, dass es andere Syntaxregeln gibt, die jedoch nicht von allen Robotern berücksichtigt werden (von Google, ja). Unter ihnen gibt es:

-

Allow: Erlaubt das Durchsuchen eines Unterverzeichnisses oder einer Seite in einem nicht erlaubten Verzeichnis (Disallow). -

Sitemap: Teilt den Robotern mit, wo sich Ihre Sitemap befindet. Diese Zeile ist optional. Ich empfehle Ihnen, Ihre Sitemap über ein spezielles Tool wie die Google Search Console an Suchmaschinen zu übermitteln. Wie das geht, erkläre ich dir in diesem Beitrag.

Um sicherzugehen, dass Sie es verstehen, gehen wir ein wenig weiter und geben Ihnen 3 neue Beispiele.

So blockieren Sie den Zugriff auf ein Verzeichnis

Ich bitte alle Roboter, nicht den gesamten Inhalt des wp-admin Verzeichnisses zu durchsuchen.

So blockieren Sie den Zugriff auf eine Seite oder eine Datei

In diesem Beispiel bitte ich alle Roboter, die WordPress-Anmeldeseite sowie ein Foto nicht zu indizieren.

Sie können auch sehen, dass das # -Symbol erscheint. Es leitet einen Kommentar ein. Der Text dahinter wird nicht berücksichtigt.

Beachten Sie auch, dass bei den Regeln zwischen Groß- und Kleinschreibung unterschieden wird.

Beispiel: Disallow: /myphoto.jpg stimmt mit http://www.mysite.com/myphoto.jpg überein, aber nicht mit http://www.mysite.com/Myphoto.jpg .

So erstellen Sie unterschiedliche Regeln für unterschiedliche Roboter

Regeln werden immer von oben nach unten abgearbeitet. Denken Sie daran, dass sie immer mit der User-agent Anweisung beginnen, die den Roboter angibt, für den die Regel gilt.

Im ersten bitte ich alle Robots, die Anmeldeseite ( wp-login.php ) nicht zu indizieren.

Im zweiten bitte ich ausdrücklich den Crawler von Google (Googlebot), nicht meine ganze Seite zu crawlen.

So erlauben Sie den Zugriff auf eine Datei in einem gesperrten Verzeichnis

Wir verwenden die Allow Anweisung. In diesem Beispiel ist das gesamte Verzeichnis wp-admin blockiert, mit Ausnahme der Datei widgets.php .

Wie können Sie überprüfen, ob Ihre robots.txt-Datei ordnungsgemäß funktioniert?

Um sicherzustellen, dass Ihre Datei korrekt eingerichtet ist, können Sie sie in der Google Search Console überprüfen und validieren, einem kostenlosen und unverzichtbaren Tool zur Verwaltung der SEO Ihrer Website (unter anderem).

Öffnen Sie das Testtool für die robots.txt-Datei (Sie müssen Ihre Website zuerst dort registrieren).

Nachdem Sie die Anweisungen Ihrer Wahl in den bereitgestellten Editor eingegeben haben, können Sie Ihre Datei testen.

Wenn alles in Ordnung ist, sollten Sie die folgende Meldung am unteren Rand des Editors haben.

Wenn nicht, enthält Ihre Datei Logikfehler oder Syntaxwarnungen. Denken Sie schließlich daran, die Datei zu übermitteln, indem Sie auf die Schaltfläche „Senden“ klicken.

Wie kann man seine robots.txt-Datei auf WordPress optimieren?

Was sollten Sie in Ihre robots.txt -Datei einfügen oder nicht einfügen?

Gibt es eine vordefinierte Vorlage, die an jede Website angepasst werden kann?

Die Antwort: sowohl Ja als auch Nein.

Tatsächlich ist jede Seite anders und es wäre schwierig, das, was Peter, Paul oder James auf ihren Seiten vorschlagen, zu kopieren und einzufügen. Ihre Probleme werden sich höchstwahrscheinlich von denen unterscheiden, die Sie bei Ihnen haben.

Trotzdem können wir Ihnen eine einfache robots.txt -Datei geben, die für die meisten Websites geeignet ist:

Um die Wahrheit zu sagen, selbst innerhalb der WordPress-Community ist es unmöglich, alle dazu zu bringen, einer Meinung zu sein. Die Meinungen gehen auseinander.

Einige, wie Joost de Valk, der Gründer von Yoast, befürworten Minimalismus. Das ist eigentlich der aktuelle Trend .

Im Wesentlichen glauben sie, dass Google, da es Ihre Website vollständig interpretieren kann (einschließlich des CSS- und JavaScript-Codes und nicht mehr nur des HTML), den Zugriff auf CSS- und JavaScript-Dateien nicht blockieren sollte, damit es Ihre Seiten sehen kann in ihrer Gesamtheit. Andernfalls könnte dies Ihre SEO beeinträchtigen.

Um zu überprüfen, ob Google Zugriff auf alle Ressourcen hat, die es benötigt, um Ihre Seite richtig anzuzeigen, können Sie zur Google Search Console zurückkehren. Gehen Sie zur Registerkarte „URL-Prüfung“, klicken Sie auf „Getestete Seite anzeigen“ und dann auf „Screenshot“.

Wenn Ihre Website nicht so aussieht, wie sie sollte (z. B. einige Stile werden nicht angewendet), liegt das wahrscheinlich daran, dass einige der Regeln in Ihrer robots.txt -Datei überprüft werden müssen.

Aber zurück zu Yoast. Sehen Sie sich ihre robots.txt -Datei an:

Wie Sie sehen können, ist nichts blockiert!

Andere befürworten einen breiteren, „sicheren“ Ansatz für Ihre Website. Sie raten unter anderem zu:

- Verhindern Sie den Zugriff auf zwei wichtige WordPress-Verzeichnisse , wie den Ordner

wp-admin(in dem sich die Verwaltungselemente Ihrer Website befinden) und den Ordnerwp-includes(in dem sich alle WordPress-Dateien befinden). - Deindexiere die Anmeldeseite

(wp-login.php). - Oder um die Datei

readme.htmlzu de-indizieren , da sie die Version von WordPress enthält, die Sie verwenden.

Kurz gesagt, es ist nicht einfach, sich in all diesen Empfehlungen zurechtzufinden!

Zusammenfassend empfehle ich Ihnen:

- Halten Sie sich an das Nötigste, wenn Sie sich nicht sicher sind, was Sie tun . Andernfalls könnten die Folgen für Ihr SEO unglücklich sein.

- Prüfen Sie in der Search Console, ob Ihre Datei fehlerfrei ist, bevor Sie sie einreichen .

Wie kann man die robots.txt-Datei Ihrer #WordPress-Site optimieren? Antworten Sie in diesem Tutorial von WPMarmite.

Fazit

Wie Sie gesehen haben, ist die robots.txt -Datei ein interessantes Werkzeug für Ihre SEO. Damit können Sie den Suchmaschinen-Robotern mitteilen, was sie crawlen sollen und was nicht.

Aber es muss sorgsam damit umgegangen werden. Eine schlechte Konfiguration kann zu einer vollständigen De-Indexierung Ihrer Site führen (z. B. wenn Sie Disallow: / verwenden). Also sei vorsichtig!

Lassen Sie uns zum Abschluss dieses Beitrags eine Zusammenfassung erstellen. In diesen Zeilen habe ich detailliert beschrieben:

- Was die

robots.txt-Datei ist. - So installieren Sie es auf WordPress .

- So optimieren Sie Ihre

robots.txt-Datei in WordPress für SEO.

Jetzt sind Sie dran. Sagen Sie mir, ob Sie diesen Dateityp verwenden und wie Sie ihn einrichten.

Teilen Sie Ihre Gedanken und Ihr Feedback in den Kommentaren.