Robots.txt: WordPress 웹사이트에서 이 파일을 최적화하는 방법

게시 됨: 2022-01-21워드프레스에서 robots.txt 파일이 무엇인지 정의해달라고 하면 바로 대답해주실 수 있나요?

쉽지 않죠? 게다가, 알지 못하는 사이에 웹 사이트에 이미 하나가 있을 수 있습니다.

문제는 우리가 이 유명한 파일을 항상 이해하지 못한다는 것입니다. 그것은 무엇을 위해 사용됩니까? 무엇을 넣습니까? 코드가 이해하기 어려워 보이는 이유는 무엇입니까?

주제에 대해 조사한 적이 있다면 이러한 질문을 스스로에게 했을 것입니다.

다이너마이트처럼 이 파일은 매우 조심스럽게 다루어야 합니다 .

제대로 설정하지 않으면 사이트의 SEO가 손상될 위험이 있습니다. 그러니 폭발을 조심하세요!

이 게시물에서는 재난을 피하는 방법과 WordPress robots.txt 파일을 최적화하는 방법을 보여 드리겠습니다. 당신은 그것이 무엇을 위해 사용되는지, 어떻게 작동하는지, 그것을 만드는 두 가지 방법과 안에 무엇을 넣어야 하는지 알게 될 것입니다.

개요

- WordPress robots.txt 파일이란 무엇입니까?

- WordPress robots.txt 파일을 만드는 방법은 무엇입니까?

- robots.txt 파일이 제대로 작동하는지 확인하는 방법은 무엇입니까?

- WordPress에서 robots.txt 파일을 최적화하는 방법은 무엇입니까?

- 결론

WordPress robots.txt 파일이란 무엇입니까?

프레젠테이션

WordPress robots.txt 파일은 웹마스터 도움말 사이트에서 Google이 제공한 정의에 따라 "크롤러가 사이트에서 액세스할 수 있는 URL을 검색 엔진 크롤러에게 알려주는" 사이트 루트에 있는 텍스트 파일입니다.

"로봇 배제 표준/프로토콜"이라고도 하며, 검색 엔진이 특정 쓸모없고 사적인 콘텐츠(예: 로그인 페이지, 민감한 폴더 및 파일)의 색인을 생성하는 것을 방지할 수 있습니다.

간단히 말해서 이 프로토콜은 검색 엔진의 로봇에게 사이트에서 할 수 있는 것과 할 수 없는 것을 알려줍니다.

작동 방식은 다음과 같습니다. 로봇이 사이트의 URL을 크롤링하려고 할 때(즉, 색인을 생성할 수 있도록 정보를 탐색하고 검색할 때) 로봇은 먼저 robots.txt 파일을 찾습니다.

찾으면 읽은 다음 사용자가 지정한 지시를 따릅니다(금지된 경우 이러한 파일을 크롤링할 수 없음).

찾지 못하면 콘텐츠를 제외하지 않고 정상적인 방식으로 사이트를 크롤링합니다.

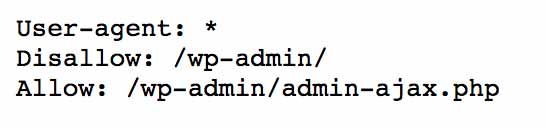

다음 WordPress robots.txt 파일의 예를 보고 어떻게 생겼는지 확인하세요.

반드시 그 내용에서 멈추지 마십시오. 나중에 보게 되겠지만 어떤 사이트에도 적용할 수 있는 표준 파일은 없습니다. 어떤 경우에도 권장되지 않습니다.

오늘의 주제에 대해 4가지를 더 기억해야 한다면 다음과 같이 생각하십시오.

- Google에서 설명하듯이

robots.txt파일에 제공한 정보 는 "크롤러가 사이트의 규칙을 따르도록 강제할 수는 없습니다" . "진지한" 크롤러(Google, Bing, Yahoo, Yandex, Baidu 등)가 이를 존중한다면 사이트의 보안을 약화시키려는 악성 로봇의 경우는 그렇지 않습니다.

또한 모든 로봇이 같은 방식으로 명령을 해석하는 것은 아니므로 Google에서 지정한 구문을 준수해야 합니다. -

robots.txt파일은 공개 파일 입니다.yoursite.com/robots.txt템플릿을 입력하면 누구나 액세스할 수 있습니다. 따라서 콘텐츠를 숨기는 데 사용하지 마십시오. 숨겨진 위치를 빠르게 찾을 수 있습니다. 일부 콘텐츠를 비공개로 유지하려면 이 파일에 넣지 말고 예를 들어 암호로 보호하십시오. - 특정 페이지가 검색 결과에 나타나지 않도록 하려면 "

robots.txt파일을 사용하여 웹 페이지를 숨기지 마십시오" 라고 Google은 말합니다. 실제로 여러 링크가 이 페이지를 가리키는 경우robots.txt파일에서 차단했더라도 포함된 내용을 모른 채 Google에서 색인을 생성하고 검색 결과에 표시할 수 있습니다.

페이지가 검색 결과에 표시되는 것을 방지하기 위해 Google은noindex태그를 사용할 것을 권장합니다 (각 게시물/ 설정 탭의 페이지). -

robots.txt파일에는 human.txt 라는 사촌이 있습니다 .

이것은 디자인에 기여한 다양한 사람들에 대한 정보가 포함된 TXT 파일로, 사이트 루트에도 있습니다.

예를 들어 개발자, 웹 디자이너, 편집자 등이 필수는 아니지만 WordPress 사이트에 통합하는 것이 유용하다고 생각되면 사이트 루트robots.txt파일(예: WPMarmite의 파일 참조).

robots.txt 파일이 정말 필요한가요?

기본적으로 웹사이트는 robots.txt 파일이 없어도 검색 엔진에 의해 정상적으로 크롤링되고 인덱싱됩니다.

따라서 후자는 필수가 아닙니다. WordPress SEO 전문가인 Daniel Roch는 "모든 페이지, 콘텐츠 및 미디어의 색인을 생성하려면 robots.txt 파일을 사용하지 마십시오. 아무 소용이 없습니다"라고 설명 합니다.

그러나 나머지 시간 동안 이 파일이 무슨 소용이 있겠습니까?

주요 이점은 SEO 측면에서 찾을 수 있다는 것입니다 . 실제로 robots.txt 파일을 사용하면 크롤링 예산을 절약할 수 있다고 Yoast SEO 블로그의 이 게시물이 말합니다.

그것은 꽤 기술적인 것이지만 간단히 말해서, SEO에 관심이 없는 페이지의 색인을 제거함으로써 Google이 다른 페이지를 크롤링할 수 있는 시간과 에너지를 더 많이 남길 수 있습니다.

이 주제에 대해 더 자세히 알고 싶다면 Backlinko의 Brian Dean이 여기에서 이야기합니다.

이제 파일 구성을 진행할 차례입니다. 그리고 이것은 중요합니다. 저를 믿으십시오. 제대로 최적화되지 않으면 검색 엔진에서 귀하의 존재가 심각하게 불이익을 받을 위험이 있습니다.

WordPress robots.txt 파일을 만드는 방법은 무엇입니까?

기본적으로 WordPress는 가상 robots.txt 파일을 생성합니다 . 서버에서는 액세스할 수 없지만 온라인에서 볼 수 있습니다.

전 자메이카 스프린트 스타인 Usain Bolt의 사이트에 있는 것을 보십시오.

그것을 보려면 브라우저에 http://usainbolt.com/robots.txt 를 입력하기만 하면 됩니다.

얻을 수 있는 것은 다음과 같습니다.

이 가상 파일이 작동합니다. 그러나 WordPress 웹 사이트에서 이 robots.txt 를 어떻게 수정합니까?

글쎄, 당신은 그것을 대체하기 위해 자신의 파일을 만들어야 할 것입니다.

두 가지 방법이 있습니다.

- 플러그인 사용

- 수동으로 생성

하는 방법을 자세히 알려 드리겠습니다.

Yoast SEO를 사용하여 WordPress에서 robots.txt 파일을 만드는 방법

나는 당신이 Yoast SEO를 알고 있다고 확신합니다. 맞습니까? 가장 많이 다운로드된 SEO 플러그인 중 하나입니다.

WPMarmite는 이를 사용하며 WordPress robots.txt 파일을 만드는 데 어떻게 도움이 되는지 보여드리겠습니다.

물론 전제 조건은 이 플러그인을 설치하고 활성화해야 한다는 것입니다.

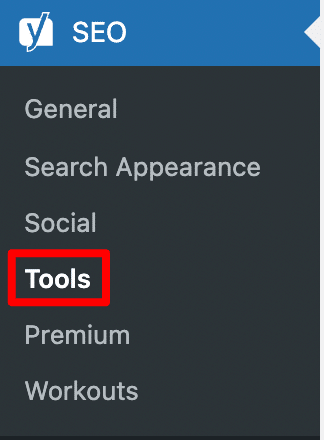

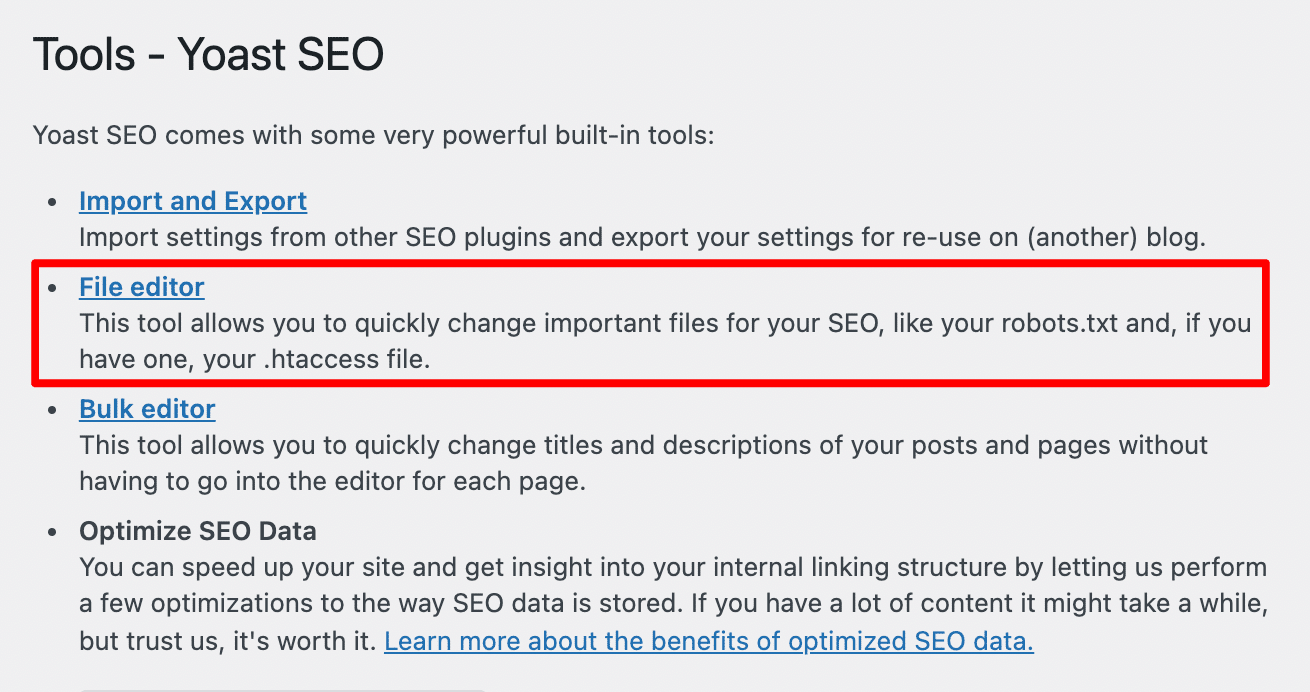

WordPress 대시보드로 이동하여 시작하고 Yoast SEO > 도구 를 선택합니다.

"파일 편집기"를 클릭하여 계속하십시오.

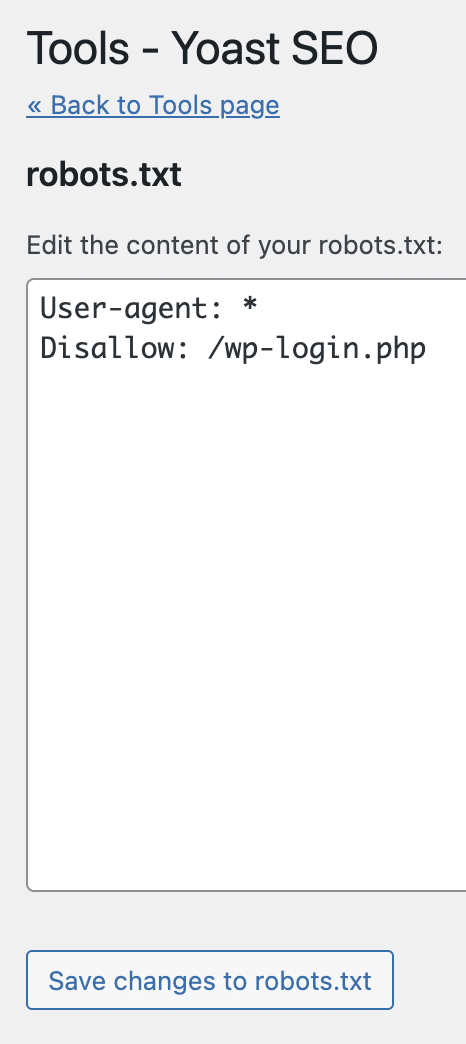

아직 전용 파일이 없다면 버튼을 클릭하여 생성하세요. 내 사이트에 이미 하나가 있어서 편집만 할 수 있었습니다. 그리고 완료되면 저장하는 것을 잊지 마십시오.

그리고 당신은 간다.

걱정하지 마십시오. 이 부분의 끝에서 이 파일에 어떤 정보를 넣어야 하는지 설명하겠습니다.

잠시 동안 두 번째 방법으로 넘어가겠습니다. 작은 손을 사용해야 합니다.

수동 방법

전용 플러그인을 사용하든 사용하지 않든 WordPress 웹사이트에 robots.txt 파일을 수동으로 추가하는 것도 가능합니다 . 매우 간단합니다.

먼저 텍스트 편집기가 필요합니다. 그 중에서 다음을 추천할 수 있습니다.

- 괄호

- 메모장++

- 숭고한 텍스트

그렇지 않으면 오래된 메모장도 매우 잘 작동합니다.

새 문서를 만들고 robots.txt 라는 이름으로 컴퓨터에 저장합니다.

이름은 항상 소문자여야 하며 robots라는 단어에 "s"를 넣는 것을 잊지 마십시오(

robot.txt는 쓰지 마세요).

다음으로 FTP 클라이언트에 연결합니다. 이것은 서버와 통신할 수 있게 해주는 소프트웨어입니다.

저는 개인적으로 Filezilla를 사용합니다. 그러나 Cyberduck을 사용할 수도 있습니다. FTP를 사용하는 방법에 대한 자세한 내용은 게시물을 확인하세요. FTP를 사용하여 WordPress 파일에 액세스하는 방법.

또한 FTP는 WordPress 설치 과정에서 유용합니다. 이에 대한 가이드를 읽어보세요: WordPress 설치 방법: 단계별 가이드.

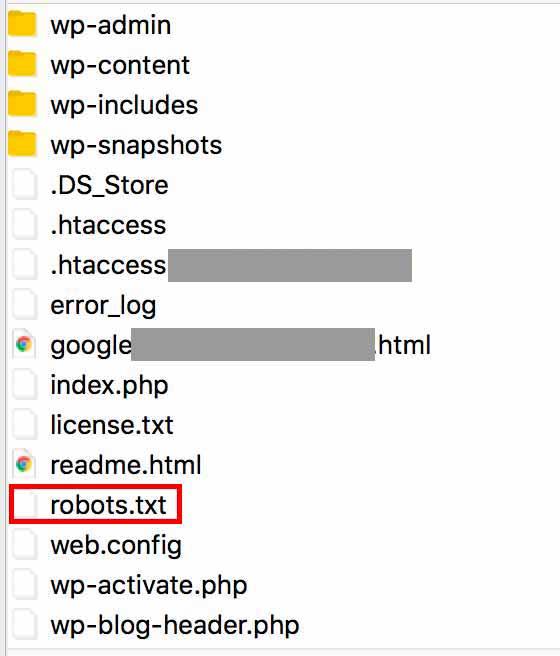

세 번째이자 마지막 단계: 사이트 루트에 파일을 추가합니다 . 반복합니다. 귀하의 사이트 루트가 아니라 하위 디렉토리에 있습니다. 그렇지 않으면 검색 엔진이 이를 고려하지 않습니다.

예를 들어 https://www.yoursite.com/ 을 통해 사이트에 액세스할 수 있는 경우 robots.txt 파일은 https://www.yoursite.com/robots.txt 에 있어야 합니다.

이 위치(루트)는 호스트마다 다를 수 있습니다. Bluehost(제휴 링크)에서는

public_html이라고 합니다. OVH에서www라는 이름으로 찾을 수 있습니다.

최종 구현은 사이트에서 다음과 같아야 합니다.

알아야 할 필수 규칙

축하합니다. 이제 robots.txt 파일이 서버에 있습니다. 현재는 비어 있지만 원할 때마다 수정할 수 있습니다.

논리적으로, 당신은 거기에 어떤 종류의 지시를 넣어야 하는지 스스로에게 물어볼 필요가 있습니다.

그 전에 이 파일의 특정 구문을 이해해야 합니다.

Google이 Search Console 도움말에서 설명하는 것처럼 "각 규칙은 해당 웹사이트의 지정된 파일 경로에 대한 특정 크롤러의 액세스를 차단하거나 허용합니다 ."

두 가지 주요 규칙은 다음과 같습니다.

-

User-agent: 규칙이 적용되는 검색 엔진 로봇의 이름을 나타냅니다. -

Disallow: 루트 도메인을 기준으로user-agent가 크롤링하지 않아야 하는 디렉토리 또는 페이지를 지정합니다. 기본적으로 로봇은Disallow규칙에 의해 차단되지 않은 페이지나 디렉터리를 탐색할 수 있습니다.

이해를 돕기 위해 간단한 예를 들어 보겠습니다.

첫 번째 줄에서 별표 * 는 와일드 카드라고 부르는 것입니다. 모든 검색 엔진 로봇( user-agent )을 나타냅니다.

두 번째 줄에서는 슬래시 / 를 사용하여 사이트의 모든 디렉토리와 페이지에 대한 이러한 검색 엔진의 액세스를 disallow .

robots.txt 파일은 상대 URL을 사용하기 때문에 슬래시 앞에 도메인 이름(예: mysite.com/ )을 입력할 필요가 없습니다. 간단히 말해서 슬래시가 도메인 이름의 루트를 참조한다는 것을 알고 있습니다.

분명히 위의 코드는 사이트를 크롤링하고 색인을 생성하려는 경우 거의 사용되지 않습니다. 그러나 사이트 생성 단계에 있을 때 유용할 수 있습니다.

예를 들어 Yahoo(Slurp는 Yahoo 로봇과 관련된 이름)와 같은 특정 유형의 로봇이 사이트를 크롤링하지 않도록 하려면 다음을 수행해야 합니다.

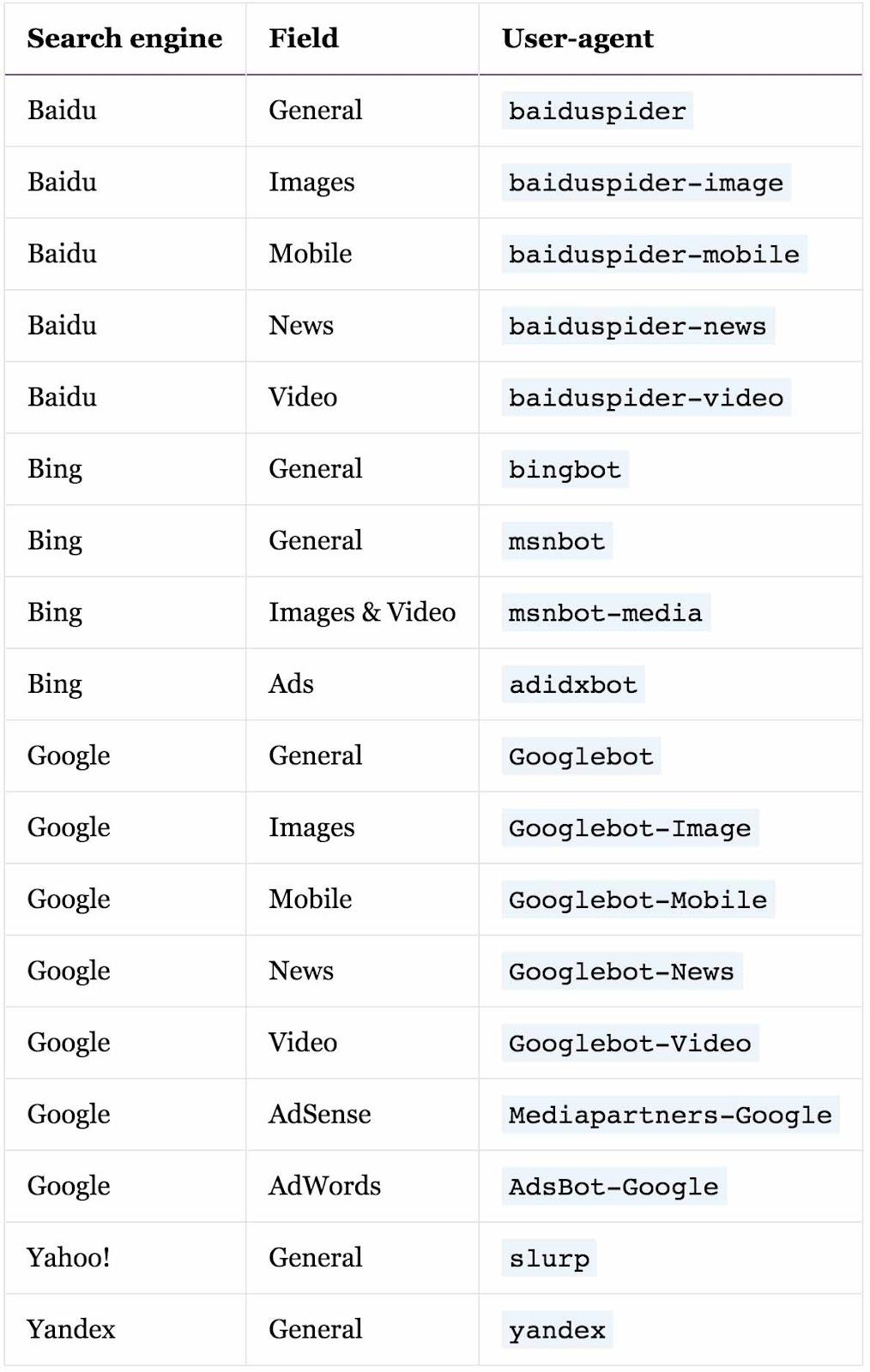

로봇 이름에 대한 자세한 내용은 Yoast SEO 사이트의 이 스크린샷을 참조하세요.

몇 가지 추가 규칙

가장 많이 사용되는 User-agent 와 Disallow 에 대해 말씀드렸습니다. 다른 구문 규칙이 있지만 모든 로봇에서 이를 고려하지 않는다는 것을 알아야 합니다(Google의 경우 예). 그 중에는 다음이 있습니다.

-

Allow: 허용되지 않은 디렉토리의 하위 디렉토리 또는 페이지 탐색을 허용합니다(Disallow). -

Sitemap: 사이트맵이 있는 위치를 로봇에게 알려줍니다. 이 줄은 선택 사항입니다. Google Search Console과 같은 전용 도구를 통해 사이트맵을 검색 엔진에 제출하는 것이 좋습니다. 이 게시물에서 수행하는 방법을 설명합니다.

이해를 돕기 위해 3가지 새로운 예를 제시하여 조금 더 진행하겠습니다.

디렉토리에 대한 액세스를 차단하는 방법

나는 모든 로봇이 wp-admin 디렉토리의 모든 내용을 탐색하지 않도록 요청합니다.

페이지 또는 파일에 대한 액세스를 차단하는 방법

이 예에서는 모든 로봇에게 WordPress 로그인 페이지와 사진을 색인화하지 않도록 요청합니다.

# 기호가 나타나는 것을 볼 수도 있습니다. 코멘트를 소개합니다. 뒤에 있는 텍스트는 고려되지 않습니다.

또한 규칙은 대소문자를 구분합니다.

예를 들어 Disallow: /myphoto.jpg 는 http://www.mysite.com/myphoto.jpg 와 일치하지만 http://www.mysite.com/Myphoto.jpg 는 일치하지 않습니다.

로봇마다 다른 규칙을 만드는 방법

규칙은 항상 위에서 아래로 처리됩니다. 항상 규칙이 적용되는 로봇을 나타내는 User-agent 문으로 시작한다는 것을 기억하십시오.

첫 번째 단계에서는 모든 로봇이 로그인 페이지( wp-login.php )를 인덱싱하지 않도록 요청합니다.

두 번째 경우에는 전체 사이트를 크롤링하지 말고 특히 Google의 크롤러(Googlebot)에 요청합니다.

차단된 디렉터리의 파일에 대한 액세스를 허용하는 방법

Allow 문을 사용합니다. 이 예에서는 widgets.php 파일을 제외한 모든 wp-admin 디렉토리가 차단됩니다.

robots.txt 파일이 제대로 작동하는지 확인하는 방법은 무엇입니까?

파일이 올바르게 설정되었는지 확인하려면 사이트의 SEO를 관리하기 위한 무료 필수 도구인 Google Search Console에서 파일을 확인하고 유효성을 검사할 수 있습니다.

robots.txt 파일 테스트 도구를 엽니다(먼저 웹사이트를 등록해야 함).

제공된 편집기에서 원하는 지침을 입력하면 파일을 테스트할 수 있습니다.

모든 것이 정상이면 편집기 하단에 다음 메시지가 표시되어야 합니다.

그렇지 않은 경우 파일에 논리 오류 또는 구문 경고가 포함됩니다. 마지막으로 "제출" 버튼을 클릭하여 파일을 제출하는 것을 잊지 마십시오.

WordPress에서 robots.txt 파일을 최적화하는 방법은 무엇입니까?

robots.txt 파일에 무엇을 넣거나 넣지 않아야 합니까?

각 사이트에 적용할 수 있는 미리 정의된 템플릿이 있습니까?

대답: 예와 아니오 둘 다입니다.

실제로 각 사이트는 다르며 Peter, Paul 또는 James가 제안한 내용을 복사하여 해당 사이트에 붙여넣기가 어려울 것입니다. 그들의 문제는 당신의 문제와 다를 가능성이 큽니다.

그럼에도 불구하고 대부분의 사이트에 적합한 기본 robots.txt 파일을 제공할 수 있습니다.

사실을 말하자면 WordPress 커뮤니티 내에서도 모든 사람이 동의하는 것은 불가능합니다. 의견이 다릅니다.

Yoast의 창립자인 Joost de Valk와 같은 사람들은 미니멀리즘을 옹호합니다. 이것은 실제로 현재 추세 입니다.

본질적으로 그들은 Google이 사이트 전체를 해석할 수 있기 때문에(더 이상 HTML뿐만 아니라 CSS 및 JavaScript 코드 포함) 페이지를 볼 수 있도록 CSS 및 JavaScript 파일에 대한 액세스를 차단해서는 안 된다고 생각합니다. 완전히. 그렇지 않으면 SEO에 영향을 줄 수 있습니다.

Google이 페이지를 올바르게 표시하는 데 필요한 모든 리소스에 액세스할 수 있는지 확인하려면 Google Search Console로 돌아갈 수 있습니다. "URL 검사" 탭으로 이동하여 "테스트된 페이지 보기"를 클릭한 다음 "스크린샷"을 클릭합니다.

사이트가 제대로 표시되지 않는 경우(예: 일부 스타일이 적용되지 않은 경우) robots.txt 파일의 일부 규칙을 검토해야 하기 때문일 수 있습니다.

그러나 Yoast로 돌아갑니다. 그들의 robots.txt 파일을 보십시오:

보시다시피 아무 것도 차단되지 않습니다!

다른 사람들은 귀하의 사이트에 대해 보다 광범위하고 "안전한" 접근 방식을 옹호합니다. 그들은 무엇보다도 다음과 같이 조언합니다.

-

wp-admin폴더(웹사이트의 관리 항목이 있는 위치) 및wp-includes폴더(모든 WordPress 파일이 있는)와 같은 두 개의 주요 WordPress 디렉토리에 대한 액세스를 방지합니다 . - 로그인 페이지

(wp-login.php)의 색인을 해제합니다. - 또는 사용 중인 WordPress 버전이 포함되어 있으므로

readme.html파일의 색인을 해제 합니다.

요컨대, 이러한 모든 권장 사항을 통해 길을 찾는 것은 쉽지 않습니다!

요약하자면 다음과 같이 조언합니다.

- 무엇을 하고 있는지 확신이 서지 않는다면 최소한의 작업만 하십시오 . 그렇지 않으면 SEO에 대한 결과가 불행해질 수 있습니다.

- 파일을 제출하기 전에 Search Console에서 파일에 오류가 없는지 확인하세요 .

#WordPress 사이트의 robots.txt 파일을 최적화하는 방법은 무엇입니까? WPMarmite의 이 튜토리얼에서 답변하세요.

결론

보시다시피 robots.txt 파일은 SEO를 위한 흥미로운 도구입니다. 이를 통해 검색 엔진 로봇에게 크롤링해야 하는 것과 크롤링하지 말아야 하는 것을 알릴 수 있습니다.

그러나 조심스럽게 다루어야 합니다. 잘못된 구성은 사이트의 색인을 완전히 제거할 수 있습니다(예 Disallow: / 를 사용하는 경우). 그러므로 조심 해주시길 바랍니다!

이 포스트를 마치기 위해 요약을 해보자. 이 라인 전반에 걸쳐 다음과 같이 자세히 설명했습니다.

-

robots.txt파일이 무엇 인지. - WordPress에 설치하는 방법 .

- SEO용 WordPress에서

robots.txt파일을 최적화하는 방법 .

이제 당신 차례입니다. 이 유형의 파일을 사용하는지 여부와 설정 방법을 알려주세요.

의견에서 생각과 피드백을 공유하십시오.