Robots.txt:WordPressWebサイトでこのファイルを最適化する方法

公開: 2022-01-21WordPressでrobots.txtファイルとは何かを定義するように求められた場合、正解を教えていただけますか?

簡単じゃないですか? その上、それを知らなくても、あなたはおそらくあなたのウェブサイトにすでにそれを持っています。

問題は、この有名なファイルを常に理解しているとは限らないということです。 それは何のために使われますか? 何を入れますか? なぜそのコードは理解しにくいように見えるのですか?

あなたが主題を調べたことがあるなら、私はあなたがあなた自身にこれらの質問をしたに違いない。

ダイナマイトに少し似ていますが、このファイルは細心の注意を払って処理する必要があります。

適切に設定しないと、サイトのSEOに損傷を与えるリスクがあります。 だから爆発に注意してください!

この投稿では、災害を回避する方法と、 robots.txtファイルを最適化する方法を紹介します。 それが何のために使われるか、それがどのように機能するか、それを作成する2つの方法、そして何を中に入れるかを発見するでしょう。

概要

- WordPressのrobots.txtファイルとは何ですか?

- WordPressのrobots.txtファイルを作成するにはどうすればよいですか?

- robots.txtファイルが正しく機能していることを確認するにはどうすればよいですか?

- WordPressでrobots.txtファイルを最適化する方法は?

- 結論

WordPressのrobots.txtファイルとは何ですか?

プレゼンテーション

WordPress robots.txtファイルは、サイトのルートにあるテキストファイルであり、ウェブマスターヘルプサイトでGoogleが提供した定義に従って、 「クローラーがサイトでアクセスできるURLを検索エンジンクローラーに通知します」。

「RobotsExclusionStandard / Protocol」とも呼ばれ、検索エンジンが特定の役に立たないコンテンツやプライベートコンテンツ(ログインページ、機密フォルダ、ファイルなど)のインデックス作成を回避できるようにします。

つまり、このプロトコルは、検索エンジンのロボットに、サイトで何ができるか、何ができないかを伝えます。

仕組みは次のとおりです。 ロボットがサイトのURLをクロールしようとしているとき(つまり、インデックスを作成できるように情報を探索して取得しようとしているとき)、ロボットは最初にrobots.txtファイルを調べます。

見つかった場合はそれを読み取り、指定した指示に従います(禁止している場合は、そのようなファイルをクロールすることはできません)。

見つからない場合は、コンテンツを除外せずに、通常の方法でサイトをクロールします。

WordPress robots.txtファイルのこの例を見て、どのように見えるかを確認してください。

必ずしもその内容にとどまらないでください。 後でわかるように、どのサイトにも適応できる標準ファイルはありません。 いずれにせよ、お勧めできません。

その日のトピックについてさらに4つのことを覚えておく必要がある場合は、これを頭に入れてください。

- Googleが説明しているように、

robots.txtファイルで提供する情報は、 「クローラーにサイトのルールに従うように強制することはできません」 。 「深刻な」クローラー(Google、Bing、Yahoo、Yandex、Baiduなど)がそれらを尊重する場合、サイトのセキュリティを弱体化させようとする悪意のあるロボットには当てはまりません。

さらに、すべてのロボットが同じように命令を解釈するわけではないので、Googleが示す構文を尊重するようにしてください。 -

robots.txtファイルは公開ファイルです。 次のテンプレートを入力すると、誰でもアクセスできます:yoursite.com/robots.txt。 したがって、コンテンツを非表示にするために使用しないでください。非表示になっている場所がすぐにわかります。一部のコンテンツを非公開にしておきたい場合は、このファイルに入れないでください。たとえば、パスワードで保護してください。 - 特定のページを検索結果に表示したくない場合は、「

robots.txtファイルを使用してWebページを非表示にしないでください」とGoogleは言います。 実際、多数のリンクがこのページを指している場合、robots.txtファイルでブロックしている場合でも、Googleがそのページの内容を知らなくても、インデックスを作成して検索結果に表示する可能性があります。

ページが検索結果に表示されないようにするには、noindexタグと呼ばれるものを使用することをお勧めします(各投稿の下にある[検索エンジンにこの投稿を検索結果に表示することを許可しますか?]チェックボックスをオフにすると、YoastSEOで簡単にアクティブ化できます。設定タブのページ)。 -

robots.txtファイルには、humans.txtといういとこが含まれています。

これはTXTファイルであり、これもサイトのルートにあり、その設計に貢献したさまざまな人々に関する情報が含まれています。

たとえば、開発者、Webデザイナー、編集者などです。必須ではありませんが、WordPressサイトに統合すると便利だと思われる場合は、サイトのルートのrobots.txtファイル(たとえば、WPMarmiteからのものを見てください)。

本当にrobots.txtファイルが必要ですか?

デフォルトでは、 robots.txtファイルがなくても、ウェブサイトは検索エンジンによって通常どおりクロールされ、インデックスに登録されます。

したがって、後者は必須ではありません。 WordPressSEOスペシャリストのDanielRochが説明するように、 「すべてのページ、コンテンツ、メディアにインデックスを付けたい場合は、 robots.txtファイルを使用しないでください。何の役にも立ちません」 。

しかし、それでは、残りの時間、このファイルはどのように使用できるのでしょうか。

主な利点は、SEOの側面にあることです。 実際、 robots.txtファイルを使用すると、クロールバジェットと呼ばれるものを保存できます、とYoastSEOブログからのこの投稿は述べています。

これはかなり技術的ですが、簡単に言えば、SEOに関心のないサイトのページのインデックスを解除することで、Googleが他のページをクロールするための時間とエネルギーをより多く残すことができます。

このテーマをさらに深く掘り下げたい場合は、BacklinkoのBrianDeanがここでそれについて話します。

次に、ファイルの構成に移ります。 そして、これは重要です、私を信じてください。 適切に最適化されていないと、検索エンジンでのプレゼンスに深刻なペナルティを科すリスクがあります。

WordPressのrobots.txtファイルを作成するにはどうすればよいですか?

デフォルトでは、WordPressは仮想robots.txtファイルを作成します。 サーバーからはアクセスできませんが、オンラインで表示できます。

元ジャマイカのスプリントスターであるウサインボルトのサイトにあるものを見てください。

これを表示するには、ブラウザにhttp://usainbolt.com/robots.txtと入力するだけです。

これがあなたが得るものです:

この仮想ファイルは機能します。 しかし、WordPress Webサイトでこのrobots.txtをどのように変更しますか?

さて、あなたはそれを置き換えるためにあなた自身のファイルを作成しなければならないでしょう。

これを行うには2つの方法があります。

- プラグインを使用する

- 手動で作成する

その方法を詳しく説明します。

YoastSEOを使用してWordPressでrobots.txtファイルを作成する方法

Yoast SEOを知っていると思いますよね? ご存知のとおり、これはSEOプラグインであり、これまでで最もダウンロードされたプラグインの1つです。

robots.txtはこれを使用します。また、WordPressrobots.txtファイルの作成にどのように役立つかを示すためにも使用します。

もちろん、前提条件は、このプラグインをインストールしてアクティブ化したことです。

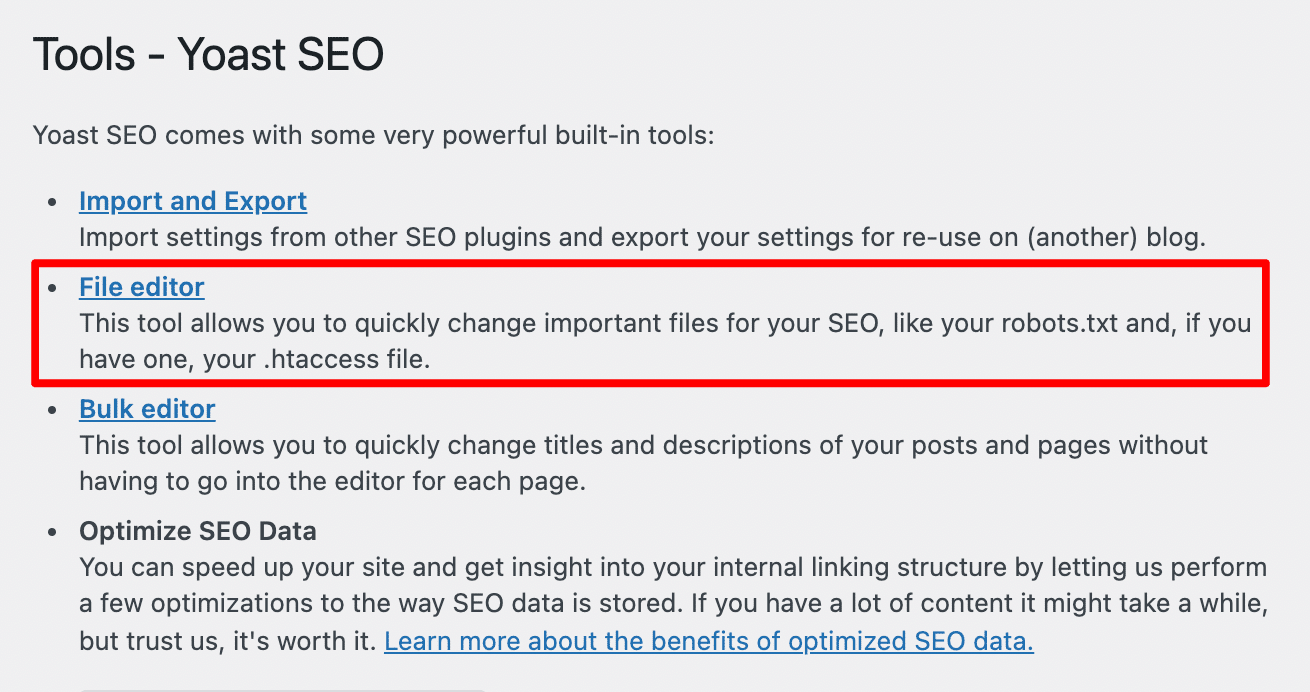

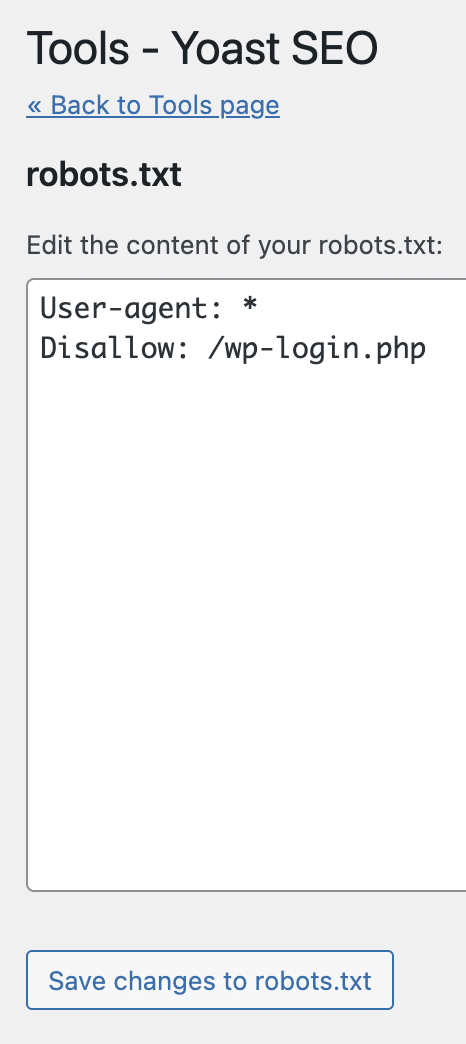

まず、WordPressダッシュボードに移動し、[ Yoast SEO]> [ツール]を選択します。

![YoastSEOプラグインの[ツール]タブからWordPressでrobots.txtファイルを作成することができます。](/uploads/article/1386/t8kOhrmBdfdFuGUE.png)

「ファイルエディタ」をクリックして続行します。

専用ファイルをまだお持ちでない場合は、ボタンをクリックして作成してください。 私はすでに自分のサイトに1つ持っていたので、編集することしかできませんでした。 完了したら、保存することを忘れないでください。

そして、あなたは行きます。

心配しないでください。このパートの最後で、このファイルにどのような情報を入れるかを説明します。

とりあえず、2番目の方法に移りましょう。小さな手を使わなければなりません。

手動による方法

専用のプラグインを使用するかどうかに関係なく、WordPressWebサイトにrobots.txtファイルを手動で追加することもできます。 とても簡単です。

まず、テキストエディタが必要になります。 それらの中で、私はお勧めすることができます:

- ブラケット

- メモ帳++

- 崇高なテキスト

そうでなければ、古き良きメモ帳も非常にうまくいくでしょう。

新しいドキュメントを作成し、 robots.txtという名前でコンピューターに保存します。

その名前は常に小文字である必要があり、robotsという単語に「s」を付けることを忘れないでください(

robot.txtと書かないでください)。

次に、FTPクライアントに接続します。 これは、サーバーとの通信を可能にするソフトウェアです。

個人的にはFilezillaを使っています。 ただし、Cyberduckを使用することもできます。 FTPの使用方法の詳細については、次の投稿を確認してください:FTPを使用してWordPressファイルにアクセスする方法。

また、FTPはWordPressのインストールプロセスで役立ちます。 それについてのガイドを読んでください:WordPressをインストールする方法:ステップバイステップガイド。

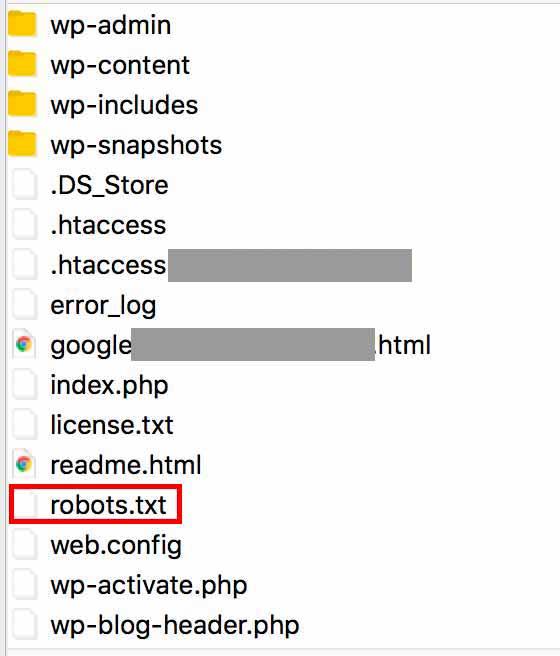

3番目の最後のステップ:ファイルをサイトのルートに追加します。 サブディレクトリではなく、サイトのルートで繰り返します。 そうでなければ、検索エンジンはそれを考慮に入れません。

たとえば、https://www.yoursite.com/からサイトにアクセスできる場合、 robots.txtファイルはhttps://www.yoursite.com/にありhttps://www.yoursite.com/robots.txt 。

この場所(ルート)は、ホストごとに異なる場合があります。 Bluehost(アフィリエイトリンク)では、

public_htmlと呼ばれます。 OVHでは、wwwという名前でそれを見つけることができます。

最終的な実装は、サイトでは次のようになります。

知っておくべき基本的なルール

おめでとうございますrobots.txtファイルがサーバー上にあります。 今のところ空ですが、いつでも編集できます。

論理的には、そこにどのような指示を入れるかを自問する必要があります。

その前に、このファイルの特定の構文を理解する必要があります。

Googleが検索コンソールのヘルプで説明しているように、「各ルールは、特定のクローラーがそのWebサイトの指定されたファイルパスにアクセスするのをブロックまたは許可します」 。

2つの主要なルールは次のように呼ばれます。

-

User-agent:ルールが適用される検索エンジンロボットの名前を指します。 -

Disallow:ルートドメインを基準にして、user-agentによってクロールされるべきではないディレクトリまたはページを指定します。 デフォルトでは、ロボットはDisallowルールによってブロックされていないページまたはディレクトリを探索できることに注意してください。

理解できるように簡単な例を見てみましょう。

最初の行のアスタリスク*は、ワイルドカードと呼ばれるものです。 これは、すべての検索エンジンロボット( user-agent )を指します。

2行目では、スラッシュ/を使用して、サイトのすべてのディレクトリとページへのこれらの検索エンジンへのアクセスをdisallowしています。

robots.txtファイルは相対URLを使用するため、スラッシュの前にドメイン名( mysite.com/ )を入力する必要はありません。 簡単に言えば、スラッシュはドメイン名のルートを指していることがわかります。

明らかに、サイトをクロールしてインデックスを作成する場合は、上記のコードはほとんど役に立ちません。 ただし、サイトの作成段階にある場合は便利です。

特定のタイプのロボット、たとえばYahoo(SlurpはYahooのロボットに関連付けられた名前)をクロールしたくない場合は、次のようにする必要があります。

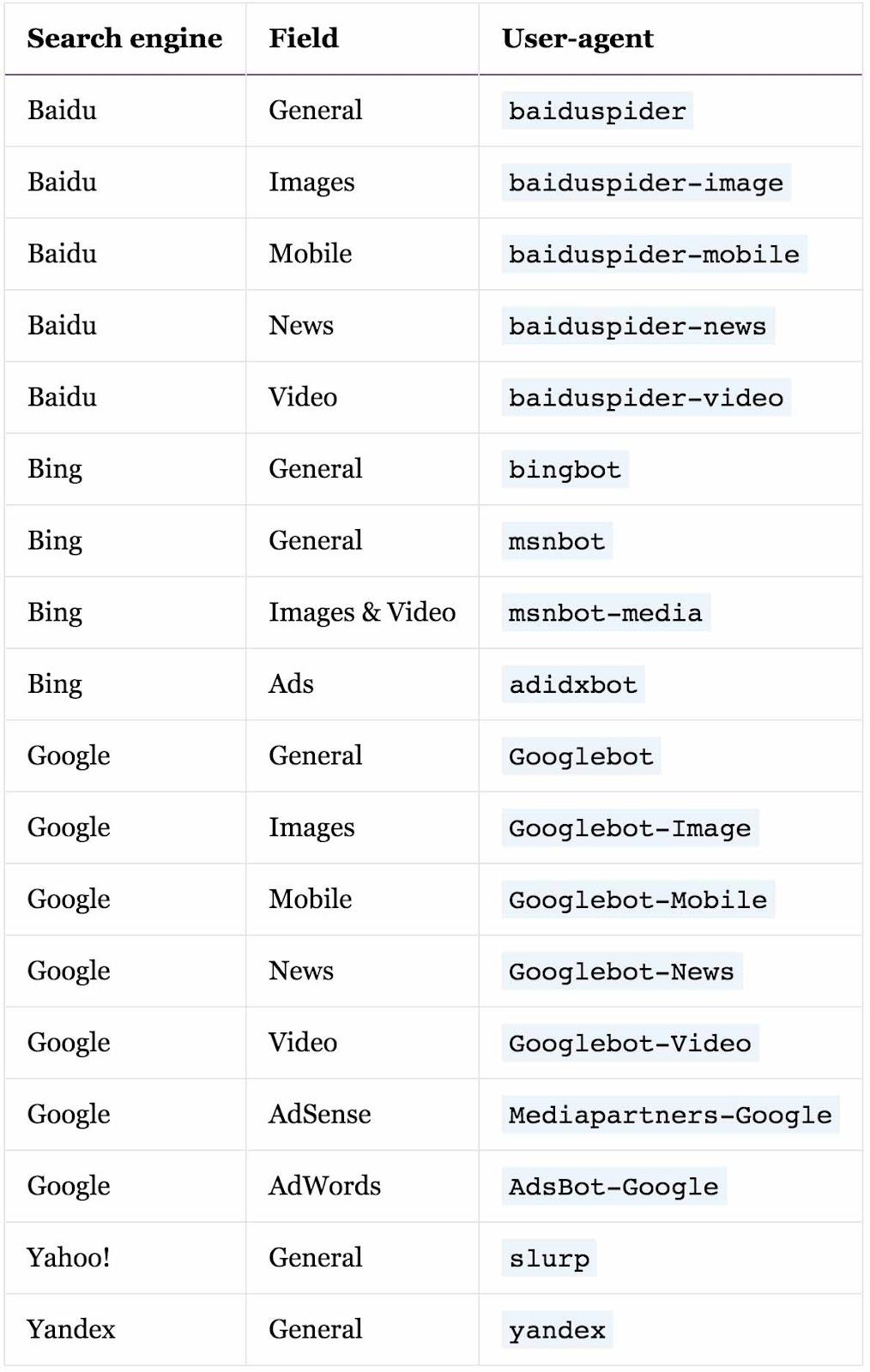

ロボット名の詳細については、YoastSEOサイトのこのスクリーンショットを参照してください。

いくつかの追加ルール

最もよく使われているUser-agentとDisallowについてお話しました。 他にも構文規則があることを知っておく必要がありますが、それらはすべてのロボットで考慮されているわけではありません(Googleの場合はそうです)。 それらの中には、次のものがあります。

-

Allow:許可されていないディレクトリ内のサブディレクトリまたはページの探索を許可します(Disallowしない)。 -

Sitemap:サイトマップが配置されている場所をロボットに通知します。 この行はオプションです。 Google検索コンソールなどの専用ツールを使用してサイトマップを検索エンジンに送信することをお勧めします。 この投稿でその方法を説明します。

確実に理解するために、3つの新しい例を挙げてもう少し進んでみましょう。

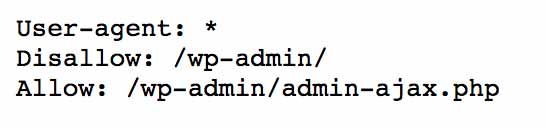

ディレクトリへのアクセスをブロックする方法

すべてのロボットに、 wp-adminディレクトリのすべての内容を調べないようにお願いします。

ページまたはファイルへのアクセスをブロックする方法

この例では、すべてのロボットに、WordPressのログインページと写真のインデックスを作成しないように依頼します。

#記号が表示されることも確認できます。 コメントを紹介します。 その背後にあるテキストは考慮されません。

また、ルールでは大文字と小文字が区別されることにも注意してください。

たとえば、 Disallow: /myphoto.jpgはhttp://www.mysite.com/myphoto.jpgと一致しますが、 http://www.mysite.com/Myphoto.jpg ://www.mysite.com/Myphoto.jpgとは一致しません。

ロボットごとに異なるルールを作成する方法

ルールは常に上から下に処理されます。 それらは常に、ルールが適用されるロボットを示すUser-agentステートメントで始まることを忘れないでください。

最初の例では、すべてのロボットにログインページ( wp-login.php )のインデックスを作成しないように依頼します。

2つ目は、サイト全体をクロールしないように、Googleのクローラー(Googlebot)に具体的に依頼します。

ブロックされたディレクトリ内のファイルへのアクセスを許可する方法

Allowステートメントを使用します。 この例では、 widgets.phpファイルを除くすべてのwp-adminディレクトリがブロックされています。

robots.txtファイルが正しく機能していることを確認するにはどうすればよいですか?

ファイルが正しく設定されていることを確認するために、Google検索コンソールでファイルを確認および検証できます。Google検索コンソールは、サイトのSEOを管理するための無料で不可欠なツールです。

robots.txtファイルテストツールを開きます(最初にそこにWebサイトを登録する必要があります)。

提供されたエディターで選択した指示を入力したら、ファイルをテストできます。

すべてが順調であれば、エディターの下部に次のメッセージが表示されます。

そうでない場合、ファイルには論理エラーまたは構文警告が含まれています。 最後に、「送信」ボタンをクリックして、ファイルを送信することを忘れないでください。

WordPressでrobots.txtファイルを最適化する方法は?

robots.txtファイルに何を入れるべきか、入れないべきですか?

各サイトに適応できる事前定義されたテンプレートはありますか?

答え:はいといいえの両方。

実際、各サイトは異なり、Peter、Paul、またはJamesが提案したものをコピーして自分のサイトに貼り付けることは困難です。 彼らの問題はおそらくあなたが抱えている問題とは異なるでしょう。

それでも、ほとんどのサイトに適した基本的なrobots.txtファイルを提供できます。

実を言うと、WordPressコミュニティ内であっても、全員に同意してもらうことは不可能です。 意見は異なります。

Yoastの創設者であるJoostde Valkのように、ミニマリズムを提唱する人もいます。 これは実際には現在の傾向です。

本質的に、Googleはサイト全体(CSSとJavaScriptコードを含み、HTMLだけでなく)を解釈できるため、ページを表示できるようにCSSファイルとJavaScriptファイルへのアクセスをブロックしてはならないと彼らは信じています。全体として。 そうしないと、SEOに影響を与える可能性があります。

Googleがページを正しく表示するために必要なすべてのリソースにアクセスできることを確認するには、Google検索コンソールに戻ります。 「URL検査」タブに移動し、「テスト済みページの表示」をクリックしてから、「スクリーンショット」をクリックします。

サイトが適切に表示されない場合(たとえば、一部のスタイルが適用されていない場合)、 robots.txtファイルの一部のルールを確認する必要があることが原因である可能性があります。

しかし、Yoastに戻ります。 彼らのrobots.txtファイルを見てください:

ご覧のとおり、何もブロックされていません。

他の人はあなたのサイトのためのより広く、「安全な」アプローチを提唱します。 彼らは、とりわけ次のようにアドバイスします。

-

wp-adminフォルダー(Webサイトの管理アイテムが配置されている場所)とwp-includesフォルダー(すべてのWordPressファイルを格納している場所)など、 2つの主要なWordPressディレクトリへのアクセスを防止します。 - ログインページのインデックスを解除します

(wp-login.php)。 - または、使用しているWordPressのバージョンが含まれているため、

readme.htmlファイルのインデックスを解除します。

要するに、これらすべての推奨事項を見つけるのは簡単ではありません!

要約すると、私はあなたに次のことをお勧めします:

- 何をしているのかわからない場合は、最小限にとどめてください。 そうしないと、SEOへの影響が不幸になる可能性があります。

- 送信する前に、検索コンソールでファイルにエラーがないことを確認してください。

#WordPressサイトのrobots.txtファイルを最適化する方法は? このチュートリアルでは、WPMarmiteから回答してください。

結論

ご覧のとおり、 robots.txtファイルはSEOにとって興味深いツールです。 これにより、検索エンジンロボットに、クロールすべきものとクロールすべきでないものを伝えることができます。

ただし、取り扱いには注意が必要です。 設定が不適切な場合、サイトのインデックスが完全に削除される可能性があります(たとえば、 Disallow: /を使用する場合)。 ので注意してください!

この投稿を終えるために、要約を作成しましょう。 これらの行を通して、私は詳細に説明しました:

-

robots.txtファイルとは何ですか。 - WordPressにインストールする方法。

- WordPress forSEOで

robots.txtファイルを最適化する方法。

今ではあなたの番です。 このタイプのファイルを使用するかどうか、およびその設定方法を教えてください。

コメントであなたの考えやフィードバックを共有してください。