Robots.txt: Jak zoptymalizować ten plik w witrynie WordPress

Opublikowany: 2022-01-21Jeśli poproszę o zdefiniowanie, co to jest plik robots.txt na WordPressie, czy jesteś w stanie udzielić mi prostej odpowiedzi?

Nie jest to łatwe, prawda? Poza tym, nie wiedząc o tym, prawdopodobnie masz już taki na swojej stronie.

Chodzi o to, że nie zawsze rozumiemy ten słynny plik. Do czego jest to używane? Co w to wkładasz? Dlaczego jego kod wygląda na trudny do zrozumienia?

Jeśli kiedykolwiek przyjrzałeś się temu tematowi, założę się, że zadałeś sobie te pytania.

Trochę jak dynamit, z tym plikiem należy obchodzić się bardzo ostrożnie .

Jeśli nie skonfigurujesz go prawidłowo, ryzykujesz uszkodzenie SEO swojej witryny. Więc uważaj na eksplozję!

W tym poście pokażę Ci, jak uniknąć katastrofy i jak zoptymalizować plik robots.txt WordPress. Dowiesz się, do czego służy, jak działa, dwa sposoby na jego stworzenie i co włożyć do środka.

Przegląd

- Co to jest plik robots.txt WordPress?

- Jak utworzyć plik robots.txt WordPress?

- Jak sprawdzić, czy plik robots.txt działa poprawnie?

- Jak zoptymalizować plik robots.txt na WordPressie?

- Wniosek

Co to jest plik robots.txt WordPress?

Prezentacja

Plik robots.txt WordPress to plik tekstowy znajdujący się w katalogu głównym Twojej witryny, który „informuje roboty wyszukiwarek, które adresy URL robot może uzyskać w Twojej witrynie” , zgodnie z definicją podaną przez Google w witrynie pomocy dla webmasterów.

Nazywany również „Standardem/protokołem wykluczenia robotów”, pozwala wyszukiwarkom uniknąć indeksowania niektórych bezużytecznych i/lub prywatnych treści (np. strony logowania, wrażliwych folderów i plików).

Krótko mówiąc, ten protokół mówi robotom wyszukiwarki, co mogą, a czego nie mogą zrobić w Twojej witrynie.

Oto jak to działa. Gdy robot ma zaindeksować adres URL Twojej witryny (tj. będzie badał i pobierał informacje, aby móc go zindeksować), najpierw spojrzy na plik robots.txt .

Jeśli go znajdzie, przeczyta go, a następnie zastosuje się do poleceń, które mu podałeś (nie będzie w stanie zaindeksować takiego a takiego pliku, jeśli tego zabronisz).

Jeśli go nie znajdzie, zindeksuje Twoją witrynę w normalny sposób, nie wykluczając żadnej treści.

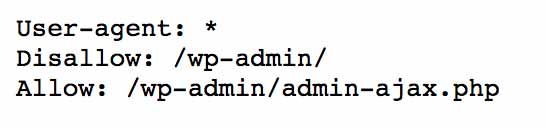

Spójrz na ten przykład pliku robots.txt WordPress, aby zobaczyć, jak wygląda:

Niekoniecznie poprzestawaj na jego zawartości. Jak zobaczysz później, nie ma standardowego pliku, który można dostosować do dowolnej witryny. W każdym razie nie jest to zalecane.

Jeśli musiałeś zapamiętać jeszcze 4 rzeczy na nasz temat dnia, weź to sobie do głowy:

- Jak wyjaśnia Google, informacje podane w pliku

robots.txt„nie mogą zmusić robota do przestrzegania reguł witryny” . Jeśli „poważne” roboty indeksujące (Google, Bing, Yahoo, Yandex, Baidu itp.) będą je szanować, nie będzie to miało miejsca w przypadku złośliwych robotów, które starają się podważyć bezpieczeństwo Twojej witryny.

Co więcej, nie wszystkie roboty interpretują instrukcje w ten sam sposób, dlatego pamiętaj o przestrzeganiu składni wskazanej przez Google. - Plik

robots.txtjest plikiem publicznym . Każdy może uzyskać do niego dostęp, wpisując następujący szablon:yoursite.com/robots.txt. Dlatego nie używaj go do ukrywania treści, szybko odkryjesz, gdzie jest ukryta… Jeśli chcesz, aby jakaś treść pozostała prywatna, nie umieszczaj jej w tym pliku, ale zabezpiecz ją np. hasłem. - Jeśli nie chcesz, aby niektóre strony pojawiały się w wynikach wyszukiwania, „nie używaj pliku

robots.txtdo ukrywania swojej strony internetowej” , mówi Google. Rzeczywiście, jeśli wiele linków wskazuje na tę stronę, możliwe jest, że Google indeksuje ją i wyświetla w swoich wynikach wyszukiwania, nie wiedząc, co zawiera, nawet jeśli zablokowałeś ją w swoim plikurobots.txt.

Aby zapobiec wyświetlaniu strony w wynikach wyszukiwania, Google zaleca użycie tak zwanego tagunoindex(można go łatwo aktywować w Yoast SEO, odznaczając pole „Zezwalaj wyszukiwarkom na pokazywanie tego posta w wynikach wyszukiwania?” znajdującego się pod każdym postem/ w zakładce ustawień). - Plik

robots.txtma swojego kuzyna o nazwie humans.txt .

Jest to plik TXT, również znajdujący się w katalogu głównym Twojej witryny, który zawiera informacje o różnych osobach, które przyczyniły się do jej powstania.

Na przykład programiści, projektanci stron internetowych, redaktorzy itp. Nie jest to obowiązkowe, ale jeśli uważasz, że warto zintegrować go z witryną WordPress, będziesz musiał dodać go do katalogu głównego witryny, obokrobots.txtplikrobots.txt(spójrz na przykład na ten z WPMarmite).

Czy naprawdę potrzebujesz pliku robots.txt ?

Domyślnie witryna będzie przeszukiwana i indeksowana normalnie przez wyszukiwarkę, nawet bez obecności pliku robots.txt .

To ostatnie nie jest zatem obowiązkowe. Jak wyjaśnia Daniel Roch, specjalista SEO WordPress, „jeśli chcesz zindeksować wszystkie swoje strony, treści i multimedia, nie używaj pliku robots.txt : nic ci to nie da” .

Ale w takim razie, jaki może być użytek z tego pliku przez resztę czasu?

Główną korzyścią jest to, aby znaleźć się po stronie SEO . W rzeczywistości plik robots.txt pozwala zaoszczędzić tak zwany budżet indeksowania, mówi ten post z bloga Yoast SEO.

Jest to dość techniczne, ale mówiąc po prostu, deindeksowanie stron w witrynie, które nie są interesujące dla SEO, pozostawisz więcej czasu i energii dla Google na indeksowanie innych.

Jeśli chcesz zagłębić się w temat, Brian Dean z Backlinko mówi o tym tutaj.

Teraz nadszedł czas, aby przejść do konfiguracji twojego pliku. A to jest ważne, uwierz mi. Jeśli nie jest odpowiednio zoptymalizowany, ryzykujesz poważne utrudnienie swojej obecności w wyszukiwarkach.

Jak utworzyć plik robots.txt WordPress?

Domyślnie WordPress tworzy wirtualny plik robots.txt . Nie jest dostępny na Twoim serwerze, ale możesz go wyświetlić online.

Weź ten na stronie Usaina Bolta, byłej gwiazdy sprintu z Jamajki.

Aby go zobaczyć, wystarczy wpisać w przeglądarce http://usainbolt.com/robots.txt .

Oto, co otrzymasz:

Ten wirtualny plik działa. Ale jak zmodyfikować ten robots.txt na swojej stronie WordPress?

Cóż, będziesz musiał utworzyć własny plik, aby go zastąpić.

Można to zrobić na dwa sposoby:

- Użyj wtyczki

- Utwórz to ręcznie

Pokażę ci szczegółowo, jak to zrobić.

Jak utworzyć plik robots.txt na WordPressie za pomocą Yoast SEO

Założę się, że znasz Yoast SEO, prawda? Wiesz, to wtyczka SEO, jedna z najczęściej pobieranych wszechczasów.

Używa go WPMarmite i zamierzam go również użyć, aby pokazać, w jaki sposób może pomóc w utworzeniu pliku robots.txt WordPress.

Oczywiście warunkiem wstępnym jest zainstalowanie i aktywacja tej wtyczki.

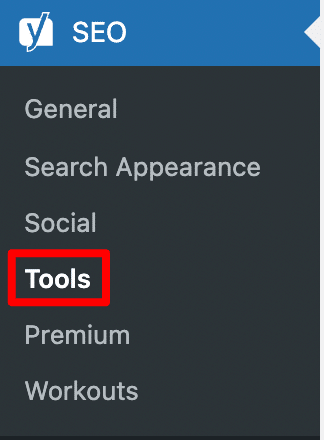

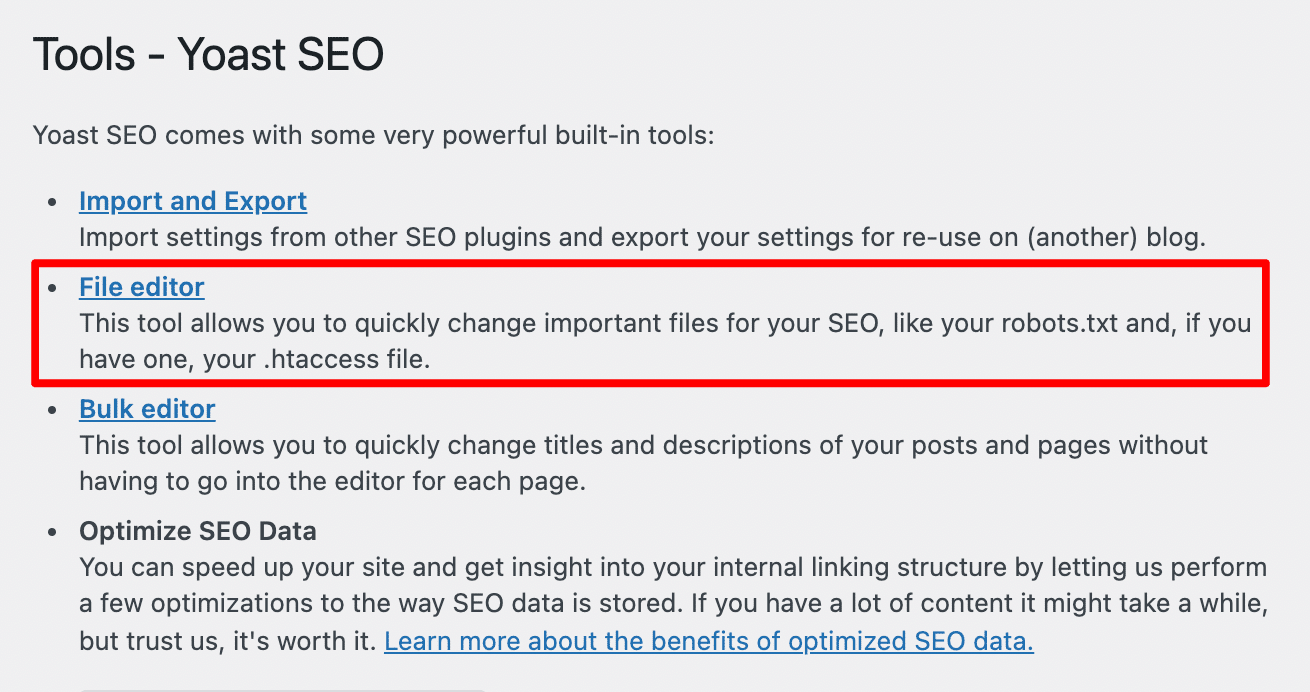

Zacznij od przejścia do pulpitu WordPress i wybierz Yoast SEO > Narzędzia .

Kontynuuj, klikając „Edytor plików”.

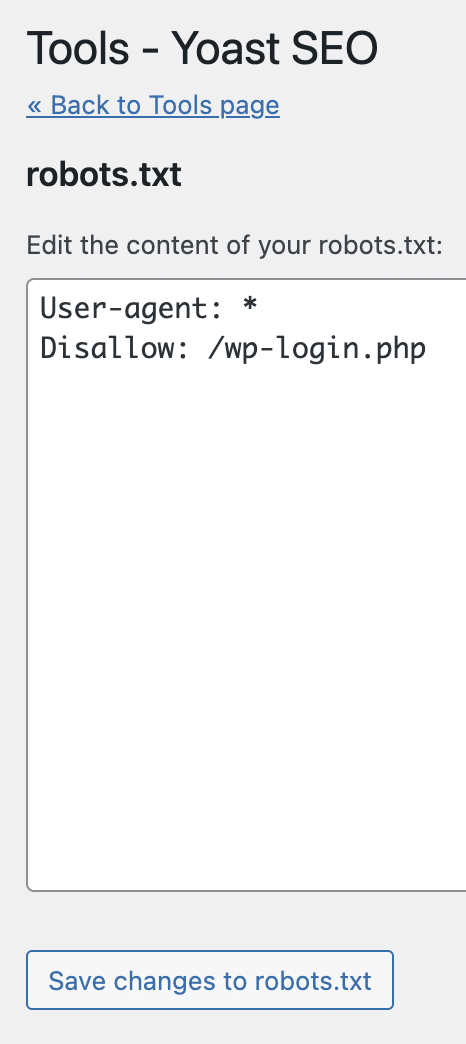

Jeśli nie masz jeszcze dedykowanego pliku, kliknij przycisk, aby go utworzyć. Miałem już taki na swojej stronie, więc mogłem go tylko edytować. I nie zapomnij zapisać, gdy skończysz.

I proszę bardzo.

Nie martw się, wyjaśnię na końcu tej części, jakie informacje umieścić w tym pliku.

Na razie przejdźmy do drugiej metody: będziesz musiał użyć swoich małych rączek.

Metoda ręczna

Niezależnie od tego, czy korzystasz z dedykowanej wtyczki, czy nie, istnieje również możliwość ręcznego dodania pliku robots.txt do witryny WordPress. Zobaczysz, to bardzo proste.

Najpierw potrzebujesz edytora tekstu. Wśród nich mogę polecić:

- Wsporniki

- Notatnik++

- Wzniosły tekst

W przeciwnym razie twój stary dobry Notatnik również będzie działał bardzo dobrze.

Utwórz nowy dokument i zapisz go na swoim komputerze pod nazwą robots.txt .

Jego nazwa musi być zawsze pisana małymi literami i nie zapomnij wstawić „s” w słowie robots (nie pisz

robot.txt).

Następnie połącz się z klientem FTP. Jest to oprogramowanie, które umożliwia komunikację z serwerem.

Osobiście używam Filezilli. Ale możesz też użyć Cyberkaczki. Aby uzyskać więcej informacji na temat korzystania z FTP, zapoznaj się z naszym postem: Jak korzystać z FTP w celu uzyskania dostępu do plików WordPress.

FTP przyda się również w procesie instalacji WordPressa. Przeczytaj nasz przewodnik na ten temat: Jak zainstalować WordPress: przewodnik krok po kroku.

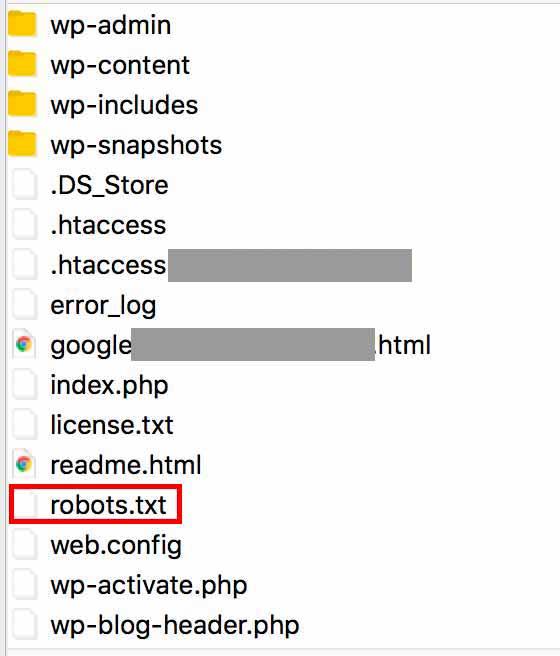

Trzeci i ostatni krok: dodaj plik do katalogu głównego witryny . Powtarzam, w katalogu głównym Twojej witryny, a nie w podkatalogu. W przeciwnym razie wyszukiwarki nie wezmą tego pod uwagę.

Jeśli na przykład Twoja witryna jest dostępna pod https://www.yoursite.com/ , plik robots.txt powinien znajdować się pod https://www.yoursite.com/robots.txt .

Ta lokalizacja (korzeń) może się różnić w zależności od hosta. W Bluehost (link afiliacyjny) nazywa się to

public_html. W OVH znajdziesz go pod nazwąwww.

Jego ostateczna implementacja powinna wyglądać tak na Twojej stronie:

Podstawowe zasady, które należy znać

Gratulacje, plik robots.txt znajduje się teraz na serwerze. Na razie jest pusty, ale możesz go edytować, kiedy tylko chcesz.

Logicznie musisz zadać sobie pytanie, jakie instrukcje tam umieścić.

Zanim do tego dojdziemy, konieczne jest zrozumienie składni tego pliku.

„Każda reguła blokuje lub umożliwia dostęp danemu robotowi do określonej ścieżki pliku w tej witrynie” , jak wyjaśnia Google w pomocy Search Console.

Dwie główne zasady to:

-

User-agent: odnosi się do nazwy robota wyszukiwarki, którego dotyczy reguła. -

Disallow: wyznacza katalog lub stronę w odniesieniu do domeny głównej, które nie powinny być indeksowane przez klientauser-agent. Pamiętaj, że domyślnie robot może eksplorować stronę lub katalog niezablokowany przez regułęDisallow.

Przestudiujmy prosty przykład, abyś zrozumiał.

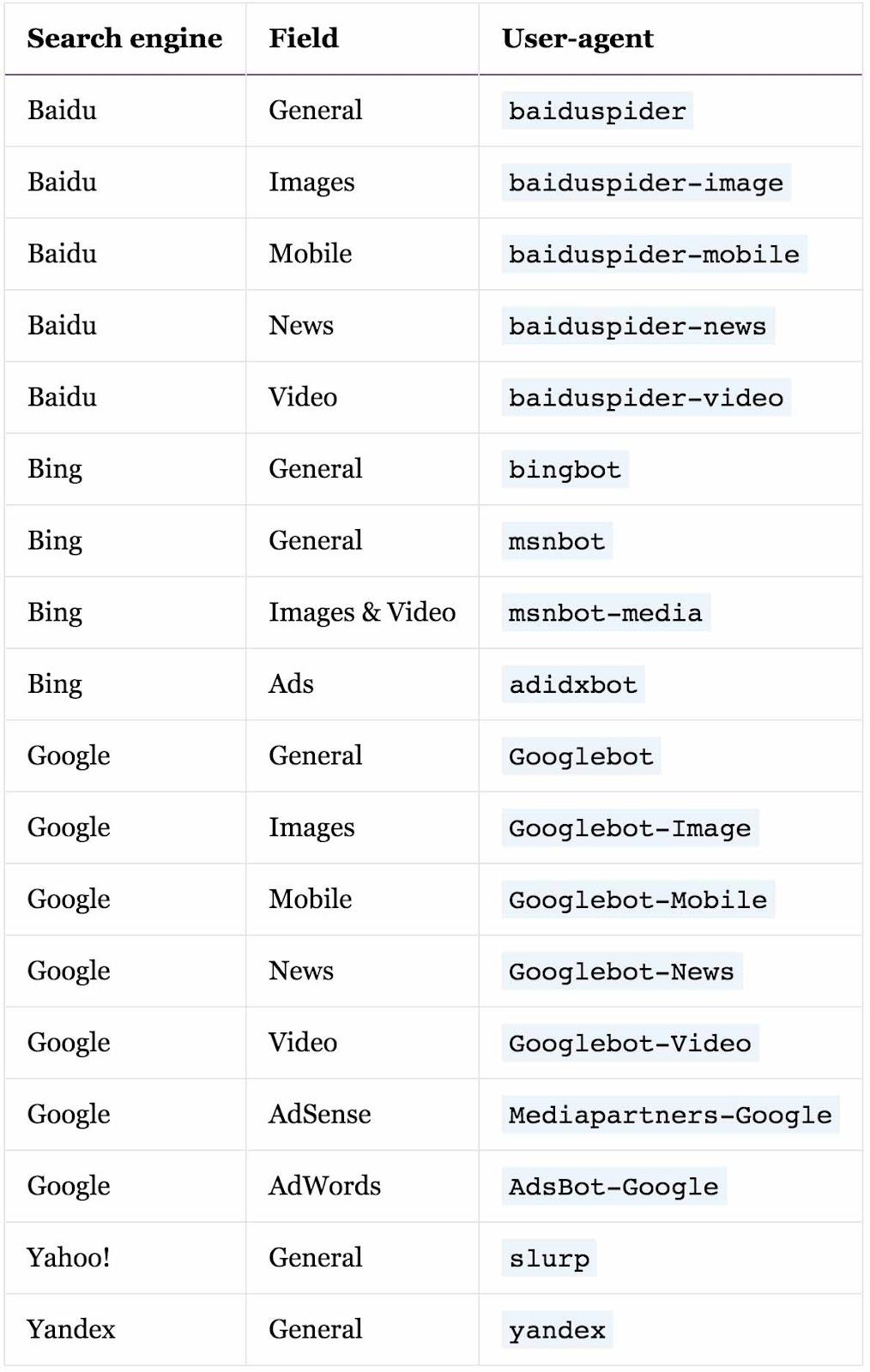

W pierwszym wierszu gwiazdka * to coś, co nazywamy symbolem wieloznacznym. Odnosi się do wszystkich robotów wyszukiwarek ( user-agent ).

W drugim wierszu disallow dostęp do tych wyszukiwarek do wszystkich katalogów i stron Twojej witryny, używając ukośnika / .

Nie musisz wpisywać nazwy domeny (np mysite.com/ ) przed ukośnikiem, ponieważ plik robots.txt używa względnych adresów URL. Mówiąc najprościej, wie, że ukośnik odnosi się do katalogu głównego nazwy domeny.

Oczywiście powyższy kod jest mało przydatny, jeśli chcesz, aby Twoja witryna była pobierana i indeksowana. Ale może to być przydatne, gdy jesteś w fazie tworzenia witryny.

Jeśli nie chcesz, aby dany typ robota indeksował Twoją witrynę, na przykład Yahoo (Slurp to nazwa powiązana z robotem Yahoo), musisz to zrobić:

Aby uzyskać więcej informacji na temat nazw robotów, odsyłam do tego zrzutu ekranu ze strony Yoast SEO.

Kilka dodatkowych zasad

Mówiłem o User-agent i Disallow , które są najczęściej używane. Powinieneś wiedzieć, że istnieją inne reguły składni, ale nie są one brane pod uwagę przez wszystkie roboty (w Google, tak). Wśród nich są:

-

Allow: umożliwia eksplorację podkatalogu lub strony w niedozwolonym katalogu (Disallow). -

Sitemap: informuje roboty, gdzie znajduje się mapa witryny. Ta linia jest opcjonalna. Polecam przesłać mapę witryny do wyszukiwarek za pomocą dedykowanego narzędzia, takiego jak Google Search Console. W tym poście wyjaśniam, jak to zrobić.

Aby upewnić się, że rozumiesz, przejdźmy trochę dalej, podając 3 nowe przykłady.

Jak zablokować dostęp do katalogu?

Proszę wszystkie roboty, aby nie eksplorowały całej zawartości katalogu wp-admin .

Jak zablokować dostęp do strony lub pliku

W tym przykładzie proszę wszystkie roboty, aby nie indeksowały strony logowania do WordPressa, a także zdjęcia.

Możesz również zobaczyć pojawienie się symbolu # . Wprowadza komentarz. Tekst za nim nie będzie brany pod uwagę.

Pamiętaj też, że w regułach jest rozróżniana wielkość liter.

Na przykład Disallow: /myphoto.jpg odpowiada wartości http://www.mysite.com/myphoto.jpg , ale nie http://www.mysite.com/Myphoto.jpg .

Jak tworzyć różne zasady dla różnych robotów

Reguły są zawsze przetwarzane od góry do dołu. Pamiętaj, że zawsze zaczynają się od instrukcji User-agent , która wskazuje robota, którego dotyczy reguła.

W pierwszym proszę wszystkie roboty, aby nie indeksowały strony logowania ( wp-login.php ).

W drugim specjalnie proszę robota Google (Googlebota), aby nie indeksował całej mojej witryny.

Jak zezwolić na dostęp do pliku w zablokowanym katalogu?

Używamy oświadczenia Allow . W tym przykładzie cały katalog wp-admin jest zablokowany, z wyjątkiem pliku widgets.php .

Jak sprawdzić, czy plik robots.txt działa poprawnie?

Aby mieć pewność, że Twój plik jest poprawnie skonfigurowany, możesz sprawdzić i zweryfikować go w Google Search Console, bezpłatnym i niezbędnym narzędziu do zarządzania SEO Twojej witryny (między innymi).

Otwórz narzędzie do testowania pliku robots.txt (musisz najpierw zarejestrować tam swoją witrynę).

Po wprowadzeniu wybranych instrukcji w dostarczonym edytorze możesz przetestować swój plik.

Jeśli wszystko jest w porządku, na dole edytora powinien pojawić się następujący komunikat.

Jeśli nie, plik zawiera błędy logiczne lub ostrzeżenia dotyczące składni. Na koniec pamiętaj o przesłaniu pliku, klikając przycisk „Prześlij”.

Jak zoptymalizować plik robots.txt na WordPressie?

Co należy umieścić w pliku robots.txt , a czego nie?

Czy istnieje predefiniowany szablon, który można dostosować do każdej witryny?

Odpowiedź: zarówno tak, jak i nie.

Rzeczywiście, każda strona jest inna i trudno byłoby skopiować i wkleić to, co proponują na swoich stronach Peter, Paul czy James. Ich problemy najprawdopodobniej będą inne niż te, które masz na swoim.

Niemniej jednak możemy udostępnić podstawowy plik robots.txt , który będzie pasował do większości witryn:

Prawdę mówiąc, nawet w społeczności WordPressa nie da się przekonać wszystkich do zgody. Opinie są różne.

Niektórzy, jak Joost de Valk, założyciel Yoast, opowiadają się za minimalizmem. To jest aktualnie aktualny trend .

Zasadniczo uważają, że ponieważ Google jest w stanie zinterpretować Twoją witrynę w całości (w tym kod CSS i JavaScript, a nie tylko HTML), nie powinien blokować dostępu do plików CSS i JavaScript, aby mógł zobaczyć Twoje strony w całości. W przeciwnym razie może to wpłynąć na SEO.

Aby sprawdzić, czy Google ma dostęp do wszystkich zasobów potrzebnych do prawidłowego wyświetlania Twojej strony, możesz wrócić do Google Search Console. Przejdź do zakładki „Kontrola adresów URL”, kliknij „Wyświetl przetestowaną stronę”, a następnie kliknij „Zrzut ekranu”.

Jeśli Twoja witryna nie wygląda tak, jak powinna (np. niektóre style nie są stosowane), jest to prawdopodobnie spowodowane koniecznością sprawdzenia niektórych reguł w pliku robots.txt .

Ale wracając do Yoast. Spójrz na ich plik robots.txt :

Jak widać, nic nie jest zablokowane!

Inni opowiadają się za szerszym, „bezpiecznym” podejściem do Twojej witryny. Doradzają m.in.:

- Blokuj dostęp do dwóch kluczowych katalogów WordPress , takich jak folder

wp-admin(w którym znajdują się elementy administracyjne Twojej witryny) i folderwp-includes(w którym znajdują się wszystkie pliki WordPress). - Odindeksuj stronę logowania

(wp-login.php). - Lub odindeksować plik

readme.html, ponieważ zawiera on wersję WordPressa, której używasz.

Krótko mówiąc, nie jest łatwo znaleźć drogę do wszystkich tych zaleceń!

Podsumowując, radzę:

- Trzymaj się absolutnego minimum, jeśli nie jesteś pewien, co robisz . W przeciwnym razie konsekwencje dla SEO mogą być niefortunne.

- Przed przesłaniem sprawdź, czy plik nie zawiera błędów w Search Console .

Jak zoptymalizować plik robots.txt swojej witryny #WordPress? Odpowiedz w tym samouczku od WPMarmite.

Wniosek

Jak już zauważyłeś, plik robots.txt jest interesującym narzędziem dla Twojego SEO. Pozwala powiedzieć robotom wyszukiwarek, co powinny, a czego nie powinny się indeksować.

Ale należy się z tym obchodzić ostrożnie. Zła konfiguracja może doprowadzić do całkowitej deindeksacji Twojej witryny (np. jeśli używasz Disallow: / ). Więc uważaj!

Aby zakończyć ten post, zróbmy podsumowanie. W tych wierszach szczegółowo opisałem:

- Co to jest plik

robots.txt. - Jak zainstalować go na WordPressie .

- Jak zoptymalizować plik

robots.txtna WordPress pod kątem SEO.

Teraz twoja kolej. Powiedz mi, czy używasz tego typu pliku i jak go skonfigurowałeś.

Podziel się swoimi przemyśleniami i opiniami w komentarzach.