Jak AI Audio do MIDI zmienia okablowanie współczesnej produkcji muzycznej

Opublikowany: 2026-02-10Dlaczego AI Audio do MIDI ma teraz znaczenie

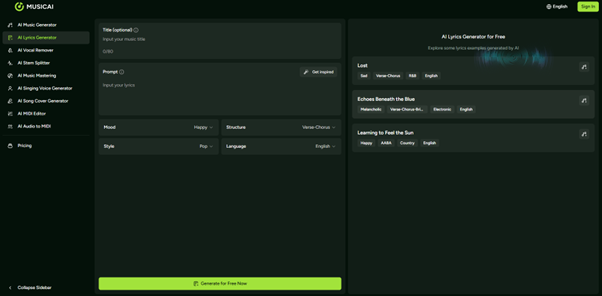

Sztuczna inteligencja i produkcja muzyczna zderzają się ze sobą w bardzo praktyczny sposób: przekształcanie niechlujnego dźwięku w czysty MIDI jest w końcu przydatne dla codziennych producentów. Zamiast ręcznie transkrybować melodie lub akordy, konwerter dźwięku AI na MIDI umożliwia nucenie, nagrywanie riffów lub wrzucanie pętli i uzyskiwanie w zamian edytowalnych nut MIDI. Platformy takie jak MusicAI idą dalej, łącząc dźwięk w formacie MIDI w szerszym pakiecie do tworzenia muzyki opartym na sztucznej inteligencji, dzięki czemu przechwytywanie pomysłów i aranżacja są na żywo w jednym miejscu.

W epoce, w której muzycy przeskakują między programami DAW, krótkimi filmami i grami, ma to znaczenie. MIDI jest nadal najbardziej elastycznym „językiem” oprogramowania muzycznego, a dźwięk AI do MIDI staje się pomostem między spontanicznymi nagraniami a uporządkowanymi aranżacjami cyfrowymi. Dla twórców, którzy chcą szybkości bez utraty kontroli, ten most jest miejscem, w którym dzieje się większość innowacji

Co właściwie robi dźwięk do MIDI

W swej istocie konwersja dźwięku na MIDI przekłada ciągły dźwięk – wokal, gitary, linie syntezatora – na dyskretne dane nutowe zrozumiałe dla wirtualnych instrumentów. Zamiast przechowywać przebiegi, plik MIDI przechowuje wysokość, taktowanie, prędkość, a czasami informacje o akordach, które można później dowolnie edytować. Oznacza to, że śpiewana linia może stać się sekcją smyczkową, a riff gitarowy może zamienić się w syntezatorowy bas bez konieczności ponownego odtwarzania.

Nowoczesne konwertery oparte na sztucznej inteligencji, w tym funkcja audio na MIDI w MusicAI, analizują wysokość, rytm, a nawet akordy, aby wygenerować czystą reprezentację źródła MIDI. W przewodnikach branżowych zauważono, że narzędzia oparte na uczeniu maszynowym charakteryzują się znacznie większą dokładnością w porównaniu z wczesnymi, czysto algorytmicznymi konwerterami, szczególnie w przypadku materiału monofonicznego. Chociaż żadne narzędzie nie jest idealne w przypadku gęstych miksów, przepaść między pomysłem a edytowalnym MIDI zmniejsza się z roku na rok

Tam, gdzie tradycyjne przepływy pracy są niewystarczające

Przed wprowadzeniem AI Audio do MIDI producenci mieli trzy możliwości: ręczną transkrypcję, powolne przepływy pracy polegające na „krojeniu do MIDI” lub po prostu rezygnację i ponowne nagranie. Ręczne wklejanie nut w rolkę fortepianu jest precyzyjne, ale niezwykle czasochłonne, szczególnie w przypadku szybkich improwizacji lub złożonych rytmów. Funkcje „Przekrój do nowej ścieżki MIDI” w programach DAW są potężne, ale najlepiej sprawdzają się w przypadku perkusji, a nie w przypadku linii melodycznych lub akordów o przedłużonej ekspresji.

Raporty dotyczące procesów produkcji muzycznej pokazują, że producenci nadal spędzają nieproporcjonalnie dużo czasu na powtarzalnym montażu, zamiast na projektowaniu i aranżowaniu dźwięku. To jest dokładnie czas, który ma na celu skrócenie czasu przesyłania dźwięku AI do MIDI. Dyskusje społeczne również to odzwierciedlają: użytkownicy wielokrotnie wspominają, że dobre narzędzie audio do MIDI „oszczędza godziny transkrypcji” i sprawia, że ponowne komponowanie z sampli jest znacznie bardziej praktyczne.

Wewnątrz silnika audio do MIDI MusicAI

Dedykowane narzędzie MusicAI Audio To MIDI skupia się na trzech filarach: szerokiej obsłudze formatów audio, szczegółowej analizie muzycznej i czystym eksporcie. Możesz przesyłać popularne formaty, takie jak WAV, MP3, FLAC lub OGG, dzięki czemu pasuje zarówno do nagrań studyjnych, jak i szybkich nagrań telefonicznych. Po przesłaniu sztuczna inteligencja systemu analizuje wysokość, rytm i strukturę akordów, a następnie generuje edytowalny plik MIDI, który zawiera podstawową zawartość muzyczną.

Zgodnie z dokumentacją MusicAI silnik jest dostrojony pod kątem dokładności melodycznej i wykrywania akordów, a nie tylko prostych zdarzeń włączania/wyłączania nut. Dzięki temu nadaje się do transkrypcji melodii, ponownego harmonizowania pomysłów lub wydobywania wzorców z własnych nagrań bez zatracania się w porządkowaniu. Chociaż bardzo zaszumione lub gęste miksy nadal stanowią wyzwanie, narzędzie to jest pozycjonowane jako jedna z bardziej niezawodnych internetowych opcji przesyłania dźwięku do MIDI dla twórców, którym zależy zarówno na szybkości, jak i użytecznych danych muzycznych.

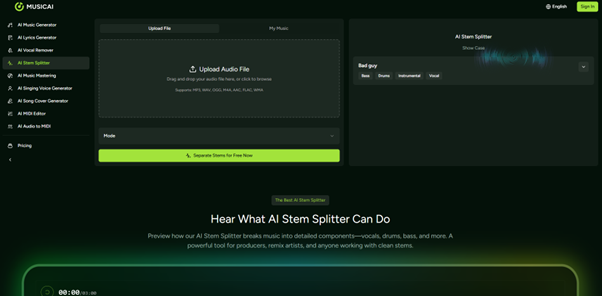

Test praktyczny: używanie MusicAI do przesyłania dźwięku do MIDI

Aby zobaczyć, jak to pasuje do rzeczywistego przepływu pracy, przeprowadzono krótką sesję testową z funkcją audio do MIDI MusicAI na trzech typach materiału źródłowego: nucona melodia, prosta pętla fortepianu i bardziej zajęta progresja gitary. Proces był prosty — przeciągnij i upuść plik audio, poczekaj na zakończenie analizy AI, a następnie pobierz wynikowy plik MIDI do wykorzystania w DAW.

W przypadku nuconej melodii o pojedynczej linijce dokładność transkrypcji była wysoka: rozpoznawanie wysokości dźwięku było w większości prawidłowe, z jedynie kilkoma korektami taktowania w rolce fortepianowej DAW. Aby uzyskać czystą pętlę fortepianu, narzędzie uchwyciło zarówno rytm, jak i podstawowe akordy na tyle dobrze, że można było ponownie zaaranżować partię za pomocą różnych instrumentów wirtualnych. Najtrudniejszym przypadkiem była złożona progresja gitarowa; chociaż główny ruch harmoniczny był użyteczny, niektóre nuty wewnętrzne zostały uproszczone lub błędnie wykryte, co odzwierciedla znane ograniczenie polegające na tym, że gęsty dźwięk polifoniczny pozostaje najtrudniejszym scenariuszem dla każdego konwertera.

Krok po kroku: Konwersja dźwięku na MIDI za pomocą MusicAI

Korzystanie z przepływu pracy audio do MIDI w MusicAI przypomina prostą aplikację internetową niż konfigurowanie wtyczki lub makra DAW. Typowa sekwencja wygląda następująco:

- Otwórz dedykowaną stronę Audio To MIDI w przeglądarce i zaloguj się.

- Przeciągnij plik WAV, MP3, FLAC lub OGG do obszaru przesyłania.

- Pozwól silnikowi AI analizować wysokość, rytm i zawartość harmoniczną.

- Pobierz powstały plik MIDI i zaimportuj go do swojego DAW w celu edycji i wyboru dźwięku

Ten trzyetapowy proces — przesyłanie, analizowanie, pobieranie — dopasowuje wzorce widoczne w nowoczesnych narzędziach audio AI, ale siłą MusicAI jest to, że dźwięk do MIDI łączy się z przetwarzaniem tekstu na muzykę, tekstem na utwór i innymi funkcjami tworzenia w jednym obszarze roboczym. Ułatwia to przejście od przekonwertowanego szkicu MIDI do pełnej aranżacji lub połączenie go ze ścieżkami podkładowymi wygenerowanymi przez sztuczną inteligencję bez konieczności żonglowania wieloma usługami.

Gdzie MusicAI Audio do MIDI błyszczy (a gdzie nie)

Z mocnego punktu widzenia funkcja audio do MIDI MusicAI zapewnia szybkość, dostępność i zintegrowany kontekst z resztą platformy. Działa na przeglądarce, nie wymaga instalacji i obsługuje wiele formatów audio, co jest idealne dla twórców przełączających się między nagraniami mobilnymi a sesjami studyjnymi. W przypadku linii monofonicznych i stosunkowo czystych ścieżek wygenerowany komunikat MIDI jest wystarczająco dokładny, aby sterować wysokiej jakości instrumentami wirtualnymi przy jedynie niewielkich edycjach.

Z drugiej strony MusicAI boryka się z tymi samymi ograniczeniami, co inne narzędzia AI do przesyłania dźwięku do MIDI: złożony, zaszumiony lub mocno przetworzony dźwięk może nadal powodować artefakty lub brakujące nuty. I chociaż sztuczna inteligencja radykalnie skraca czas transkrypcji, nie zastępuje oceny muzycznej — nadal musisz udoskonalić synchronizację, brzmienie i dynamikę, aby dopasować je do produkcji. Dla użytkowników oczekujących „doskonałego wyniku jednym kliknięciem” każde obecne narzędzie, nie tylko MusicAI, będzie niewystarczające, co potwierdzają niezależne przewodniki i porównania oprogramowania do konwersji.

Kto najbardziej czerpie korzyści z AI Audio do MIDI

Dźwięk do MIDI jest szczególnie cenny dla producentów i autorów piosenek, którzy zaczynają pomysły poza DAW – na telefonach, pianinach lub gitarach – i chcą szybko przejść do zorganizowanych sesji. Implementacja MusicAI jest odpowiednia dla twórców, którzy już korzystają ze sztucznej inteligencji do przekształcania tekstu na muzykę lub generowania tekstów, a teraz chcą wprowadzić własne nagrania do tego samego ekosystemu. Jest również odpowiedni dla nauczycieli i uczniów: konwersja nagrań ćwiczeniowych do formatu MIDI zapewnia przejrzysty sposób analizy taktowania i dokładności wysokości tonu.

Analizy rynku oprogramowania MIDI wskazują na rosnącą bazę użytkowników, składającą się z muzyków pracujących w domowych studiach i hobbystów, a globalne przychody z oprogramowania MIDI szacuje się na około setki milionów dolarów i przewiduje się, że będą rosły wraz z rozwojem dostępnych narzędzi. Funkcje wspomagane sztuczną inteligencją, takie jak audio do MIDI, stanowią naturalny kolejny krok w tym trendzie, dzięki czemu profesjonalne przepływy pracy są dostępne dla twórców, którzy nie mają tradycyjnej teorii ani doświadczenia w notowaniu.

Dlaczego AI Audio do MIDI ma znaczenie dla branży

Na szerszym poziomie, dźwięk do MIDI znajduje się na skrzyżowaniu sztucznej inteligencji, skalowalności treści i tworzenia z zachowaniem bezpieczeństwa praw. Raporty na temat wdrażania muzyki opartej na sztucznej inteligencji podkreślają, że twórcy potrzebują narzędzi, które przyspieszają tworzenie pomysłów bez blokowania ich w czarnych skrzynkach wyjściowych, których nie mogą edytować. MIDI jest z natury edytowalne, więc wykorzystanie sztucznej inteligencji do tworzenia MIDI, a nie tylko gotowego dźwięku, jest zgodne z pragnieniem kontroli i przejrzystości.

W miarę jak coraz więcej platform konkuruje w przestrzeni muzycznej AI, funkcje takie jak przesyłanie dźwięku przez MusicAI do MIDI stają się wyróżnikami, a nie dodatkami. Pomagają twórcom przetwarzać własne nagrania w nowe aranżacje, dostosowywać treści generowane przez sztuczną inteligencję i zachować spójną tożsamość dźwiękową w różnych projektach – a wszystko to na rynku, który według analityków będzie stale rosnąć w ciągu następnej dekady. W tym kontekście przesyłanie dźwięku AI do MIDI jest nie tyle nowością, co podstawową możliwością nowej generacji hybrydowych przepływów pracy muzycznej opartych na sztucznej inteligencji.