Cómo AI Audio to MIDI está reconfigurando la producción musical moderna

Publicado: 2026-02-10Por qué el audio AI a MIDI es importante ahora

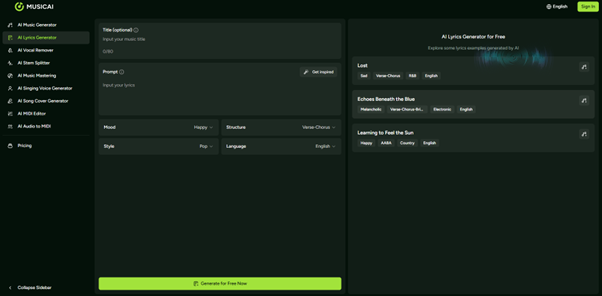

La IA y la producción musical están colisionando de una manera muy práctica: convertir audio desordenado en MIDI limpio finalmente es utilizable para los productores cotidianos. En lugar de transcribir manualmente melodías o acordes, un conversor de audio AI a MIDI le permite tararear, grabar un riff o realizar un bucle y, a cambio, obtener notas MIDI editables. Plataformas como MusicAI llevan esto aún más lejos al empaquetar audio a MIDI dentro de un conjunto de creación musical de IA más amplio, de modo que la captura y los arreglos de ideas estén vivos en un solo lugar.

En una era en la que los músicos saltan entre DAW, vídeos de formato corto y juegos, esto es importante. MIDI sigue siendo el “lenguaje” más flexible del software musical, y el audio AI a MIDI se está convirtiendo en el puente entre las grabaciones espontáneas y los arreglos digitales estructurados. Para los creadores que desean velocidad sin sacrificar el control, este puente es donde se produce la mayor parte de la innovación.

Qué hace realmente el audio a MIDI

En esencia, la conversión de audio a MIDI traduce el sonido continuo (voces, guitarras, líneas de sintetizador) en datos de notas discretas que los instrumentos virtuales entienden. En lugar de almacenar formas de onda, un archivo MIDI almacena información de tono, sincronización, velocidad y, a veces, acordes, que puedes editar libremente más adelante. Esto significa que una línea cantada puede convertirse en una sección de cuerdas, o un riff de guitarra puede convertirse en un bajo sintetizado, sin necesidad de reproducirlo.

Los conversores modernos impulsados por IA, incluida la función de audio a MIDI en MusicAI, analizan el tono, el ritmo e incluso los acordes para generar una representación MIDI limpia de la fuente. Las guías de la industria señalan que las herramientas basadas en aprendizaje automático tienen una precisión significativamente mayor en comparación con los primeros convertidores puramente algorítmicos, especialmente para material monofónico. Si bien ninguna herramienta es perfecta en mezclas densas, la brecha entre la idea y el MIDI editable sigue reduciéndose año tras año.

Donde los flujos de trabajo tradicionales se quedan cortos

Antes de AI Audio to MIDI, los productores tenían tres opciones: transcripción manual, flujos de trabajo lentos de "corte a MIDI" o simplemente darse por vencidos y volver a grabar. Hacer clic manualmente en las notas en un rollo de piano es preciso pero consume mucho tiempo, especialmente para improvisaciones rápidas o ritmos complejos. Las funciones "Slice to new MIDI track" de los DAW son potentes, pero funcionan mejor para la batería, no para líneas melódicas o acordes con expresión sostenida.

Los informes sobre los flujos de trabajo de producción musical muestran que los productores todavía dedican una cantidad desproporcionada de tiempo a la edición repetitiva en lugar del diseño o arreglo de sonido. Ese es exactamente el tiempo que la IA pretende reducir entre el audio y el MIDI. Las discusiones de la comunidad también reflejan esto: los usuarios mencionan repetidamente que una buena herramienta de audio a MIDI "ahorra horas de transcripción" y hace que la recomposición a partir de muestras sea mucho más práctica.

Dentro del motor de audio a MIDI de MusicAI

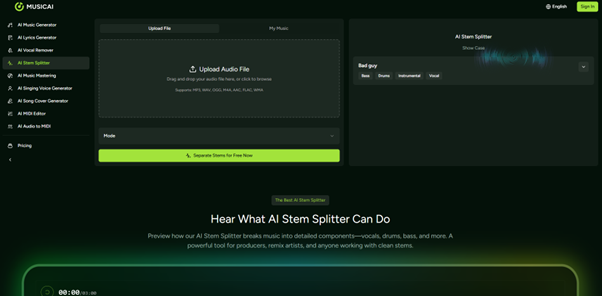

La herramienta dedicada Audio a MIDI de MusicAI se centra en tres pilares: amplia compatibilidad con formatos de audio, análisis musical detallado y exportación limpia. Puede cargar formatos comunes como WAV, MP3, FLAC u OGG, por lo que se adapta tanto a temas de estudio como a grabaciones rápidas de teléfono. Una vez cargado, la IA del sistema analiza el tono, el ritmo y las estructuras de acordes, luego genera un archivo MIDI editable que captura el contenido musical principal.

Según la propia documentación de MusicAI, el motor está ajustado para lograr precisión melódica y detección de acordes, en lugar de simplemente eventos de activación/desactivación de notas aproximadas. Eso lo hace adecuado para transcribir melodías, rearmonizar ideas o extraer patrones de sus propias grabaciones sin perderse en la limpieza. Si bien las mezclas muy ruidosas o densas siguen siendo un desafío, la herramienta se posiciona como una de las opciones de audio a MIDI basadas en web más confiables para los creadores que desean velocidad y datos musicales utilizables.

Prueba práctica: uso de MusicAI para audio a MIDI

Para ver cómo encaja esto en un flujo de trabajo real, se realizó una breve sesión de prueba con la función de audio a MIDI de MusicAI en tres tipos de material fuente: una melodía tarareada, un bucle de piano simple y una progresión de guitarra más ocupada. El proceso fue sencillo: arrastre y suelte el archivo de audio, espere a que finalice el análisis de IA y luego descargue el MIDI resultante para usarlo en una DAW.

En una melodía tarareada de una sola línea, la precisión de la transcripción fue alta: el reconocimiento del tono fue en su mayor parte correcto, con solo unos pocos ajustes de sincronización necesarios en el piano roll de la DAW. Para un bucle de piano limpio, la herramienta capturó tanto el ritmo como los acordes básicos lo suficientemente bien como para reorquestar la parte con diferentes instrumentos virtuales. La compleja progresión de la guitarra fue el caso más difícil; Si bien el movimiento armónico principal era utilizable, algunas notas internas se simplificaron o se detectaron erróneamente, haciéndose eco de la conocida limitación de que el audio polifónico denso sigue siendo el escenario más difícil para cualquier convertidor.

Paso a paso: conversión de audio a MIDI con MusicAI

Usar el flujo de trabajo de audio a MIDI de MusicAI se parece más a una aplicación web simple que a configurar un complemento o una macro DAW. La secuencia típica se ve así:

- Abra la página dedicada Audio a MIDI en su navegador e inicie sesión.

- Arrastre un archivo WAV, MP3, FLAC u OGG al área de carga.

- Deje que el motor de IA analice el tono, el ritmo y el contenido armónico.

- Descargue el archivo MIDI resultante e impórtelo a su DAW para editarlo y seleccionar el sonido.

Este flujo de tres pasos (cargar, analizar, descargar) coincide con los patrones observados en las herramientas de audio de IA modernas, pero el punto fuerte de MusicAI es que el audio a MIDI se combina con el texto a música, la letra a la canción y otras funciones de creación en un solo espacio de trabajo. Esto hace que sea más fácil pasar de un boceto MIDI convertido a un arreglo completo o combinarlo con pistas de acompañamiento generadas por IA sin tener que hacer malabarismos con múltiples servicios.

Dónde brilla MusicAI Audio to MIDI (y dónde no)

Desde una perspectiva de fortalezas, la función de audio a MIDI de MusicAI ofrece velocidad, accesibilidad y contexto integrado con el resto de la plataforma. Está basado en navegador, no requiere instalación y admite múltiples formatos de audio, lo que es ideal para creadores que alternan entre grabaciones móviles y sesiones de estudio. Para líneas monofónicas y pistas relativamente limpias, el MIDI generado es lo suficientemente preciso como para manejar instrumentos virtuales de alta calidad con sólo ediciones menores.

En el lado negativo, MusicAI enfrenta las mismas limitaciones que otras herramientas de audio AI a MIDI: el audio complejo, ruidoso o muy procesado aún puede producir artefactos o notas faltantes. Y si bien la IA reduce drásticamente el tiempo de transcripción, no reemplaza el juicio musical; aún es necesario perfeccionar el tiempo, la voz y la dinámica para adaptarlos a la producción. Para los usuarios que esperan una “partitura perfecta con un solo clic”, cualquier herramienta actual, no solo MusicAI, se quedará corta, un punto del que se hacen eco guías independientes y comparaciones de software de conversión.

¿Quién se beneficia más del audio AI a MIDI?

El audio a MIDI es particularmente valioso para productores y compositores que inician ideas fuera de su DAW (en teléfonos, pianos o guitarras) y desean una ruta rápida hacia sesiones estructuradas. La implementación de MusicAI se adapta a los creadores que ya utilizan la IA para la generación de texto a música o letras y ahora quieren incorporar sus propias grabaciones al mismo ecosistema. También es ideal para educadores y estudiantes: convertir grabaciones de práctica a MIDI ofrece una forma clara de analizar la precisión del tiempo y el tono.

Los análisis de mercado del software MIDI sugieren una creciente base de usuarios de músicos de estudio en casa y aficionados, con ingresos globales por software MIDI estimados en alrededor de cientos de millones de dólares y que se prevé que crezcan con el aumento de herramientas accesibles. Las funciones asistidas por IA, como el audio a MIDI, son el siguiente paso natural en esta tendencia, ya que hacen que los flujos de trabajo de estilo profesional estén al alcance de creadores que no tienen una formación tradicional en teoría o notación.

Por qué el audio AI a MIDI es importante para la industria

En un nivel más amplio, el audio a MIDI se encuentra en la intersección de la IA, la escalabilidad del contenido y la creación segura de derechos. Los informes sobre la adopción de la música mediante IA destacan que los creadores quieren herramientas que aceleren la ideación sin encerrarlos en resultados de caja negra que no puedan editar. MIDI es inherentemente editable, por lo que usar IA para producir MIDI en lugar de solo audio terminado se alinea con ese deseo de control y transparencia.

A medida que más plataformas compiten en el espacio musical de IA, características como el audio a MIDI de MusicAI se convierten en diferenciadores en lugar de complementos. Ayudan a los creadores a reciclar sus propias grabaciones en nuevos arreglos, personalizar el contenido generado por IA y mantener una identidad sonora consistente en todos los proyectos, todo mientras navegan en un mercado que los analistas esperan que crezca de manera constante durante la próxima década. En ese contexto, el audio de IA a MIDI es menos una novedad que una capacidad fundamental para la próxima generación de flujos de trabajo musicales híbridos entre humanos y IA.