Co to jest hałas AI Peephole?

Opublikowany: 2026-02-21Systemy sztucznej inteligencji są często oceniane pod kątem dokładności, wydajności i skalowalności, ale znacznie mniej uwagi poświęca się subtelnym zniekształceniom powstającym podczas przetwarzania danych. Jednym z takich zjawisk, które zwróciło uwagę społeczności badaczy i programistów, jest Peephole AI Noise . Choć nie zawsze jest to formalnie zdefiniowane w literaturze akademickiej, termin ten opisuje specyficzny rodzaj zniekształcenia, które występuje, gdy modele sztucznej inteligencji opierają się na oknach danych o wąskim zakresie lub ograniczonych danych wejściowych kontekstowych. Zrozumienie tej koncepcji pomaga inżynierom i decydentom rozpoznać ukryte błędy i problemy z wydajnością, które w przeciwnym razie mogłyby pozostać niezauważone.

TLDR: Szum AI przez wizjer odnosi się do zniekształceń lub błędów pojawiających się, gdy systemy AI podejmują decyzje w oparciu o wąskie, ograniczone lub niekompletne konteksty wejściowe. Często zdarza się, gdy modele opierają się na małych oknach danych, a nie na szerszych informacjach kontekstowych. Może to prowadzić do stronniczych przewidywań, niespójnych wyników lub słabego uogólnienia. Rozwiązanie tego problemu wymaga przemyślanego projektowania danych, modelowania kontekstowego i rygorystycznych testów.

W skrócie, Peephole AI Noise pojawia się, gdy algorytm podejmuje decyzje tak, jakby patrzył przez mały wizjer, a nie przez szerokie okno. Ponieważ widzi tylko ograniczoną część dostępnego kontekstu danych, może błędnie zinterpretować wzorce, wyolbrzymić drobne sygnały lub przeoczyć szersze relacje. Z biegiem czasu ta ograniczona perspektywa wprowadza systematyczny szum – nie przypadkowy chaos, ale strukturalne zniekształcenie zakorzenione w niepełnej widoczności.

Zrozumienie koncepcji „wizjera”.

Pomysł na termin „wizjer” wywodzi się ze sposobu, w jaki niektóre modele sztucznej inteligencji przetwarzają informacje. Zamiast całościowo oceniać cały zbiór danych, niektóre systemy analizują informacje w ograniczonych segmentach, przedziałach czasowych lub małych podzbiorach cech. Jest to szczególnie częste w:

- Rekurencyjne sieci neuronowe (RNN) , które opierają się na ograniczonych stanach pamięci

- Modele przesuwnego okna w prognozowaniu szeregów czasowych

- Komputerowe systemy wizyjne oceniające obszary upraw

- Modele przetwarzania języka naturalnego ograniczone limitami tokenów

Kiedy te segmenty nie uchwycą niezbędnego kontekstu zewnętrznego, przewidywania modelu stają się podatne na zniekształcenia. Wynikający z tego wzór błędów jest tym, co praktycy nieformalnie nazywają szumem AI Peephole.

Jak pojawia się hałas AI w wizjerach

Hałas AI przez wizjer zwykle wynika z jednego lub więcej z następujących warunków:

1. Ograniczone okna kontekstowe

Wiele systemów AI działa ze stałymi ograniczeniami kontekstowymi. Na przykład modele językowe przetwarzają jednocześnie maksymalną liczbę tokenów. Jeśli poza tą granicą istnieje kluczowa informacja, model musi wnioskować lub przybliżać. Ta ograniczona widoczność może powodować subtelne, ale kumulujące się zniekształcenia.

2. Obcięcie funkcji

W niektórych procesach uczenia maszynowego programiści celowo zmniejszają liczbę funkcji wejściowych, aby poprawić szybkość lub wydajność. Chociaż jest to praktyczne, agresywna redukcja cech może w sposób niezamierzony wyeliminować zmienne dostarczające sygnały równoważące.

3. Błąd próbkowania zbioru danych

Jeśli zbiór danych szkoleniowych reprezentuje jedynie wąski wycinek zmienności w świecie rzeczywistym, model skutecznie uczy się przez wizjer. Może działać dobrze w znanych scenariuszach, ale generować zaszumione wyniki w szerszych kontekstach.

4. Krótkowzroczność czasowa

Modele szeregów czasowych czasami w dużym stopniu opierają się na najnowszych punktach danych. Gdy trendy historyczne są ignorowane, prognozy mogą nadmiernie reagować na krótkoterminowe wahania, tworząc zaszumione lub niestabilne wyniki.

Przykłady ze świata rzeczywistego

Choć koncepcja może wydawać się abstrakcyjna, Peephole AI Noise przejawia się w praktycznych zastosowaniach w różnych branżach.

Prognozy finansowe

Algorytm przewidujący ceny akcji może analizować tylko ostatni tydzień aktywności handlowej. Bez uwzględnienia szerszych warunków gospodarczych lub trendów branżowych może to błędnie zinterpretować tymczasowy wzrost jako długoterminowy sygnał wzrostu.

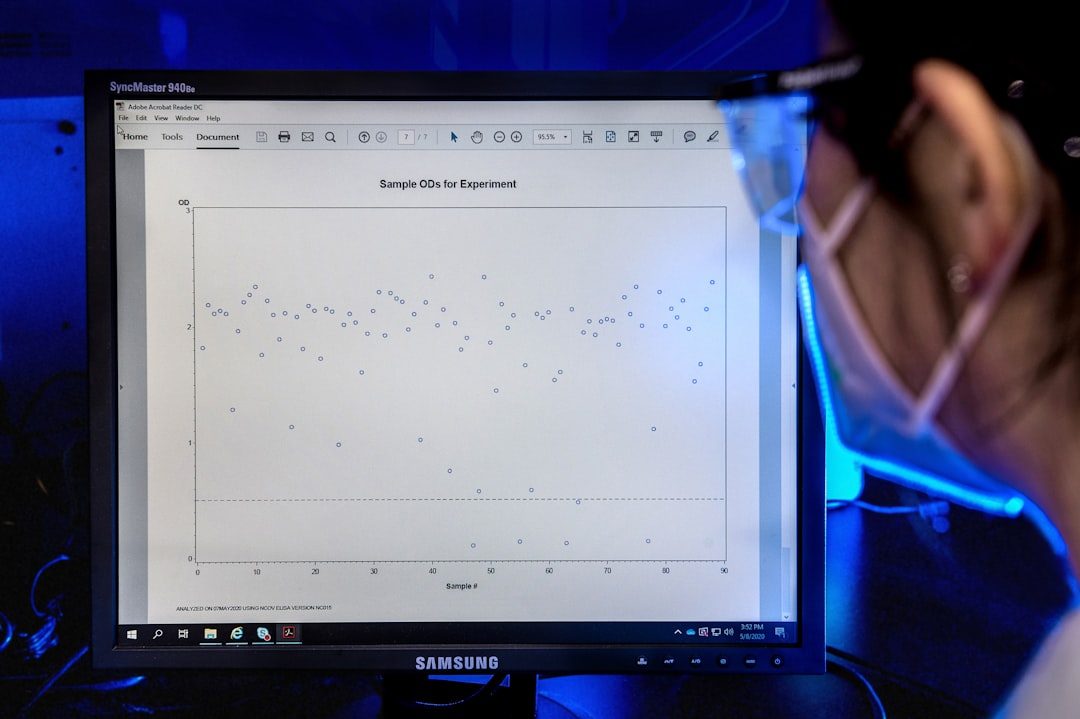

Diagnostyka Opieki Zdrowotnej

Medyczny system sztucznej inteligencji oceniający dane obrazowe mógłby zbyt wąsko skupiać się na małym obszarze zainteresowania. Jeśli zlekceważy otaczający kontekst anatomiczny, może zgłosić fałszywe alarmy lub przeoczyć powiązane ze sobą schorzenia.

Pojazdy autonomiczne

Systemy samochodów autonomicznych opierają się na danych wejściowych wizualnych i sensorycznych przetwarzanych w czasie zbliżonym do rzeczywistego. Jeśli system nadmiernie uwydatni przycięty kadr kamery bez uwzględnienia szerszego kontekstu sytuacyjnego, może błędnie sklasyfikować obiekty lub źle ocenić odległości.

Nie znaleziono obrazu w postmetaDlaczego hałas AI w wizjerach ma znaczenie

Zjawisko to jest istotne, ponieważ powoduje raczej systematyczne zniekształcenia niż błąd losowy. Losowe szumy często można zmniejszyć dzięki większej liczbie danych treningowych. Szum AI Peephole ma jednak charakter strukturalny. Wynika to ze sposobu, w jaki system jest zaprojektowany do postrzegania informacji.

Kluczowe ryzyka obejmują:

- Ograniczona generalizacja: modele zawodzą, gdy są stosowane poza wąskim kontekstem szkoleniowym.

- Ukryte wzmocnienie uprzedzeń: brakujące funkcje kontekstowe mogą nieproporcjonalnie wpływać na określone grupy.

- Nadmierna pewność co do błędnych wyników: system może wydawać się dokładny w ograniczonych środowiskach testowych.

- Słaba interpretowalność: programiści mają trudności z wykryciem źródła zniekształceń.

Ponieważ błędy wynikają z ograniczonej perspektywy, a nie z wadliwych obliczeń, mogą być szczególnie trudne do zdiagnozowania.

Mechanizmy wizjera w architekturach neuronowych

Koncepcja luźno pokrywa się z „połączeniami przez wizjer” w niektórych architekturach sieci neuronowych, takich jak sieci LSTM (Long Short-Term Memory). W LSTM połączenia przez wizjer umożliwiają bramom bezpośredni dostęp do stanu komórki. Chociaż technicznie różni się od szumu AI Peephole, czasami pojawia się zamieszanie z powodu nakładania się terminologii.

Co ważne, szum AI w Peephole nie odnosi się do obecności połączeń przez wizjer, ale do ograniczonego zakresu percepcji wejść systemu.

W modelach opartych na transformatorach ograniczone okna żetonów mogą imitować ten efekt. Jeśli wczesny fragment kontekstu wykracza poza okno wejściowe, w późniejszym rozumowaniu może brakować podstawowych informacji. Dane wyjściowe zawierają następnie luki w rozumowaniu, które przypominają szum, ale są generowane strukturalnie.

Strategie wykrywania

Identyfikacja szumu AI przez wizjer wymaga przemyślanej oceny wykraczającej poza standardowe wskaźniki dokładności.

1. Testowanie rozszerzania kontekstu

Programiści mogą rozszerzać okna wejściowe podczas testowania i porównywać stabilność wyjściową. Znaczące przesunięcia wyników mogą ujawnić nadmierną zależność od wąskich ramek wejściowych.

2. Walidacja międzydomenowa

Testowanie modeli w środowiskach nieco różniących się od danych szkoleniowych może ujawnić kontekstowe martwe punkty.

3. Analiza wrażliwości

Systematycznie dostosowując zmienne peryferyjne, badacze mogą określić, czy zignorowany kontekst radykalnie zmienia przewidywania po jego wprowadzeniu.

4. Podłużne śledzenie wydajności

Monitorowanie stabilności modelu w czasie często ujawnia dryf wzorca powiązany z ograniczonym kontekstem czasowym.

Techniki łagodzenia

Redukcja szumów AI w wizjerach niekoniecznie wymaga większych modeli. Zamiast tego przemyślane decyzje projektowe często dają lepsze wyniki.

Rozszerzone okna kontekstowe

Tam, gdzie to możliwe, zwiększenie zakresu danych wejściowych pomaga modelom uchwycić bogatsze relacje. W zastosowaniach NLP może to obejmować przesuwane bufory kontekstu lub architektury ze zwiększoną pamięcią.

Różnorodność funkcji

Zapewnienie różnorodnych i reprezentatywnych zestawów funkcji pomaga zrównoważyć modele przed nadmiernym dopasowaniem ograniczonych sygnałów.

Modelowanie wieloskalowe

Łączenie perspektyw lokalnych i globalnych w ramach tej samej architektury może złagodzić problemy związane z wąskim zakresem zainteresowań. Na przykład:

- Połączone warstwy prognozowania krótkoterminowego i długoterminowego

- Regionalne i globalne agregatory funkcji

- Hierarchiczne mechanizmy uwagi

Nadzór typu „człowiek w pętli”.

Recenzenci ręcznie mogą czasami wykryć luki w kontekście, które przeocza automatyczna walidacja. Ustrukturyzowany nadzór zmniejsza prawdopodobieństwo niezauważonych zakłóceń systemowych.

Związek z innymi typami hałasu AI

Szum AI z wizjera różni się od innych powszechnie omawianych kategorii hałasu:

- Szum etykiet: nieprawidłowe lub niespójne etykiety szkoleniowe.

- Hałas kontradyktoryjny: celowe zakłócenia mające na celu oszukanie modeli.

- Losowy szum danych: nieustrukturyzowane błędy pomiaru.

W przeciwieństwie do tych typów, Peephole AI Noise powstaje w wyniku pominięcia kontekstowego . Niekoniecznie jest to widoczne w surowych danych. Wynika raczej ze sposobu, w jaki system tworzy ramy i przetwarza te dane.

Przyszłe implikacje

W miarę jak systemy sztucznej inteligencji stają się coraz bardziej wbudowane w procesy decyzyjne, zakłócenia w wąskim kontekście stwarzają coraz większe ryzyko. Modele wielkoskalowe zmniejszają niektóre formy ograniczeń kontekstowych, ale granice obliczeniowe pozostają. Ograniczenia pamięci, koszty wnioskowania i potrzeby przetwarzania w czasie rzeczywistym często zmuszają projektantów do ograniczenia zakresu percepcji.

Nowe badania nad transformatorami o długim kontekście, modułami pamięci zewnętrznej i generacją wspomaganą odzyskiwaniem mają na celu zmniejszenie ograniczeń przypominających wizjery. Pozostają jednak kompromisy między kosztem obliczeniowym a zakresem kontekstu.

Najważniejszym wnioskiem dla organizacji wdrażających rozwiązania AI jest to, że wysokie wyniki dokładności nie gwarantują pełnego zrozumienia. Systemy, które „widzą” przez wąskie okna, mogą działać imponująco w kontrolowanych środowiskach, a jednocześnie zawodzić w nieprzewidywalny sposób w dynamicznych, rzeczywistych ustawieniach.

Wniosek

Peephole AI Noise opisuje zniekształcenie strukturalne powstające, gdy systemy sztucznej inteligencji opierają się na ograniczonych danych wejściowych kontekstowych. Podobnie jak oglądanie świata przez małą aperturę, systemy takie mogą błędnie interpretować zdarzenia, wyolbrzymiać sygnały lub pomijać krytyczne relacje. Zjawisko to jest subtelne, ale znaczące, szczególnie w środowiskach, w których stawka jest wysoka. Rozpoznanie i złagodzenie tego problemu wymaga szerszej integracji kontekstu, wieloskalowych strategii projektowania i celowej walidacji wykraczającej poza metryki na poziomie powierzchni.

Często zadawane pytania

Czym w skrócie jest szum AI Peephole?

Jest to rodzaj błędu sztucznej inteligencji, który ma miejsce, gdy system podejmuje decyzje w oparciu o zbyt wąskie lub niekompletne informacje kontekstowe, co prowadzi do zniekształconych lub stronniczych wyników.

Czy szum Peephole AI to to samo, co losowy szum danych?

Nie. Losowy szum wynika z nieprzewidywalnych błędów w gromadzeniu danych lub etykietowaniu, podczas gdy szum AI Peephole wynika z ograniczeń strukturalnych w sposobie, w jaki model postrzega kontekst.

Czy dotyczy to tylko sieci neuronowych?

Nie. Ten problem może wystąpić w każdym systemie uczenia maszynowego, który działa z ograniczonym zakresem danych wejściowych, obciętymi funkcjami lub wąskim próbkowaniem.

W jaki sposób programiści mogą zmniejszyć szum AI Peephole?

Mogą poszerzać okna kontekstu wejściowego, różnicować zestawy funkcji, stosować podejścia do modelowania wieloskalowego, przeprowadzać testy międzydomenowe i wdrażać mechanizmy nadzoru ludzkiego.

Czy hałas AI Peephole jest zawsze szkodliwy?

Nie koniecznie. W niektórych zastosowaniach wąskie skupienie jest zamierzone i skuteczne. Jednakże, gdy do dokładnej interpretacji wymagany jest szerszy kontekst, ograniczenie staje się problematyczne.

Dlaczego ta koncepcja jest ważna dla przedsiębiorstw?

Organizacje korzystające ze sztucznej inteligencji przy podejmowaniu decyzji muszą zapewnić, że ich systemy uwzględniają wystarczający kontekst. W przeciwnym razie ukryte zniekształcenia mogą prowadzić do błędnych prognoz, nieuczciwych wyników lub ryzyka operacyjnego.