Cos'è il rumore AI dello spioncino?

Pubblicato: 2026-02-21I sistemi di intelligenza artificiale vengono spesso valutati in base all’accuratezza, all’efficienza e alla scalabilità, ma viene prestata molta meno attenzione alle sottili distorsioni che si verificano durante l’elaborazione dei dati. Uno di questi fenomeni che ha attirato l'attenzione delle comunità di ricerca e sviluppatori è il rumore dell'intelligenza artificiale di Peephole . Sebbene non sia sempre definito formalmente nella letteratura accademica, il termine descrive un tipo specifico di distorsione che si verifica quando i modelli di intelligenza artificiale si basano su finestre di dati con ambito ristretto o input contestuali limitati. Comprendere questo concetto aiuta ingegneri e decisori a riconoscere pregiudizi nascosti e problemi di prestazioni che altrimenti potrebbero passare inosservati.

TLDR: Peephole AI Noise si riferisce a distorsioni o errori che si verificano quando i sistemi di intelligenza artificiale prendono decisioni basate su contesti di input ristretti, limitati o incompleti. Ciò si verifica spesso quando i modelli si basano su piccole finestre di dati anziché su informazioni contestuali più ampie. Ciò può portare a previsioni distorte, risultati incoerenti o scarsa generalizzazione. Affrontarlo richiede una progettazione attenta dei dati, una modellazione contestuale e test rigorosi.

In sostanza, il rumore AI dello spioncino appare quando un algoritmo prende decisioni come se guardasse attraverso un piccolo spioncino anziché un’ampia finestra. Poiché vede solo una parte limitata del contesto dei dati disponibili, potrebbe interpretare erroneamente i modelli, esagerare segnali minori o perdere relazioni più ampie. Nel corso del tempo, questa prospettiva limitata introduce un rumore sistematico: non un caos casuale, ma una distorsione strutturata radicata in una visibilità incompleta.

Comprendere il concetto di “spioncino”.

L’idea alla base del termine “spioncino” deriva dal modo in cui alcuni modelli di intelligenza artificiale elaborano le informazioni. Invece di valutare un intero set di dati in modo olistico, alcuni sistemi analizzano le informazioni in segmenti delimitati, fasi temporali o piccoli sottoinsiemi di funzionalità. Ciò è particolarmente comune in:

- Reti neurali ricorrenti (RNN) che si basano su stati di memoria limitati

- Modelli a finestra scorrevole nelle previsioni di serie temporali

- Sistemi di visione artificiale che valutano le regioni ritagliate

- Modelli di elaborazione del linguaggio naturale vincolati da limiti di token

Quando questi segmenti non riescono a catturare il contesto esterno necessario, la previsione del modello diventa vulnerabile alla distorsione. Il modello di errore risultante è ciò che i professionisti chiamano informalmente Peephole AI Noise.

Come emerge il rumore dell'intelligenza artificiale dello spioncino

Il rumore AI dello spioncino deriva in genere da una o più delle seguenti condizioni:

1. Finestre di contesto limitate

Molti sistemi di intelligenza artificiale operano con limiti di contesto fissi. Ad esempio, i modelli linguistici elaborano un numero massimo di token contemporaneamente. Se esistono informazioni cruciali al di fuori di tale confine, il modello deve dedurre o approssimare. Questa visibilità limitata può creare distorsioni sottili ma cumulative.

2. Troncamento delle funzionalità

In alcune pipeline di machine learning, gli sviluppatori riducono intenzionalmente il numero di funzionalità di input per migliorare la velocità o l'efficienza. Anche se pratica, la riduzione aggressiva delle funzionalità può eliminare involontariamente le variabili che forniscono segnali di bilanciamento.

3. Distorsione dal campionamento del set di dati

Se il set di dati di addestramento rappresenta solo una porzione ristretta della variazione del mondo reale, il modello apprende effettivamente attraverso uno spioncino. Potrebbe funzionare bene in scenari familiari ma produrre risultati rumorosi in contesti più ampi.

4. Miopia temporale

I modelli di serie temporali a volte fanno molto affidamento su dati recenti. Quando le tendenze storiche vengono ignorate, le previsioni possono reagire in modo eccessivo alle fluttuazioni a breve termine, creando risultati rumorosi o instabili.

Esempi del mondo reale

Sebbene il concetto possa sembrare astratto, Peephole AI Noise si manifesta in applicazioni pratiche in tutti i settori.

Previsioni finanziarie

Un algoritmo che prevede i prezzi delle azioni potrebbe analizzare solo l’ultima settimana di attività di trading. Senza incorporare le condizioni economiche più ampie o le tendenze del settore, potrebbe interpretare erroneamente un picco temporaneo come un segnale di crescita a lungo termine.

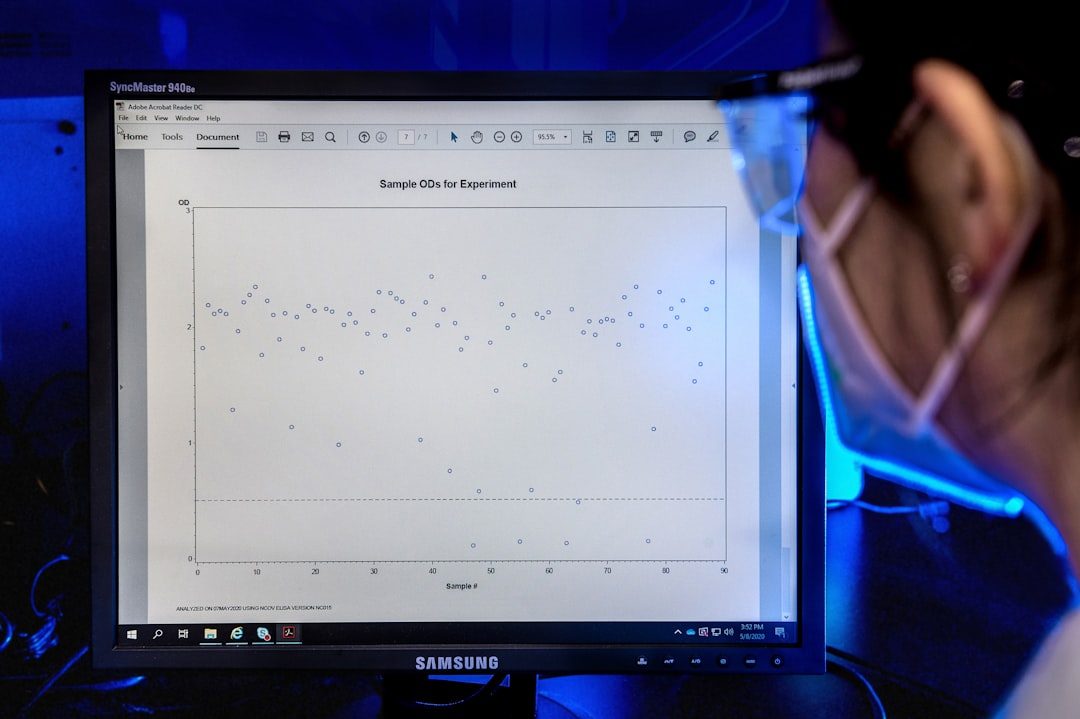

Diagnostica sanitaria

Un sistema di intelligenza artificiale medica che valuta i dati di imaging potrebbe concentrarsi in modo troppo ristretto su una piccola regione di interesse. Se trascura il contesto anatomico circostante, potrebbe segnalare falsi positivi o non rilevare condizioni interconnesse.

Veicoli autonomi

I sistemi di auto a guida autonoma si basano su input visivi e sensoriali elaborati quasi in tempo reale. Se il sistema enfatizza eccessivamente l’inquadratura ritagliata della telecamera senza integrare un contesto situazionale più ampio, potrebbe classificare erroneamente gli oggetti o valutare erroneamente le distanze.

Immagine non trovata in postmetaPerché il rumore dell'intelligenza artificiale dello spioncino è importante

Questo fenomeno è significativo perché produce distorsioni sistematiche piuttosto che errori casuali. Il rumore casuale può spesso essere ridotto attraverso più dati di training. Il rumore dell'intelligenza artificiale dello spioncino, tuttavia, è strutturale. Emerge da come il sistema è progettato per percepire le informazioni.

I principali rischi includono:

- Generalizzazione ridotta: i modelli falliscono se applicati al di fuori del loro ristretto contesto di formazione.

- Amplificazione dei pregiudizi nascosti: le caratteristiche contestuali mancanti possono influenzare in modo sproporzionato gruppi specifici.

- Eccessiva fiducia in risultati difettosi: il sistema può apparire accurato in ambienti di test limitati.

- Scarsa interpretabilità: gli sviluppatori faticano a individuare la fonte della distorsione.

Poiché gli errori derivano da una prospettiva limitata piuttosto che da calcoli errati, possono essere particolarmente difficili da diagnosticare.

Meccanismi di spioncino nelle architetture neurali

Il concetto si interseca vagamente con le “connessioni spioncino” in alcune architetture di reti neurali, come le reti LSTM (Long Short-Term Memory). Negli LSTM, le connessioni spioncino consentono ai cancelli di accedere direttamente allo stato della cella. Sebbene tecnicamente distinto da Peephole AI Noise, a volte sorge confusione a causa della sovrapposizione della terminologia.

È importante sottolineare che il rumore AI dello spioncino non si riferisce alla presenza di connessioni dello spioncino, ma all'ambito percettivo limitato degli input di un sistema.

Nei modelli basati su trasformatore, finestre di token limitate possono imitare questo effetto. Se una prima parte del contesto supera la finestra di input, il ragionamento successivo potrebbe mancare di informazioni fondamentali. L'output contiene quindi lacune di ragionamento che assomigliano al rumore ma sono generate strutturalmente.

Strategie di rilevamento

L'identificazione del rumore AI dello spioncino richiede una valutazione deliberata che va oltre le metriche di precisione standard.

1. Test di espansione del contesto

Gli sviluppatori possono espandere le finestre di input durante i test e confrontare la stabilità dell'output. Spostamenti significativi dell'output possono rivelare un'eccessiva dipendenza da frame di input ristretti.

2. Convalida interdominio

Testare i modelli in ambienti leggermente diversi dai dati di training può esporre punti ciechi contestuali.

3. Analisi di sensibilità

Regolando sistematicamente le variabili periferiche, i ricercatori possono determinare se il contesto ignorato altera drasticamente le previsioni quando viene introdotto.

4. Monitoraggio longitudinale delle prestazioni

Il monitoraggio della stabilità del modello nel tempo spesso rivela una deriva del modello legata a un contesto temporale limitato.

Tecniche di mitigazione

La riduzione del rumore AI dello spioncino non richiede necessariamente modelli più grandi. Invece, decisioni di progettazione ponderate spesso producono risultati migliori.

Ampliare le finestre di contesto

Ove possibile, l’aumento dell’ambito dell’input aiuta i modelli a catturare relazioni più ricche. Nelle applicazioni NLP, ciò potrebbe comportare buffer di contesto scorrevoli o architetture potenziate dalla memoria.

Caratteristica Diversità

Garantire set di funzionalità diversificati e rappresentativi aiuta a bilanciare i modelli contro l'adattamento eccessivo dei segnali vincolati.

Modellazione multiscala

La combinazione di prospettive locali e globali all’interno della stessa architettura può mitigare i problemi di focalizzazione ristretta. Per esempio:

- Livelli di previsione a breve e lungo termine combinati

- Aggregatori di funzionalità regionali e globali

- Meccanismi di attenzione gerarchica

Supervisione Human-in-the-Loop

I revisori umani a volte possono rilevare lacune di contesto che la convalida automatizzata trascura. Una supervisione strutturata riduce la probabilità di distorsioni sistemiche inosservate.

La relazione con altri tipi di rumore AI

Il rumore AI dello spioncino differisce dalle altre categorie di rumore comunemente discusse:

- Rumore dell'etichetta: etichette di addestramento errate o incoerenti.

- Rumore contraddittorio: perturbazioni deliberate progettate per ingannare i modelli.

- Rumore casuale dei dati: errori di misurazione non strutturati.

A differenza di questi tipi, Peephole AI Noise ha origine da un'omissione contestuale . Non è necessariamente visibile nei dati grezzi. Piuttosto, deriva dal modo in cui il sistema inquadra ed elabora tali dati.

Implicazioni future

Man mano che i sistemi di intelligenza artificiale diventano sempre più integrati nei processi decisionali, le distorsioni legate al contesto ristretto pongono rischi crescenti. I modelli su larga scala riducono alcune forme di limitazione contestuale, ma i confini computazionali persistono. I vincoli di memoria, i costi di inferenza e le esigenze di elaborazione in tempo reale spesso costringono i progettisti a limitare l'ambito della percezione.

La ricerca emergente sui trasformatori a lungo contesto, sui moduli di memoria esterni e sulla generazione aumentata con recupero mira a ridurre le limitazioni simili a spioncini. Tuttavia, permangono dei compromessi tra il costo computazionale e l’ampiezza contestuale.

Per le organizzazioni che implementano soluzioni di intelligenza artificiale, il punto fondamentale è che punteggi elevati di precisione non garantiscono una comprensione completa. I sistemi che “vedono” attraverso finestre strette possono funzionare in modo impressionante in ambienti controllati mentre falliscono in modo imprevedibile in ambienti dinamici e reali.

Conclusione

Peephole AI Noise descrive una distorsione strutturale che si verifica quando i sistemi di intelligenza artificiale si affidano a input contestuali limitati. Proprio come vedere il mondo attraverso una piccola apertura, tali sistemi possono interpretare erroneamente gli eventi, esagerare i segnali o perdere le relazioni critiche. Il fenomeno è sottile ma significativo, soprattutto negli ambienti ad alto rischio. Riconoscerlo e mitigarlo richiede una più ampia integrazione del contesto, strategie di progettazione multiscala e una convalida deliberata oltre i parametri di livello superficiale.

Domande frequenti

Cos'è il rumore AI di Peephole in termini semplici?

È un tipo di errore di intelligenza artificiale che si verifica quando un sistema prende decisioni sulla base di informazioni contestuali troppo ristrette o incomplete, portando a risultati distorti o distorti.

Il rumore AI di Peephole è uguale al rumore dei dati casuali?

No. Il rumore casuale deriva da errori imprevedibili nella raccolta o nell'etichettatura dei dati, mentre il rumore AI dello spioncino deriva da limitazioni strutturali nel modo in cui il modello percepisce il contesto.

Interessa solo le reti neurali?

No. Qualsiasi sistema di machine learning che opera con ambito di input limitato, funzionalità troncate o campionamento ristretto può riscontrare questo problema.

In che modo gli sviluppatori possono ridurre il rumore dell'intelligenza artificiale dello spioncino?

Possono ampliare le finestre di contesto di input, diversificare i set di funzionalità, utilizzare approcci di modellazione multiscala, condurre test tra domini e implementare meccanismi di supervisione umana.

Il rumore AI dello spioncino è sempre dannoso?

Non necessariamente. In alcune applicazioni, la messa a fuoco ristretta è intenzionale ed efficiente. Tuttavia, quando è necessario un contesto più ampio per un’interpretazione accurata, la limitazione diventa problematica.

Perché questo concetto è importante per le imprese?

Le organizzazioni che si affidano all’intelligenza artificiale per il processo decisionale devono garantire che i loro sistemi considerino un contesto sufficiente. In caso contrario, le distorsioni nascoste potrebbero portare a previsioni errate, risultati ingiusti o rischi operativi.